Google NotebookLM Heeft Mijn Manier van Onderzoek Doen Veranderd

Ik had dit bijna gemist. En als ik dat had gedaan, zou ik nog steeds op de pijnlijke manier onderzoek doen — jongleren met twaalf tabbladen, citaten kopiëren en plakken in een Google Doc, mijn gedachtegang verliezen elke keer dat ik wisselde tussen een paper en mijn notities.

Twee weken geleden pustte Google wat misschien de grootste update ooit is die NotebookLM heeft ontvangen. Geen kleine UI-opfrisbeurt. Geen "we hebben donkere modus toegevoegd"-update. Ik heb het over een fundamentele herbouw van hoe het hulpmiddel informatie verwerkt, onthoudt en uitvoert. Het soort update dat je je hele onderzoeksworkflow van de ene op de andere dag doet herdenken.

Ik ontdekte het op de manier waarop de meeste mensen echt belangrijke updates ontdekken — niet van een flashy aankondiging, maar van een frustrerende middag. Ik had een stapel academische papers over agentische AI-architecturen in NotebookLM geladen. Ongeveer vijftien stuks. En plotseling waren de antwoorden... anders. Scherper. Specifieker. Verbanden trekkend tussen papers die het hulpmiddel de week ervoor volledig had genegeerd.

Er was iets veranderd. Toen ik in Google's changelog dook, besefte ik hoeveel.

Dit is wat me verraste: de meeste berichtgeving over deze update richt zich op één of twee opvallende functies. Maar het echte verhaal is hoe al deze wijzigingen samenwerken. Afzonderlijk zijn het aardige upgrades. Gecombineerd? Ze maken van NotebookLM een speelgoedje in een hulpmiddel dat ik daadwerkelijk zou vertrouwen voor serieus onderzoekswerk.

Ik heb de afgelopen twee weken elke nieuwe functie stress-getest. Laat me je meenemen door wat er echt toe doet.

De Bronscapaciteitssprong Die Alles Verandert

Laat me eerst een getal geven. 8x. Dat is hoeveel Google de bronverwerkingscapaciteit van NotebookLM heeft uitgebreid in deze update.

Vroeger, wanneer je een grote verzameling bronnen uploadde, kon NotebookLM ze wel lezen, maar tijdens je gesprek kon het slechts een fractie van dat materiaal in zijn actieve contextvenster houden. Denk eraan als studeren voor een examen maar slechts drie van je vijftien studieboeken mogen openen tegelijk.

Het resultaat? Vage antwoorden. Samenvattingen die verdacht generiek aanvoelden. Verbanden tussen documenten die de AI gewoon niet kon maken.

Met de 8x uitbreiding blijft de hele broncollectie in context. Alles. Elk geüpload document, elke PDF, elk transcript.

Het praktische verschil is dramatisch. Ik voerde een directe vergelijking uit: dezelfde twaalf papers over multi-agentsystemen, dezelfde vraag over concurrerende architectuurbenaderingen. De oude versie gaf me een samenvatting van drie alinea's die misschien vier papers aanraakte. De nieuwe versie produceerde een gedetailleerde vergelijking over alle twaalf, met specifieke citaten, en noteerde waar auteurs het met elkaar eens waren en — dit deel verraste me — waar ze tegenstrijdige beweringen deden die geen van beide expliciet erkende.

Dat laatste deel is belangrijker dan mensen beseffen. Het vinden van tegenstrijdigheden in een groot corpus aan onderzoek kost menselijke onderzoekers uren. NotebookLM deed het in ongeveer acht seconden.

Zes Keer Meer Gespreksgeheugen — En Waarom Dat Groter Is Dan Het Klinkt

Google verhoogde het gespreksgeheugen met 6x.

Onderzoek is geen enkelvoudige vraag. Het is een gesprek. Je begint breed, vernauwd af, draait wanneer je iets onverwachts vindt, keert terug naar een vorig onderwerp. Dat proces kan tientallen uitwisselingen kosten.

Met de oude geheugenlimiet zou NotebookLM rond het twintigste of vijfentwintigste bericht in een gesprek vroegere context beginnen te verliezen. Je refereerde aan iets dat je tien berichten geleden had besproken, en de AI reageerde alsof het nooit was gebeurd.

De 6x geheugenuitbreiding verandert het spel. Google's eigen interne tests toonden een verbetering van 50% in responsekwaliteit voor grote broncollecties — en eerlijk gezegd voelt dat getal vanuit mijn tests conservatief aan.

Ik testte dit met een gesprekssessie van veertig berichten over federated learning-architecturen. Tegen bericht vijfendertig had de AI onder het oude systeem de draad volledig verloren. Onder het nieuwe systeem? Het verwees nog steeds naar inzichten uit bericht vier en verbond ze met nieuwe vragen die ik bij bericht achtendertig stelde.

10.000 Tekens Instructies: De Functie Waarover Niemand Genoeg Praat

Het instructieveld — dat kleine tekstvak in NotebookLM's instellingen waar je de AI kunt vertellen hoe het zich moet gedragen — ging van 500 tekens naar 10.000. Dat is een verhoging van 20x.

500 tekens gaf je ruimte voor zoiets als: "Focus op methodologiesecties. Citeer specifieke paginanummers. Wees beknopt." Nuttig, maar basaal.

10.000 tekens? Dat is genoeg om wat neerkomt op een volledige functiebeschrijving voor je AI-onderzoeksassistent te schrijven.

Hier is een ingekort versie van de instructieset die ik nu gebruik voor mijn AI-architectuuronderzoeksnotebook:

ROL: Je bent een senior onderzoeksanalist gespecialiseerd in

multi-agent AI-systemen. Je primaire functie is bewijssynthese,

geen samenvatting.

ANTWOORDFORMAT:

- Begin met het directe antwoord

- Volg met ondersteunend bewijs uit specifieke bronnen

- Markeer bewijskracht: [STERK], [MATIG], [ZWAK]

- Noteer tegenstrijdigheden tussen bronnen expliciet

ANALYSEREGELS:

- Speculeer nooit buiten wat bronnen zeggen

- Wanneer bronnen het oneens zijn, presenteer beide posities

- Identificeer methodologische hiaten in geciteerd onderzoek

Dat is ongeveer 700 tekens. Ik heb nog 9.300 meer te spelen.

Vier Audioformaten Die Werkelijk Zinvol Zijn

NotebookLM's audio-uitvoer — de "podcast-stijl" deep dive — was een van de meest besproken functies. De update introduceert vier verschillende audiouitvoerformaten:

Brief genereert een samenvatting van één tot twee minuten. Snel, gefocust, raakt de kernpunten.

Critique is waar het interessant wordt. In plaats van alleen je bronnen samen te vatten, analyseren de twee hosts ze actief. Ze identificeren hiaten in het onderzoek. Ze wijzen op zwakke argumenten.

Debate neemt twee tegengestelde standpunten uit je bronnen en laat de hosts elk kant beargumenteren.

Deep Dive is het originele langetermijnformaat, nu met betere kwaliteit.

Datatabellen: De Functie Die Ik Niet Wist Dat Ik Nodig Had

Hier is het pijnpunt dat dit oplost. Je voert een literatuuronderzoek uit. Je hebt twintig papers. Je hebt een vergelijkingstabel nodig: auteur, methodologie, steekproefgrootte, belangrijkste bevindingen, beperkingen.

Nu kun je vanuit het Studiopanel een gestructureerde, spreadsheetstijl tabel direct genereren. Je specificeert de vergelijkingscriteria, NotebookLM haalt de gegevens op uit je bronnen, en de uitvoer is een nette tabel met rijen, kolommen en — cruciaal — broncitaten voor elke cel.

Ik testte dit met een verzameling van vijftien papers over AI-agent evaluatiemethodologieën. De tabel vulde zich in ongeveer twaalf seconden. Vijftien rijen, vijf kolommen, elke cel geciteerd terug naar zijn brondocument. Één klik exporteerde het naar Google Sheets met intacte opmaak.

Wat me twee tot drie uur zorgvuldig lezen en handmatige gegevensinvoer zou hebben gekost, duurde twaalf seconden.

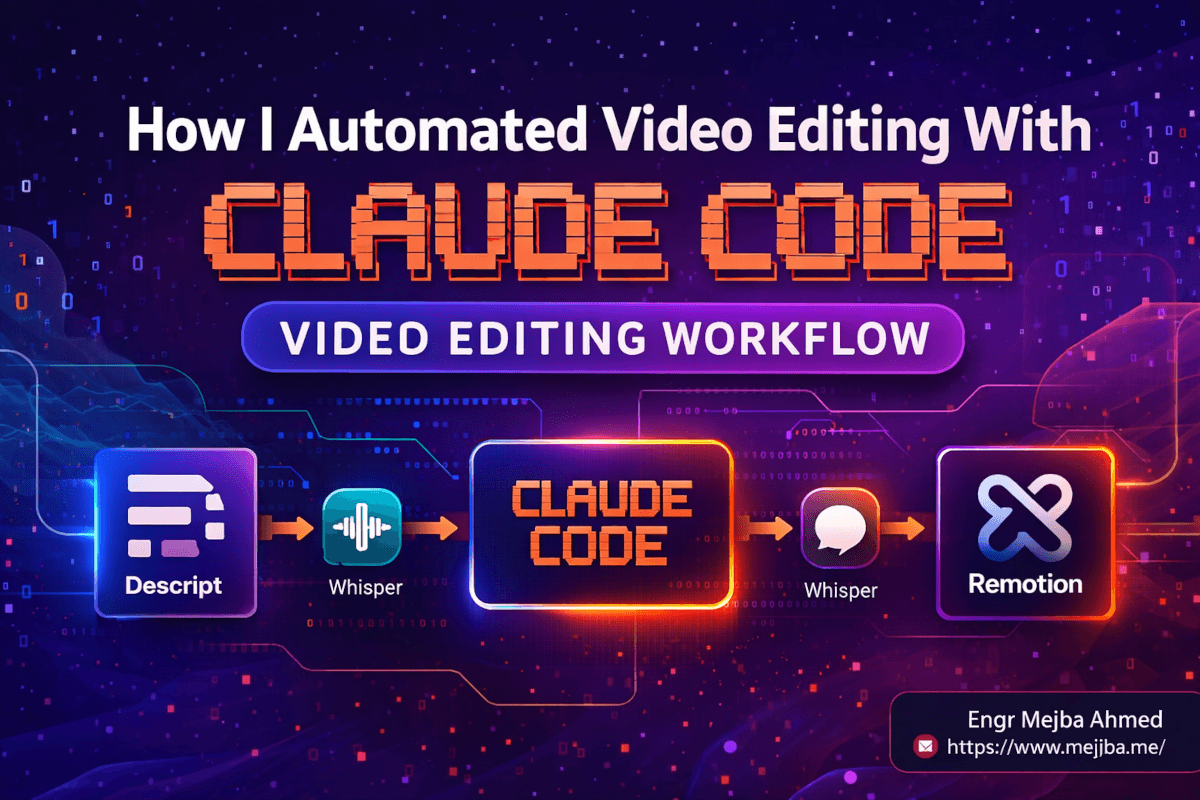

De Gemini-Integratie Die Niemand Verwachtte

Je NotebookLM-notebooks kunnen nu dienen als directe bronnen binnen de Gemini-app.

Vroeger waren NotebookLM en Gemini afzonderlijke tools. Je deed onderzoek in NotebookLM, wisselde dan naar Gemini voor het maken van inhoud, waarbij je je onderzoek handmatig invoerde.

Nu verbind je je NotebookLM-notebook als bron in Gemini, en Gemini kan direct putten uit je gecureerde, geciteerde, geverifieerde onderzoekscollectie.

De workflow ziet er als volgt uit:

- Upload en organiseer onderzoek in NotebookLM

- Gebruik NotebookLM's tools (audio, tabellen, chat) om te begrijpen en te synthetiseren

- Verbind het notebook met Gemini als bron

- Bouw een aangepaste Gem aangedreven door je geverifieerde onderzoek

- Genereer inhoud in Gemini die verankerd is in je specifieke bronnen

De Eerlijke Beoordeling: Wat Nog Steeds Niet Werkt

Bronformaatbeperkingen bijten nog steeds. NotebookLM heeft nog steeds moeite met complexe tabelindelingen in PDF's, meerkolomse academische papers met zware wiskundige notatie, en gescande documenten met matige OCR.

Audiogeneratie is traag. Het genereren van elk van de vier audioformaten duurt één tot drie minuten afhankelijk van het bronvolume.

De Gemini-integratie is alleen voor Google. Als je workflow niet-Google-tools omvat — en de meeste echte workflows doen dat — is de notebook-naar-Gemini-pipeline een gesloten tuin. Je kunt een NotebookLM-notebook niet verbinden met Claude of ChatGPT.

Aangepaste instructies vereisen echte inspanning om goed te krijgen. Het veld van 10.000 tekens is krachtig, maar het is ook een leeg canvas.

Datatabellen zijn niet altijd nauwkeurig. Ik noemde eerder de nauwkeurigheidsgraad van 93%. Dat is goed, maar het betekent dat ongeveer één op de vijftien cellen onnauwkeurige of onprecieze gegevens kan bevatten.

Wat Dit Werkelijk Betekent Voor Je Onderzoeksworkflow

Stap één: herbouw je instructieset. Dit is de meest impactvolle wijziging die je kunt aanbrengen.

Stap twee: consolideer je notebooks. Als je onderzoek hebt verdeeld over meerdere notebooks vanwege de oude contextbeperkingen, voeg ze samen.

Stap drie: probeer alle vier audioformaten op dezelfde broncollectie. De Brief oriënteert je. De Critique scherpt je denken. Het Debate stress-test je aannames. De Deep Dive vult hiaten op.

Stap vier: bouw je eerste datatabel voor je volgende literatuuronderzoek.

Stap vijf: als je in het Google-ecosysteem zit, probeer de Gemini-integratie.

Twee weken geleden deed ik onderzoek op de oude manier. Twaalf tabbladen, handmatige notities, context verliezen elke keer dat ik van document wisselde. Ik ga niet terug.

Laten We Samenwerken

Wil je AI-systemen bouwen, workflows automatiseren of je technische infrastructuur opschalen? Ik help je graag.

- Fiverr (custom builds & integraties): fiverr.com/s/EgxYmWD

- Portfolio: mejba.me

- Ramlit Limited (enterprise-oplossingen): ramlit.com

- ColorPark (design & branding): colorpark.io

- xCyberSecurity (beveiligingsdiensten): xcybersecurity.io