Google NotebookLM Hat Meine Art zu Recherchieren Verändert

Ich hätte das fast verpasst. Und wenn ich es verpasst hätte, würde ich noch immer auf die schmerzhafte Art recherchieren — zwölf Tabs jonglieren, Zitate in ein Google-Dokument kopieren und einfügen, meinen Gedankenfaden verlieren, jedes Mal wenn ich zwischen einer Quelle und meinen Notizen wechselte.

Vor zwei Wochen veröffentlichte Google, was möglicherweise das größte Update ist, das NotebookLM je erhalten hat. Kein kleines UI-Auffrischungsupdate. Kein "wir haben den Dunkelmodus hinzugefügt"-Update. Ich spreche von einem grundlegenden Neuaufbau, wie das Tool Informationen verarbeitet, sich erinnert und ausgibt. Die Art von Update, die dich deinen gesamten Recherche-Workflow über Nacht überdenken lässt.

Ich erfuhr davon auf die Art und Weise, wie die meisten Menschen wirklich wichtige Updates erfahren — nicht von einer auffälligen Ankündigung, sondern von einem frustrierenden Nachmittag. Ich hatte einen Stapel akademischer Papers über agentische KI-Architekturen in NotebookLM geladen. Etwa fünfzehn davon. Und plötzlich waren die Antworten... anders. Schärfer. Spezifischer. Verbindungen zwischen Papers ziehend, die das Tool die Woche zuvor völlig ignoriert hatte.

Etwas hatte sich verändert. Als ich in Googles Changelog tauchte, erkannte ich, wie viel.

Ich habe die letzten zwei Wochen damit verbracht, jede neue Funktion unter Stress zu testen. Lass mich dich durch das führen, was wirklich wichtig ist.

Der Quellenkapazitätssprung, Der Alles Verändert

Lass mich zuerst eine Zahl nennen. 8-fach. So viel hat Google die Quellenverarbeitungskapazität von NotebookLM in diesem Update erweitert.

Zuvor, wenn du eine große Quellensammlung hochgeladen hast, konnte NotebookLM sie zwar lesen, aber während deines Gesprächs konnte es nur einen Bruchteil dieses Materials in seinem aktiven Kontextfenster halten. Stell dir vor, du lernst für eine Prüfung, darfst aber immer nur drei von fünfzehn Lehrbüchern gleichzeitig öffnen.

Das Ergebnis? Vage Antworten. Zusammenfassungen, die verdächtig generisch wirkten. Verbindungen zwischen Dokumenten, die die KI einfach nicht herstellen konnte.

Mit der 8-fachen Erweiterung bleibt die gesamte Quellensammlung im Kontext. Alles.

Der praktische Unterschied ist dramatisch. Ich führte einen direkten Vergleich durch: dieselben zwölf Papers über Multi-Agenten-Systeme, dieselbe Frage zu konkurrierenden Architekturansätzen. Die alte Version lieferte mir eine drei Absätze lange Zusammenfassung, die vielleicht vier Papers berührte. Die neue Version produzierte einen detaillierten Vergleich über alle zwölf, mit spezifischen Zitaten, und notierte, wo Autoren übereinstimmten und — dieser Teil überraschte mich — wo sie widersprüchliche Aussagen machten, die keiner von ihnen explizit anerkannte.

Das ist etwas, wofür menschliche Forscher Stunden benötigen. NotebookLM tat es in etwa acht Sekunden.

Sechsfach Mehr Gesprächsgedächtnis

Google erhöhte das Gesprächsgedächtnis um das 6-Fache.

Recherche ist keine einzelne Frage. Es ist ein Gespräch. Du beginnst breit, verengerst dich, schwenkst um, wenn du etwas Unerwartetes findest, kehrst zu einem früheren Faden zurück.

Mit dem alten Gedächtnislimit begann NotebookLM um die zwanzigste oder fünfundzwanzigste Nachricht im Gespräch frühen Kontext zu verlieren.

Die 6-fache Gedächtniserweiterung verändert das Spiel. Googles eigene interne Tests zeigten eine 50%ige Verbesserung der Antwortqualität für große Quellensammlungen.

10.000 Zeichen Anweisungen: Die Funktion, Über Die Niemand Genug Spricht

Das Anweisungsfeld — dieses kleine Textfeld in NotebookLMs Einstellungen, wo du der KI sagen kannst, wie sie sich verhalten soll — stieg von 500 auf 10.000 Zeichen. Das ist eine 20-fache Erhöhung.

Mit 500 Zeichen hattest du Platz für etwas wie: "Fokus auf Methodologieabschnitte. Zitiere spezifische Seitenzahlen. Sei prägnant."

Mit 10.000 Zeichen? Das reicht, um eine vollständige Stellenbeschreibung für deinen KI-Forschungsassistenten zu schreiben.

Hier ist eine gekürzte Version des Anweisungssatzes, den ich jetzt für mein KI-Architekturforschungs-Notebook verwende:

ROLLE: Du bist ein leitender Forschungsanalyst, spezialisiert auf

Multi-Agenten-KI-Systeme. Deine Hauptfunktion ist Beweissynthese,

keine Zusammenfassung.

ANTWORTFORMAT:

- Beginne mit der direkten Antwort

- Folge mit unterstützenden Belegen aus spezifischen Quellen

- Kennzeichne Beweiskraft: [STARK], [MODERAT], [SCHWACH]

- Notiere Widersprüche zwischen Quellen explizit

Vier Audioformate, Die Wirklich Sinn Ergeben

Das Update führt vier verschiedene Audioausgabeformate ein:

Brief generiert eine ein- bis zweiminütige Zusammenfassung.

Critique ist wo es interessant wird. Anstatt nur deine Quellen zusammenzufassen, analysieren die beiden Hosts sie aktiv.

Debate nimmt zwei gegensätzliche Standpunkte aus deinen Quellen und lässt die Hosts jede Seite vertreten.

Deep Dive ist das originale Langformat, jetzt mit besserer Qualität.

Datentabellen: Die Funktion, Die Ich Nicht Wusste, Dass Ich Sie Brauchte

Aus dem Studio-Panel kannst du eine strukturierte, tabellenkalkulationsähnliche Tabelle direkt generieren. Du spezifizierst die Vergleichskriterien, NotebookLM extrahiert die Daten aus deinen Quellen, und die Ausgabe ist eine saubere Tabelle mit Zeilen, Spalten und — entscheidend — Quellenangaben für jede Zelle.

Ich testete dies mit einer Sammlung von fünfzehn Papers. Die Tabelle füllte sich in etwa zwölf Sekunden. Fünfzehn Zeilen, fünf Spalten, jede Zelle zurück zur Quelldokument zitiert. Ein Klick exportierte es nach Google Sheets mit intakter Formatierung.

Was mich zwei bis drei Stunden sorgfältiges Lesen und manuelle Dateneingabe gekostet hätte, dauerte zwölf Sekunden.

Die Gemini-Integration, Die Niemand Erwartete

Deine NotebookLM-Notebooks können jetzt als direkte Quellen innerhalb der Gemini-App dienen.

Zuvor waren NotebookLM und Gemini separate Tools. Jetzt verbindest du dein NotebookLM-Notebook als Quelle in Gemini, und Gemini kann direkt aus deiner kuratierten, zitierten, verifizierten Forschungssammlung schöpfen.

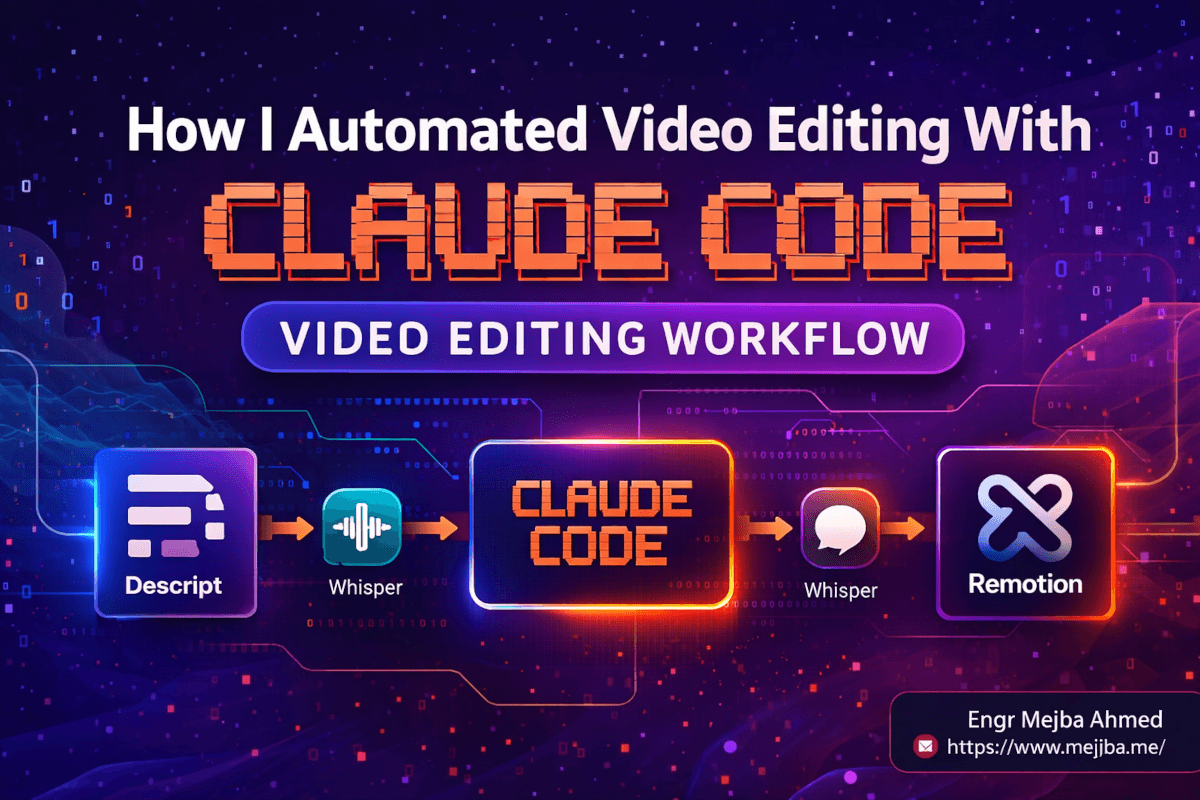

Der Workflow sieht so aus:

- Lade und organisiere Recherchen in NotebookLM

- Nutze NotebookLMs Tools (Audio, Tabellen, Chat) zum Verstehen und Synthetisieren

- Verbinde das Notebook mit Gemini als Quelle

- Baue ein benutzerdefiniertes Gem, das von deiner verifizierten Recherche angetrieben wird

- Generiere Inhalte in Gemini, die in deinen spezifischen Quellen verankert sind

Die Ehrliche Einschätzung: Was Noch Nicht Funktioniert

Quellenformatbeschränkungen beißen noch. NotebookLM kämpft noch mit komplexen Tabellenlayouts in PDFs, mehrspaltige akademische Papers mit schwerer mathematischer Notation.

Audiogenerierung ist langsam. Das Generieren eines der vier Audioformate dauert je nach Quellvolumen ein bis drei Minuten.

Die Gemini-Integration ist nur für Google. Wenn dein Workflow Nicht-Google-Tools umfasst, ist die Notebook-zu-Gemini-Pipeline ein geschlossenes System.

Benutzerdefinierte Anweisungen erfordern echten Aufwand. Das 10.000-Zeichen-Feld ist mächtig, aber es ist auch eine leere Leinwand.

Datentabellen sind nicht immer korrekt. Ich erwähnte früher die Genauigkeitsrate von 93%. Das bedeutet, dass etwa eine von fünfzehn Zellen ungenaue Daten enthalten könnte.

Was Das Wirklich Für Deinen Recherche-Workflow Bedeutet

Schritt eins: Baue deinen Anweisungssatz neu auf.

Schritt zwei: Konsolidiere deine Notebooks.

Schritt drei: Probiere alle vier Audioformate auf derselben Quellensammlung.

Schritt vier: Baue deine erste Datentabelle vor deiner nächsten Literaturrecherche.

Schritt fünf: Wenn du im Google-Ökosystem bist, probiere die Gemini-Integration.

Vor zwei Wochen recherchierte ich noch auf die alte Weise. Zwölf Tabs, manuelle Notizen, Kontext verlieren jedes Mal wenn ich zwischen Dokumenten wechselte. Ich gehe nicht zurück.

Lass Uns Zusammenarbeiten

Möchtest du KI-Systeme aufbauen, Workflows automatisieren oder deine Tech-Infrastruktur skalieren? Ich helfe dir gerne.

- Fiverr (Custom-Builds & Integrationen): fiverr.com/s/EgxYmWD

- Portfolio: mejba.me

- Ramlit Limited (Enterprise-Lösungen): ramlit.com

- ColorPark (Design & Branding): colorpark.io

- xCyberSecurity (Sicherheitsdienste): xcybersecurity.io