Opus 4.6 hat jetzt 1M Token Kontext: Meine echten Tests

Ich war letzten Dienstag 47 Nachrichten tief in einer Claude Code-Sitzung — dabei, ein ausuferndes Laravel-Monolith in Domain-Services zu refaktorieren — als das Modell anfing, Funktionsnamen zu halluzinieren, die nicht existierten. Keine zufälligen Namen. Namen, die fast mit echten Funktionen aus Dateien übereinstimmten, die ich zwanzig Minuten vorher eingegeben hatte. Der Kontext war verfault. Das Modell ertrank in seinem eigenen Gedächtnis, verwechselte Datei A mit Datei B und erfand plausibel klingende Methoden, die nirgendwo in meiner Codebase existierten.

Ich löschte den Kontext, fütterte die kritischen Dateien erneut ein und fing von vorne an. Schon wieder. Zum dritten Mal an diesem Tag.

Wenn du jemals ein großes Sprachmodell für ernsthafte Programmierarbeit verwendet hast, kennst du genau diesen Schmerz. Du triffst irgendwo bei 100K-120K Tokens auf eine Wand, wo das Modell aufhört, ein Mitarbeiter zu sein, und anfängt, ein Risikofaktor zu werden. Jeder Claude Code-Poweruser, den ich kenne, hat das gleiche Muskelgedächtnis entwickelt: Beobachte den Tokenzähler, lösche früh, lade häufig neu. Es funktioniert. Aber es ist erschöpfend. Und es bedeutet, dass du dem Modell nie wirklich eine massive Codebase geben und sagen kannst: "Versteh das alles."

Das änderte sich am 13. März 2026. Anthropic rollte leise Kontextfenster von 1 Million Tokens für sowohl Opus 4.6 als auch Sonnet 4.6 aus — ein 5-facher Sprung gegenüber der vorherigen Obergrenze von 200K. Und nachdem ich drei Tage damit verbracht habe, das an seine Grenzen zu bringen, kann ich dir sagen: Das ist kein inkrementelles Upgrade. Das ist die größte praktische Verbesserung an Claude, seit ich es täglich nutze.

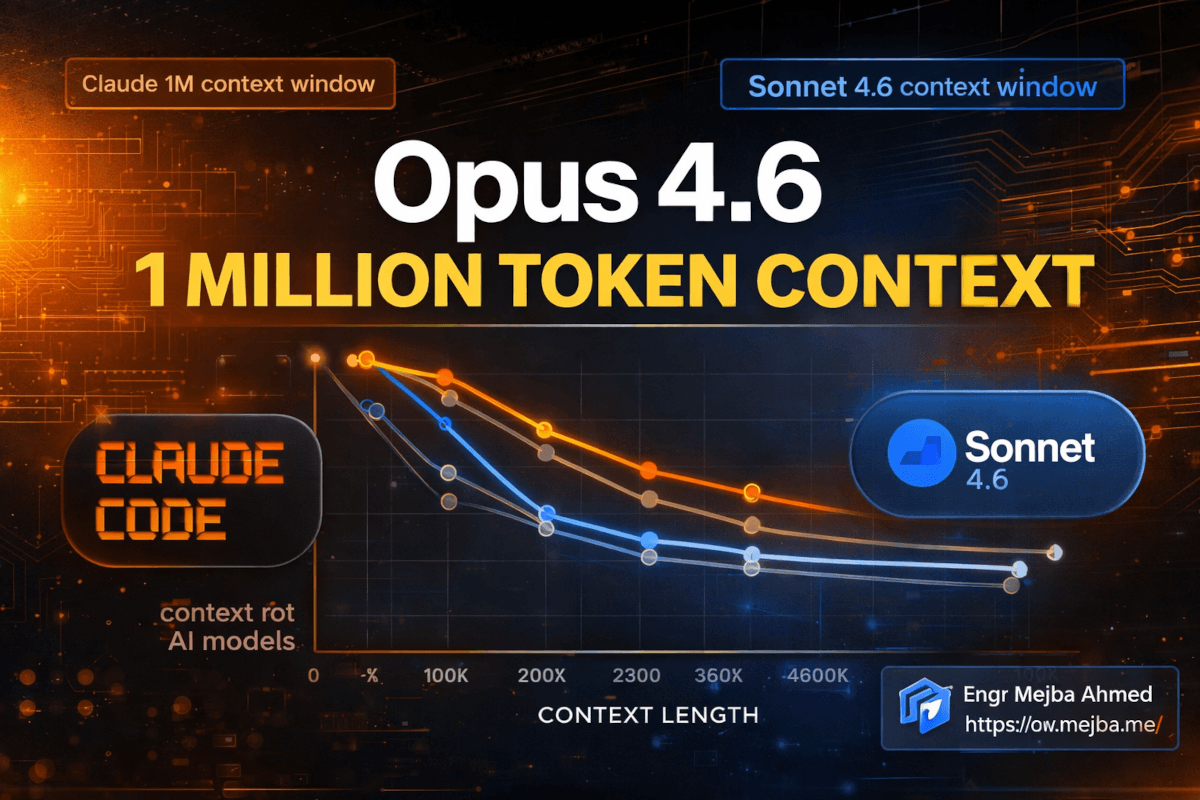

Aber die reine Zahl ist nicht einmal der interessante Teil. Was interessant ist, ist wie wenig das Modell degradiert über diesen riesigen Kontext. Und da wird die Geschichte erzählenswert.

Was ist Kontextfäule — und warum 1M Tokens allein es nicht löst

Hier ist das schmutzige Geheimnis, über das die meisten KI-Unternehmen nicht offen reden wollen: Ein größeres Kontextfenster bedeutet nichts, wenn das Modell die Informationen an den entfernten Rändern nicht tatsächlich nutzen kann.

Dieses Problem hat einen Namen. Kontextfäule. Es ist das Phänomen, bei dem die Modellleistung degradiert — manchmal katastrophal — wenn der Eingabekontext über einen bestimmten Schwellenwert hinauswächst. Stell dir vor, du liest einen 500-seitigen Roman in einer Sitzung versus eine 50-seitige Novelle. Bei Seite 400 ist deine Erinnerung an ein spezifisches Detail von Seite 12... bestenfalls verschwommen.

Frühere Modelle traf das hart. Füttere Opus 4.5 mit mehr als etwa 100K Tokens, und seine Fähigkeit, spezifische Details zu erinnern, die über den Input verstreut waren, fiel von einer Klippe. Das Modell akzeptierte technisch gesehen 128K Tokens. Aber Tokens zu akzeptieren und tatsächlich über sie zu schlussfolgern, sind sehr verschiedene Dinge.

Google machte die gleiche Wette mit Gemini — massive Kontextfenster, die in Marketingmaterialien großartig klangen, aber inkonsistent abschnitten, wenn man das Modell tatsächlich brauchte, um eine spezifische Konfiguration tief in einem großen Input zu finden. Ich habe Gemini 3.1 Pro genau bei dieser Art von Aufgabe getestet. Die Ergebnisse waren nicht vertrauenserweckend.

Als Anthropic also 1M Tokens ankündigte, war meine erste Frage nicht "wie groß?" Sie war "wie viel vergisst es?"

Die Antwort überraschte mich. Und sie wird durch einen spezifischen Benchmark unterstützt, den meiner Meinung nach jeder Entwickler verstehen sollte.

Der Acht-Nadel-Test: Warum dieser Benchmark wichtig ist

Anthropic verwendet einen Test namens "Acht-Nadel"-Evaluation. Das Konzept ist einfach, aber gnadenlos: Verstreue acht spezifische, unterschiedliche Informationen über einen massiven Eingabekontext. Frage dann das Modell, alle acht abzurufen.

Es ist, als würdest du acht spezifische Sätze in einem 3.000-seitigen Dokument verstecken und jemanden bitten, jeden einzelnen zu finden, ohne einen zu übersehen. Nicht ungefähr. Nicht "ich habe sechs von acht gefunden." Alle acht, mit genauen Details.

Dieser Test ist wichtig, weil er etwas misst, das die meisten Benchmarks ignorieren — die Fähigkeit, granulare Erinnerung über das gesamte Kontextfenster aufrechtzuerhalten, nicht nur am Anfang und Ende. Modelle, die beim Acht-Nadel-Test gut abschneiden, sind Modelle, denen du tatsächlich mit großen Codebases, langen Dokumentanalysen und Refactoring-Sitzungen über mehrere Dateien vertrauen kannst.

Hier sind die Zahlen. Schau sie dir genau an:

| Modell | Max Kontextfenster | Acht-Nadel-Score | Wichtigste Erkenntnis |

|---|---|---|---|

| Opus 4.5 | ~128.000 | 27,1 | Leistungsabsturz jenseits von ~100K |

| Gemini 3.1 Pro | ~200.000 | 26,0 | Ähnliches Degradationsmuster |

| Sonnet 4.5 | ~200.000 | 18,5 | Schlechteste Erinnerung unter Vergleichsmodellen |

| Opus 4.6 | 1.000.000 | 78,3 | 5x Kontext, 3x Effektivität |

| GPT 5.4 | Nicht spezifiziert | ~78,0 | Konkurrenzfähig mit Opus 4.6 |

Lies das nochmal. Opus 4.5 erzielte 27,1 bei ungefähr 128K Tokens. Opus 4.6 erzielte 78,3 bei einer Million Tokens. Das ist nicht nur ein größeres Fenster — es ist fast die dreifache Erinnerungseffektivität bei fast der achtfachen Kontextlänge. Das Modell akzeptiert nicht einfach mehr Tokens. Es schlussfolgert tatsächlich über sie auf eine Weise, die die vorherige Generation nicht ansatzweise konnte.

Und ja — GPT 5.4 erreicht ungefähr den gleichen Acht-Nadel-Score. Ehre, wem Ehre gebührt. Aber GPT 5.4 hat kein klares maximales Kontextfenster veröffentlicht, und in meinen Tests entspricht die praktische Leistung bei sehr langen Programmiersitzungen nicht ganz den synthetischen Benchmark-Zahlen. Mehr dazu, wenn ich zu den Praxisergebnissen komme.

Die Gemini 3.1 Pro-Zahlen sind ebenfalls erwähnenswert. Googles Modell erzielte 26,0 — fast identisch mit der vorherigen Generation Opus 4.5, obwohl Google das Kontextfenster von Gemini als wichtigstes Alleinstellungsmerkmal vermarktet. Großes Fenster, löchriges Gedächtnis. Das ist keine Kombination, der ich bei einer Refactoring-Sitzung mit 20 Dateien vertrauen würde.

Hier die praktische Übersetzung: Über 1 Million Tokens zeigt Opus 4.6 nur etwa 14% Abfall in der Effektivität im Vergleich zu seiner Leistung bei 256 Tokens. Denk darüber nach. Du kannst dem Modell fast tausend Seiten Code, Dokumentation und Gesprächsverlauf eingeben, und es behält 86% seiner Kurzkontext-Fähigkeit. Das ist nicht perfekt. Aber es ist nutzbar auf eine Weise, die kein vorheriges Modell war.

Die 2%-Regel: Eine praktische Faustregel für Tokenmanagement

Nach dem Durchführen meiner eigenen Tests neben den veröffentlichten Benchmarks bin ich bei einer groben Faustregel gelandet, die genau genug ist, um damit zu planen: Rechne mit ungefähr 2% Abfall in der Effektivität für jede zusätzlichen 100K Tokens an Kontext.

Bei 100K Tokens: ~2% Degradation. Kaum merkbar. Bei 200K Tokens: ~4% Degradation. Immer noch extrem solide. Bei 500K Tokens: ~10% Degradation. Du wirst gelegentlich etwas weniger präzise Erinnerung bemerken. Bei 1M Tokens: ~14% Degradation. Arbeitet härter, aber immer noch funktional.

Dies ist eine Richtlinie, kein Gesetz. Die tatsächliche Degradation hängt davon ab, was in deinem Kontext steckt — homogener Code in einer Sprache degradiert anders als eine Mischung aus Dokumentation, Code, Konfigurationen und Gesprächsverlauf. Aber als Planungswerkzeug hat sich die 2%-Regel in meinen drei Testtagen bewährt.

Was das praktisch bedeutet: Der alte Ratschlag "lösche deinen Kontext bei 100K-120K Tokens" ist keine harte Regel mehr. Du kannst jetzt weit darüber hinausgehen. Solltest du jedes Mal bis 1M pushen? Wahrscheinlich nicht — und ich erkläre im Implementierungsabschnitt warum. Aber die operative Obergrenze hat sich dramatisch nach oben verschoben.

Die bisherige Best Practice basierte auf echtem Schmerz. Jenseits von 120K Tokens bei Opus 4.5 begann das Modell, ähnliche Variablennamen zu verwechseln, Details aus verschiedenen Dateien zusammenzuführen oder Einschränkungen zu "vergessen", die du früh im Gespräch gesetzt hattest. Diese Probleme verschwinden bei 1M Tokens nicht — aber sie wurden so weit nach außen geschoben, dass die meisten realen Sitzungen sie nie erreichen werden.

Diese Verschiebung verändert, wie ich meinen gesamten Workflow strukturiere. Und das sollte sie wahrscheinlich auch bei dir.

Wie ich das tatsächlich täglich in Claude Code nutze

Theorie ist schön. Wie fühlen sich 1M Tokens an, wenn du Code auslieferst?

Ich verbringe täglich vier bis zehn Stunden in Claude Code. Es ist meine primäre Entwicklungsumgebung — kein Assistent, bei dem ich gelegentlich vorbeischaue. Ich nutze es für alles, vom Schreiben neuer Features über das Debuggen von Produktionsproblemen bis zum Refaktorieren ganzer Modulstrukturen. Vor dem 1M-Kontext-Update sah mein Workflow so aus:

- Starte eine Sitzung mit System-Prompt und Schlüsseldateien (~15K Tokens)

- Arbeite Aufgaben durch, füttere Dateien ein und erhalte Ausgaben

- Beobachte nervös den Tokenzähler

- Bei etwa 100K-120K Tokens bemerke die ersten Anzeichen von Drift — wiederholte Vorschläge, leicht falsche Variablennamen, vergessene Einschränkungen

- Lösche Kontext, lade kritische Dateien neu, verliere den Gesprächsfaden

- Wiederhole Schritte 2-5 zwei- oder dreimal pro größerer Aufgabe

Jetzt? Ich starte eine Sitzung und ich... arbeite einfach. Stundenlang. Ohne den ständigen mentalen Overhead des Kontextmanagements. Die Reduktion der kognitiven Belastung ist schwer zu überschätzen. Es ist wie der Unterschied zwischen Fahren mit einer Tankanzeige, die immer fast leer ist, versus einen vollen Tank zu haben. Du hörst auf, dir Sorgen über die Ressource zu machen, und konzentrierst dich auf die Straße.

Hier ein konkretes Beispiel aus dieser Woche. Ich war dabei, eine Multi-Tenant-SaaS-Anwendung von einer Shared-Database-Architektur auf ein Database-per-Tenant-Modell zu migrieren. Das bedeutete, 23 Dateien anzufassen: Models, Migrationen, Middleware, Konfigurationsdateien, Test-Suites und Deployment-Skripte. Mit dem alten Kontextfenster hätte ich mindestens drei separate Sitzungen gebraucht, wobei ich jedes Mal neu feststellen musste, welche Dateien geändert wurden und wie die Gesamtmigrationsstrategie aussah.

Mit dem 1M-Kontextfenster lud ich alle 23 Dateien vorab (~85K Tokens), plus die bestehende Migrationsdokumentation (~12K Tokens), plus meine Architekturnotizen (~8K Tokens). Das sind ungefähr 105K Tokens allein für den initialen Kontext — bereits jenseits der alten "Gefahrenzone." Dann arbeitete ich Datei für Datei durch die Migration, wobei das Modell perfekte Kenntnis jeder Änderung behielt, die wir über die gesamte Sitzung hinweg gemacht hatten. Die Sitzung lief auf etwa 340K Tokens, bevor ich fertig war.

Nicht ein einziges Mal musste ich löschen. Nicht ein einziges Mal verwechselte das Modell eine Tenant-scoped Query mit einer globalen. Nicht ein einziges Mal musste ich sagen "denk dran, wir haben die Middleware schon in Schritt 4 geändert."

Diese Sitzung hätte mich mit den alten Kontextlimits einen ganzen Tag gekostet, zwischen dem erneuten Primen und dem erneuten Erklären und dem Beheben von Fehlern, die durch Kontextverlust verursacht wurden. Es dauerte vier Stunden.

Ein Hinweis zu Claude Codes Autocompact-Buffer

Eine Sache, die mich anfangs verwirrte: Claude Code verwendet immer noch einen Autocompact-Buffer von 33K Tokens. Das ist das rollende Fenster des jüngsten Gesprächs, das das Modell im aktiven Arbeitsspeicher hält, getrennt vom breiteren Kontext.

Das 1M-Kontextfenster ändert die Größe dieses Buffers nicht. Was es ändert, ist der gesamte Kontext, auf den das Modell verweisen kann — deine Dateien, deinen System-Prompt, den vollständigen Gesprächsverlauf und den Autocompact-Buffer zusammen. Der Buffer umfasst weiterhin 33K Tokens "heißen" Speicher, aber jetzt erstreckt sich der "warme" Speicher auf 1M Tokens statt 200K.

In der Praxis bedeutet das, dass das Modell bei deinen jüngsten Austauschen (dem Buffer) immer noch am stärksten ist, aber jetzt viel weiter in den Gesprächsverlauf und geladene Dateien zurückreichen kann, ohne den Faden zu verlieren. Die Kombination funktioniert gut. Ich habe nicht das Gefühl gehabt, einen größeren Buffer zu brauchen — das aktive 33K-Fenster bewältigt das unmittelbare Hin und Her, und der erweiterte Kontext erledigt alles andere.

Was ist mit den Kosten? Anthropic hat einen klugen Schachzug gemacht

Hier ist etwas, das in der Ankündigung fast untergegangen wäre, aber für jeden, der ernsthafte Claude Code-Sitzungen fährt, enorm wichtig ist: Anthropic hat den Kostenmultiplikator für Kontext jenseits von 200K Tokens abgeschafft.

Zuvor kam die Nutzung von Kontext über das Standardfenster hinaus mit einem Preisaufschlag. Der genaue Multiplikator variierte, aber es bedeutete, dass eine 400K-Token-Sitzung spürbar mehr pro Token kostete als eine 100K-Token-Sitzung. Das schuf einen perversen Anreiz — du wurdest finanziell bestraft dafür, die volle Fähigkeit des Modells zu nutzen.

Jetzt? Einheitspreis. Ob deine Sitzung 9K Tokens oder 900K Tokens nutzt, die Kosten pro Token sind gleich. Du zahlst für das, was du verbrauchst, nicht einen Aufpreis dafür, viel davon zu verbrauchen.

Das ist verfügbar auf Claude Codes Max-Plan, Teams- und Enterprise-Stufen. Wenn du auf einem dieser Pläne bist — und wenn du diesen Blog liest, solltest du das wahrscheinlich sein — ist das 1M-Kontextfenster bereits aktiv. Kein Feature-Flag. Keine Warteliste. Es ist einfach da.

Die Preisänderung ist wichtig, weil sie die letzte praktische Hürde beseitigt, den erweiterten Kontext tatsächlich zu nutzen. Zuvor habe ich manchmal den Kontext früh gelöscht, nicht weil das Modell degradierte, sondern weil ich meine API-Rechnung steigen sah. Diese Kalkulation ist weg. Ich kann jetzt Kontextmanagement-Entscheidungen rein auf Grundlage der Qualität treffen, nicht der Kosten.

Wenn du lieber jemanden hättest, der Claude Code-Workflows für die spezifischen Bedürfnisse deines Teams einrichtet und optimiert, nehme ich genau solche Aufträge an. Du kannst sehen, was ich gebaut habe unter fiverr.com/s/EgxYmWD.

Meine empfohlene Kontextstrategie für März 2026

Also gut, du hast 1M Tokens zur Verfügung. Solltest du sie alle immer nutzen? Nein. Hier ist die Strategie, bei der ich nach drei Tagen bewussten Testens gelandet bin.

Schritt 1: Lade deinen kritischen Kontext vorab

Lade zu Beginn jeder Sitzung die Dateien und Dokumentation, die am wichtigsten sind. Tröpfle sie nicht ein — gib dem Modell das vollständige Bild vorab. Das nutzt die stärkste Erinnerungszone des Modells (den Beginn des Kontexts) für deine wichtigsten Informationen.

Für eine typische Programmiersitzung sieht meine initiale Ladung so aus:

- System-Prompt und Projektkonventionen (~5K Tokens)

- Architekturdokumentation (~8-15K Tokens)

- Alle Dateien, die ich voraussichtlich ändern werde (~40-100K Tokens)

- Zugehörige Testdateien (~20-40K Tokens)

- Aktueller git diff für Kontext über bisherige Änderungen (~5-10K Tokens)

Das sind irgendwo zwischen 80K und 170K Tokens vor der ersten Nachricht. Beim alten Modell hätte mir das fast keinen Spielraum zum Arbeiten gelassen. Jetzt sind es weniger als 20% meines verfügbaren Kontexts.

Schritt 2: Lege deinen persönlichen Degradationsschwellenwert fest

Basierend auf der 2%-pro-100K-Faustregel entscheide, wie viel Degradation du akzeptieren kannst:

-

Konservativ (Degradation minimieren): Lösche oder komprimiere bei etwa 200K Tokens. Du erfährst ~4% Degradation — in der täglichen Arbeit praktisch nicht wahrnehmbar. Das würde ich für produktionskritisches Refactoring empfehlen, bei dem Präzision nicht verhandelbar ist.

-

Ausgewogen (mein Standard): Arbeite bis 400K-500K Tokens, bevor du eine Löschung in Betracht ziehst. Bei ~10% Degradation ist das Modell noch hochgradig leistungsfähig, und du vermeidest den Produktivitätsverlust durch erneutes Primen. Hier operiere ich bei den meisten Programmiersitzungen.

-

Erweitert (maximale Kontinuität): Push Richtung 700K-1M Tokens für Sitzungen, bei denen die Beibehaltung des vollständigen Gesprächsfadens wichtiger ist als Spitzenerinnerung — wie explorative Architekturdiskussionen oder lange Debugging-Sitzungen, bei denen jeder vorherige Versuch relevanter Kontext ist.

Schritt 3: Achte auf spezifische Degradationssignale

Selbst mit der verbesserten Kontextverarbeitung taucht Degradation irgendwann auf. Hier ist, worauf du achten solltest:

- Variablennamen-Verwirrung: Das Modell beginnt, ähnlich benannte Variablen aus verschiedenen Dateien zu verwechseln. Das ist normalerweise das erste Anzeichen.

- Einschränkungsdrift: Anweisungen von früh in der Sitzung werden teilweise ignoriert. Du merkst, dass das Modell eine Formatierungsregel nicht befolgt oder einen Schritt überspringt, den du spezifiziert hattest.

- Selbstsichere Fabrikation: Das Modell behauptet etwas über deinen Code mit Überzeugung, aber es ist subtil falsch — eine Funktionssignatur mit der falschen Parameterreihenfolge oder eine Methode, die auf einer anderen Klasse existiert als behauptet.

- Repetitive Vorschläge: Du fragst nach einem neuen Ansatz und bekommst etwas zurück, das dem bereits Versuchten sehr ähnlich ist. Das Modell verliert den Überblick darüber, was bereits versucht wurde.

Wenn du zwei oder mehr davon in kurzer Folge bemerkst, ist das dein Signal. Warte nicht, bis es schlimmer wird. Lösche den Kontext, lade deine kritischen Dateien neu und mach weiter.

Schritt 4: Verwende bewusste Lesezeichen

Das ist eine Technik, die ich speziell für lange Sitzungen entwickelt habe. Alle 150K-200K Tokens setze ich ein "Lesezeichen"-Nachricht:

Kurzer Checkpoint: Wir haben [X, Y, Z] abgeschlossen. Aktueller Stand:

- Datei A: geändert (Tenant-Scoping hinzugefügt)

- Datei B: noch nicht angefasst

- Datei C: braucht Migrations-Update

Nächstes: Arbeiten an der Query-Schicht von Datei B.

Das dient zwei Zwecken. Erstens zwingt es mich, mein eigenes Denken darüber zu ordnen, wo die Sitzung steht. Zweitens gibt es dem Modell eine saubere, aktuelle Zusammenfassung des Projektstands, die innerhalb seines Autocompact-Buffers liegt. Selbst wenn die Erinnerung an Details vom Sitzungsbeginn leicht degradiert ist, bietet das Lesezeichen einen frischen Ankerpunkt.

Ich habe festgestellt, dass allein diese Technik mehr wert ist als jede Menge Tokenzählung. Ein gut platziertes Lesezeichen bei 300K Tokens hält das Modell schärfer als kein Lesezeichen bei 200K Tokens.

Warum ich denke, dass das mehr ausmacht als Loops oder Beat

Ich möchte das in Perspektive setzen. In den letzten sechs Monaten hat Anthropic viele Features für Claude Code ausgeliefert. Loops (die Fähigkeit des Modells, iterativ Code auszuführen und zu testen). Beat (die Fähigkeit, Hintergrundaufgaben zu bewältigen). Verbesserungen beim erweiterten Denken. Verfeinerungen bei der Tool-Nutzung. Alles gutes Zeug. Alles Dinge, die ich täglich nutze.

Aber das 1M-Kontextfenster ist anders in der Art, nicht nur im Grad. Hier ist warum.

Jedes andere Feature verbessert, was das Modell innerhalb einer einzelnen Interaktion tun kann. Loops macht es besser im Iterieren. Beat macht es besser im Multitasking. Denken macht es besser im Schlussfolgern. All das betrifft Fähigkeiten zu einem bestimmten Zeitpunkt.

Die Kontextfenster-Erweiterung verbessert, was das Modell während einer Sitzung wissen kann. Es geht um Gedächtnis, nicht um Können. Und Gedächtnis erweist sich als der Engpass, der still alles andere einschränkte.

Ein Modell mit perfekter Programmierfähigkeit, aber Amnesie nach 100K Tokens, ist ein Modell, das nur an kleinen Problemen arbeiten kann — oder an großen Problemen in kleinen, zusammenhanglosen Stücken. Ein Modell mit der gleichen Programmierfähigkeit und 1M Tokens zuverlässigem Gedächtnis kann Projekte angehen, die vorher für KI-unterstützte Entwicklung außer Reichweite waren.

Ich spreche von vollständigen Anwendungsrefaktorierungen. Multi-Service-Architekturänderungen. Codebase-weite Mustermigrationen. Sicherheitsaudits, die jeden Authentifizierungs-Endpunkt mit jeder Autorisierungsprüfung abgleichen müssen. Das sind die Aufgaben, an denen menschliche Entwickler Wochen verbringen und trotzdem Dinge übersehen. Es sind auch die Aufgaben, bei denen eine KI mit ausreichend Kontext Muster und Inkonsistenzen finden könnte, die kein Mensch bemerken würde.

Wir sind noch nicht ganz da. Die 14% Degradation bei 1M Tokens bedeutet, dass du immer noch durchdacht sein musst, wie du den Kontext nutzt. Aber wir sind nah genug dran, dass ich begonnen habe, Aufgaben mit Claude Code anzugehen, die ich vor drei Monaten für unmöglich gehalten hätte.

Die Wettbewerbslandschaft macht das noch interessanter. GPT 5.4 liegt beim Acht-Nadel-Benchmark mit ~78 versus 78,3 von Opus 4.6 gleichauf — ein statistisch insignifikanter Unterschied. Aber Anthropics Einheitspreismodell und die Claude Code-Integration geben ihm einen praktischen Vorteil für Entwickler, die im Terminal leben. Ich habe beide ausgiebig genutzt. Bei der reinen Erinnerung sind sie ebenbürtig. Bei der Workflow-Integration für Programmieraufgaben ist die Implementierung von Claude Code geschmeidiger.

Gemini 3.1 Pro liegt trotz Googles massiver Investition in Long-Context-Forschung eine volle Generation hinter der Erinnerungsqualität zurück. Ein Score von 26,0 beim Acht-Nadel-Test — fast identisch mit der vorherigen Generation Opus 4.5 — deutet darauf hin, dass Google das Kontextfenster-Größenproblem gelöst hat, ohne das Kontextqualitätsproblem zu lösen. Großes Fenster, löchriges Gedächtnis. Das ist keine Kombination, der ich bei einer Refactoring-Sitzung mit 20 Dateien vertrauen würde.

Die ehrlichen Einschränkungen — was das nicht löst

Ich würde lügen, wenn ich dir sagen würde, das 1M-Kontextfenster hätte nur Vorteile. Es gibt echte Kompromisse und Einschränkungen, die du kennen solltest, bevor du deinen Workflow änderst.

Latenz steigt mit der Kontextgröße. Mehr Tokens bedeutet mehr zu verarbeiten bei jeder Runde. Ich habe bemerkt, dass sich die Antwortzeiten zwischen 100K und 500K Tokens Kontext ungefähr verdoppeln. Bei 800K+ gibt es eine spürbare Verzögerung, bevor das Modell zu generieren beginnt. Es ist nicht schrecklich — wir reden über Sekunden, nicht Minuten — aber wenn du an nahezu sofortige Antworten bei kurzen Kontexten gewöhnt bist, ist die Verzögerung bemerkbar.

Nicht alle Degradation ist gleich. Die durchschnittliche Degradation von 14% maskiert erhebliche Varianz je nachdem, was du das Modell zu erinnern bittest. Spezifische numerische Werte (wie Portnummern oder Versionsstrings), die tief im Kontext vergraben sind, degradieren schneller als strukturelle Muster (wie "dieses Modul behandelt Authentifizierung"). Wenn deine Arbeit von präziser Detailerinnerung aus dem frühen Kontext abhängt, könnte die effektive Degradation für deinen Anwendungsfall höher als 14% sein.

Der Autocompact-Buffer liegt immer noch bei 33K. Das bedeutet, das aktive Arbeitsgedächtnis des Modells hat sich nicht geändert. Wenn du schnelles Hin und Her bei einem bestimmten Problem machst, ist der 33K-Buffer deine echte Einschränkung, nicht das 1M-Kontextfenster. Der erweiterte Kontext hilft bei "kalter" Erinnerung — Zurückgreifen auf etwas von früher in der Sitzung — macht das Modell aber nicht besser darin, mehrere aktive Stränge im unmittelbaren Gespräch zu jonglieren.

Du kannst es immer noch überfordern. Es gelang mir, das Modell während einer Sitzung wirklich zu verwirren, in der ich gleichzeitig voneinander abhängige Dateien über drei Microservices hinweg änderte. Bei etwa 600K Tokens begann es, Änderungen für Service A vorzuschlagen, die im Widerspruch zu Änderungen standen, die wir zwanzig Minuten zuvor bereits an Service B vorgenommen hatten. Die Lesezeichen-Technik half, beseitigte das Problem aber nicht vollständig.

Das sind keine Dealbreaker. Es sind die Art von Einschränkungen, mit denen du umzugehen lernst, sobald du sie verstehst. Aber ich höre es lieber von mir als dass du sie während eines kritischen Deployments entdeckst.

Was das für die nächsten sechs Monate bedeutet

Ich baue mit KI-Programmiertools seit GPT-3.5 sie tragfähig gemacht hat. Durch diesen gesamten Bogen hindurch war ein Muster konsistent: Die größten Sprünge vorwärts kommen immer davon, zu erweitern, was das Modell im Kontext halten kann, nicht davon, es bei einer einzelnen Aufgabe marginal schlauer zu machen.

Der Sprung von 4K auf 32K Tokens machte KI-unterstütztes Programmieren möglich. Der Sprung von 32K auf 128K machte es praktisch für echte Projekte. Der Sprung von 200K auf 1M macht es tragfähig für ganze Codebases.

Wir nähern uns einem Schwellenwert, an dem ein Modell deine gesamte Anwendung — jede Datei, jeden Test, jede Konfiguration — in einem einzigen Kontextfenster halten kann. Für eine typische mittelgroße Anwendung (200-500 Dateien) sind wir bereits dort. Für große Enterprise-Codebases sind wir vielleicht noch eine Generation entfernt.

Wenn das passiert, ist die Workflow-Verschiebung fundamental. Du hörst auf zu denken "welche Dateien muss die KI sehen?" und fängst an zu denken "was soll ich die KI bitten, über meine gesamte Codebase hinweg zu tun?" Das ist eine qualitativ andere Art von Entwicklungsunterstützung. Es ist der Unterschied zwischen einer KI, die dir hilft, eine Datei zu bearbeiten, und einer KI, die dein System versteht.

Ich glaube, wir werden auf März 2026 als den Monat zurückblicken, in dem dieser Übergang ernsthaft begann. Nicht weil 1M Tokens die endgültige Zahl ist — das ist sie nicht. Aber weil es das erste Mal war, dass der Kontext groß genug war und die Erinnerung zuverlässig genug, um KI-Unterstützung für ganze Codebases tatsächlich zum Funktionieren zu bringen.

Zum ersten Mal in meiner Erfahrung ist das Kontextfenster nicht der Engpass. Und das bedeutet, der Engpass sind jetzt... wir. Unsere Fähigkeit, die richtigen Fragen zu stellen, die richtigen Prompts zu strukturieren und Workflows zu entwerfen, die das nutzen, was plötzlich möglich ist.

Ich nehme diesen Kompromiss an. Jedes Mal.

Häufig gestellte Fragen

Wie aktiviere ich das 1M-Kontextfenster für Claude Opus 4.6?

Kein Setup erforderlich. Das 1M-Kontextfenster ist seit März 2026 automatisch auf Claude Codes Max-Plan, Teams- und Enterprise-Stufen verfügbar. Wenn du auf einem dieser Pläne bist, ist es bereits aktiv.

Sollte ich den Kontext bei 200K Tokens löschen oder bis 1M weiterarbeiten?

Für präzisionskritische Arbeit wie Produktions-Refactoring lösche bei etwa 200K Tokens. Für explorative Sitzungen oder langes Debuggen push bequem auf 400K-500K. Die Faustregel von 2% Degradation pro 100K Tokens hilft dir bei der Entscheidung. Für eine detailliertere Aufschlüsselung siehe Meine empfohlene Kontextstrategie oben.

Kostet das 1M-Kontextfenster mehr als das Standard-200K?

Nein. Anthropic hat den Kostenmultiplikator für Kontext jenseits von 200K Tokens abgeschafft. Die Preise sind einheitlich, ob deine Sitzung 9K oder 900K Tokens nutzt. Siehe Was ist mit den Kosten oben für Details.

Wie schneidet Opus 4.6 im Vergleich zu GPT 5.4 bei Long-Context-Aufgaben ab?

Beide Modelle erzielen ungefähr 78 beim Acht-Nadel-Benchmark — statistisch gleichauf bei der reinen Erinnerung. Opus 4.6 hat einen leichten Vorteil bei der Claude Code-Workflow-Integration und den einheitlichen Preisen. Siehe die Benchmark-Vergleichstabelle im Abschnitt Der Acht-Nadel-Test.

Was ist Claude Codes Autocompact-Buffer und ändert 1M etwas daran?

Claude Codes Autocompact-Buffer bleibt bei 33K Tokens — das ist der "heiße" Arbeitsspeicher für unmittelbares Hin und Her. Die 1M-Erweiterung vergrößert den gesamten referenzierbaren Kontext, nicht den aktiven Buffer. Siehe Ein Hinweis zu Claude Codes Autocompact-Buffer für Details zum Zusammenspiel der beiden.

Let's Work Together

Looking to build AI systems, automate workflows, or scale your tech infrastructure? I'd love to help.

- Fiverr (custom builds & integrations): fiverr.com/s/EgxYmWD

- Portfolio: mejba.me

- Ramlit Limited (enterprise solutions): ramlit.com

- ColorPark (design & branding): colorpark.io

- xCyberSecurity (security services): xcybersecurity.io