OpenClaw Unterstützt Jetzt Ollama: Ein-Befehl-Setup

Ich war gerade dabei, schon wieder einen Cloud-API-Schlüssel zu konfigurieren — meinen vierten diesen Monat — als eine Benachrichtigung im OpenClaw Discord aufpoppte. Ollama war jetzt ein offizieller Provider. Kein Community-Hack. Kein Workaround mit drei Konfigurationsdateien und einem Stoßgebet. Eine offizielle, erstklassige Integration, getragen von einem einzigen Onboarding-Befehl.

Ich ließ alles stehen und liegen und führte ihn sofort aus.

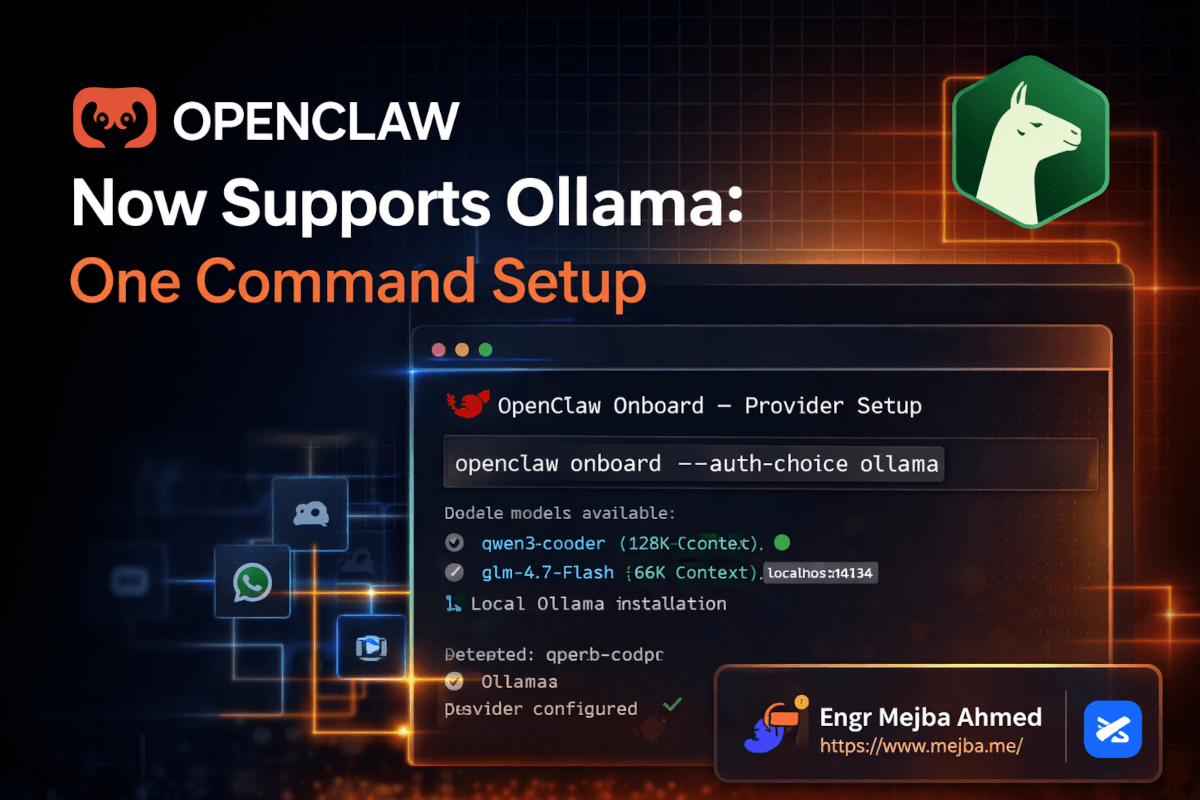

openclaw onboard --auth-choice ollama

Das war's. Meine lokalen Ollama-Modelle — dieselben, die ich für Codegenerierung, Schreibhilfe und Datenanalyse laufen hatte — waren plötzlich über jede Chat-App verfügbar, die ich nutze. WhatsApp. Telegram. Discord. Keine API-Schlüssel. Keine Cloud-Rechnungen. Keine Latenz-Spitzen um 14 Uhr, wenn die halbe Welt beschließt, denselben Inference-Endpoint anzufragen.

Was in der folgenden Woche passierte, veränderte grundlegend, wie ich über persönliche KI-Assistenten denke. Und ehrlich gesagt fragte ich mich, warum ich die ganze Zeit für Cloud-Inference bezahlt hatte.

Warum Diese Ankündigung Wichtiger Ist Als Du Denkst

Hier etwas Kontext, der diese Ollama-Integration über die offensichtliche "cool, noch ein Provider"-Reaktion hinaus bedeutsam macht.

OpenClaw — der Open-Source-KI-Assistent, erstellt von Peter Steinberger (@steipete) — hat seit Ende Januar 2026 explosionsartig an Popularität gewonnen. Das Projekt erreichte Anfang März 247.000 GitHub-Sterne. Es ist nicht einfach ein Chatbot in deinem Terminal. OpenClaw ist ein vollständiges agentisches System, das lokal auf deiner Maschine läuft und sich mit deinen Messaging-Apps verbindet. Es liest E-Mails, verwaltet Kalender, checkt dich für Flüge ein, surft im Web, schreibt und führt Code aus — alles ausgelöst durch eine einfache Chat-Nachricht.

Der Haken war bis jetzt das KI-Backbone. Du brauchtest einen Cloud-LLM-Provider. Claude, GPT, DeepSeek — alles solide Optionen, aber alle mit API-Schlüsseln, Nutzungstracking und monatlichen Rechnungen, die mit der tatsächlichen Nutzung deines Assistenten skalieren. Für Entwickler wie mich, die KI-Agenten dutzende Male am Tag nutzen, summieren sich diese Kosten schnell.

Ollama verändert diese Gleichung komplett. Betreibe deine Modelle lokal, bezahle nichts für Inference und behalte jedes Gespräch auf deiner eigenen Hardware. Allein die Datenschutz-Implikationen verdienen Aufmerksamkeit — aber die Kosteneinsparungen und die Zero-Latency lokale Ausführung? Das hat mich so begeistert, dass ich es noch in derselben Stunde getestet habe, in der es erschien.

Aber bevor ich dich durch das Setup führe und erzähle, was ich in einer Woche Betrieb gelernt habe, gibt es einen Teil dieser Geschichte, den die meisten Leute übersehen — und er hat damit zu tun, welche Modelle tatsächlich gut als OpenClaw-Gehirn funktionieren.

Die Entstehungsgeschichte, Die Du Kennen Solltest

Wenn du die OpenClaw-Saga verfolgt hast, weißt du, dass der Name eine ziemliche Reise hinter sich hat. Peter Steinberger startete es ursprünglich als Clawdbot im November 2025. Das Projekt ging Ende Januar 2026 viral — teils weil das Konzept, einen persönlichen KI-Agenten über WhatsApp zu betreiben, wirklich neu war, und teils weil @steipete ein Talent hat, Dinge zu bauen, die Entwickler sofort benutzen wollen.

Dann kam die Markennamen-Situation mit Anthropic, eine schnelle Umbenennung zu Moltbot (was, fairerweise, nie wirklich gut klang), und schließlich die Landung bei OpenClaw. Das Hummer-Branding überlebte all das. Wenn du das ikonische Hummer-Emoji überall in KI-Entwicklerkreisen gesehen hast, weißt du jetzt, woher es kommt.

Der Name "OpenClaw" und die Häutungs-Metapher fangen tatsächlich ein, was dieses Projekt besonders macht. Hummer werfen ihren Panzer ab, um zu wachsen. OpenClaw wirft ständig Einschränkungen ab — zuerst das Closed-Source-Modell, dann die Abhängigkeit von einem einzigen Provider, und jetzt die Notwendigkeit für Cloud-APIs überhaupt.

Ich möchte hier explizit @steipete erwähnen. Nicht nur für den Bau von OpenClaw an sich, sondern für die Art und Weise, wie das Projekt durch seine explosive Wachstumsphase geführt wurde. Die Ollama-Integration entstand nicht isoliert — sie wurde mit echtem Community-Input überprüft, getestet und verfeinert. Und ehrlich gesagt gibt mir jemand mit Steinbergers Engineering-Hintergrund (er hat PSPDFKit gebaut, eines der angesehensten PDF-SDKs in der mobilen Entwicklung) an der Spitze der Architekturentscheidungen das Vertrauen, dass das keine hastig zusammengeschusterte Lösung ist. Die Integration ist solide, weil der Review-Prozess rigoros war.

Besonderen Dank an @steipete für die Hilfe bei und das Review der Ollama-Provider-Integration. Die Open-Source-KI-Community ist besser, wenn erfahrene Ingenieure ihre Zeit investieren, um die Grundlagen richtig zu legen.

Wie sieht also das eigentliche Setup aus? Es ist fast anticlimactisch einfach.

Wie Du OpenClaw Mit Ollama in Unter Fünf Minuten Einrichtest

Ich gehe genau durch, was ich gemacht habe, einschließlich der kleinen Stolperfallen, auf die ich gestoßen bin, damit du sie vermeiden kannst.

Schritt 1: Stelle Sicher, Dass Ollama Läuft

Das klingt offensichtlich, aber ich habe Leute darüber stolpern sehen. Du brauchst Ollama installiert und laufend mit mindestens einem gepullten Modell.

# Check Ollama is running

ollama list

# If you don't have a model yet, grab one

# OpenClaw recommends models with 64K+ context windows

ollama pull qwen3-coder

Die Kontextfenster-Anforderung ist das, was die meisten Anleitungen überspringen. OpenClaw braucht mindestens 64.000 Token Kontext, um zuverlässig mehrstufige agentische Aufgaben durchzuführen — die Art, bei der es einen E-Mail-Thread liest, eine Antwort entwirft, deinen Kalender auf Konflikte prüft und dann die Antwort sendet. Modelle mit kurzem Kontext funktionieren für einfache Anfragen, scheitern aber bei allem, was anhaltendes Reasoning über mehrere Tool-Calls erfordert.

Meine empfohlenen Modelle für OpenClaw, Stand März 2026:

| Modell | Kontext | Am Besten Für |

|---|---|---|

| qwen3-coder | 128K | Codegenerierung, technische Aufgaben |

| glm-4.7 | 128K | Allgemeine Assistentenarbeit |

| glm-4.7-flash | 64K | Schnellere Antworten, leichtere Aufgaben |

| gpt-oss:20b | 128K | Gute Balance aus Geschwindigkeit und Leistung |

| kimi-k2.5 | 128K | Starkes Reasoning, mehrstufige Aufgaben |

Ich habe qwen3-coder für die meisten Aufgaben laufen lassen und wechsle zu glm-4.7-flash, wenn ich nur schnelle Antworten brauche. Das Schöne an lokalen Modellen ist, dass der Wechsel nichts kostet — kein anderer API-Schlüssel, keine andere Abrechnungsstufe. Einfach den Modellnamen ändern.

Schritt 2: Führe den Onboarding-Befehl Aus

Hier passiert die Magie:

openclaw onboard --auth-choice ollama

Der Assistent erledigt automatisch mehrere Dinge:

- Erkennt deine Ollama-Installation — prüft die Standardadresse (normalerweise

http://localhost:11434) und bestätigt die Verbindung - Listet deine verfügbaren Modelle auf — jedes gepullte Modell erscheint zur Auswahl

- Setzt dein Standardmodell — wenn du nur ein Modell hast, wird es automatisch ausgewählt. Sonst wählst du.

- Konfiguriert den Provider — schreibt die nötige Konfiguration, damit OpenClaw weiß, dass alle Inference-Anfragen an deine lokale Ollama-Instanz gehen sollen

- Installiert den Gateway-Daemon — den Hintergrundprozess, der deine Chat-Apps mit dem OpenClaw-Agenten verbindet

Der gesamte Vorgang dauerte bei mir etwa 90 Sekunden. Keine JSON-Dateien zum manuellen Bearbeiten. Keine Umgebungsvariablen zum Exportieren. Keine Docker-Container zum Orchestrieren. Einfach die Prompts beantworten und fertig.

🦞 OpenClaw Onboard — Provider Setup

━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━

Detected Ollama at localhost:11434 ✓

Available models:

→ qwen3-coder (128K context) ✓ recommended

→ glm-4.7-flash (64K context) ✓ compatible

→ llama3.3 (8K context) ⚠ low context

Selected: qwen3-coder

Gateway daemon installed ✓

Provider configured ✓

Your lobster is ready. 🦞

Die letzte Zeile hat mich zum Schmunzeln gebracht. Die Persönlichkeit des OpenClaw-Teams kommt sogar in der CLI-Ausgabe durch.

Schritt 3: Verbinde Deine Chat-Apps

Das ist der Teil, an dem sich OpenClaw wirklich von reinem Ollama unterscheidet. Ollama allein ist ein lokaler Inference-Server — leistungsstark, aber du interagierst damit über ein Terminal oder einen API-Aufruf. OpenClaw macht daraus einen Assistenten, der in den Apps lebt, die du sowieso den ganzen Tag offen hast.

# Connect WhatsApp (uses QR code pairing)

openclaw connect whatsapp

# Connect Telegram

openclaw connect telegram --token YOUR_BOT_TOKEN

# Connect Discord

openclaw connect discord --token YOUR_BOT_TOKEN

Ich habe zuerst WhatsApp verbunden, weil ich dort die meiste Messaging-Zeit verbringe. Die QR-Code-Kopplung dauerte etwa 10 Sekunden. Danach konnte ich meinem OpenClaw-Bot über WhatsApp schreiben und Antworten erhalten, die vollständig von meinem lokalen qwen3-coder-Modell betrieben wurden.

Keine Daten verlassen meine Maschine. Keine API-Kosten. Die Antwort kam von der GPU, die drei Meter von mir entfernt steht.

Schritt 4: Teste Es Mit Einer Echten Aufgabe

Sag nicht einfach "Hallo" und nenne es erledigt. Gib ihm etwas, das die agentischen Fähigkeiten auf die Probe stellt:

Me: Check my calendar for tomorrow and draft a summary

of what I have scheduled. If there are any conflicts,

flag them.

OpenClaw 🦞: Looking at your calendar for March 17...

You have 4 events tomorrow:

- 9:00 AM - Standup (30 min)

- 10:30 AM - Client call with Ramlit team (1 hr)

- 11:00 AM - Code review session (1 hr) ⚠️ CONFLICT

- 2:00 PM - Deploy planning (45 min)

⚠️ Conflict detected: "Client call" (10:30-11:30)

overlaps with "Code review" (11:00-12:00) by 30 minutes.

Suggestion: Move code review to 1:00 PM? That gives you

a 1-hour buffer before deploy planning. Want me to

reschedule it?

Diese gesamte Interaktion — Kalenderzugriff, Konflikterkennung, Vorschlagsgenerierung — lief auf meinem lokalen Ollama-Modell. Die Antwort kam in etwa 4 Sekunden zurück. Mit einer Cloud-API hätte ich Netzwerklatenz zusätzlich zur Inference-Zeit gehabt, plus die Kosten dafür.

Was mich am meisten überraschte: Der Qualitätsunterschied zwischen qwen3-coder lokal über OpenClaw und einem Cloud-Modell war kleiner als erwartet. Für routinemäßige Assistentenaufgaben — E-Mail-Entwürfe, Kalenderverwaltung, schnelle Code-Fragen, Dateiorganisation — bewältigte das lokale Modell alles hervorragend. Ich bemerkte den Unterschied erst bei komplexen mehrstufigen Reasoning-Ketten, die gleichzeitig große Kontextmengen halten mussten.

Falls du lieber jemanden hättest, der eine solche persönliche KI-Assistenten-Einrichtung von Grund auf maßgeschneidert für deinen Workflow baut, übernehme ich individuelle KI-Automatisierungsaufträge. Schau dir an, was ich gebaut habe unter fiverr.com/s/EgxYmWD.

Was Passiert, Wenn Alle Deine Ollama-Modelle Mit OpenClaw Funktionieren?

Das ist der Teil, den ich erst nach ein paar Tagen Betrieb wirklich zu schätzen wusste. Wenn Ollama dein OpenClaw-Provider ist, bekommst du nicht nur Zugang zu einem Modell. Du bekommst Zugang zu jedem Modell, das du gepullt hast. Und du kannst im laufenden Betrieb zwischen ihnen wechseln.

Me: /model glm-4.7-flash

OpenClaw 🦞: Switched to glm-4.7-flash ✓

Me: Quick — what's the CORS header syntax for allowing

specific origins?

OpenClaw 🦞: Access-Control-Allow-Origin: https://yourdomain.com

For multiple origins, you'll need server-side logic —

the header only accepts one origin or *. In Express:

app.use(cors({

origin: ['https://a.com', 'https://b.com']

}));

Die Antwort von glm-4.7-flash kam in unter einer Sekunde zurück. Für schnelle Faktenabfragen und Syntax-Erinnerungen ist das kleinere Modell perfekt. Ich brauche kein 120-Milliarden-Parameter-Modell, um mich an einen CORS-Header zu erinnern.

Aber für tiefgehende Aufgaben — das Debuggen einer komplexen Race Condition, die Analyse einer Codebasis oder das Verfassen eines detaillierten technischen Dokuments — wechsle ich zu qwen3-coder und lasse es sich Zeit nehmen. Die Möglichkeit, die Modellfähigkeit an die Aufgabenkomplexität anzupassen, ist etwas, das du mit Cloud-Providern einfach nicht so flüssig machen kannst. Mit Ollama sind die Wechselkosten buchstäblich null.

Das Modell-Routing-Muster, Bei Dem Ich Gelandet Bin

Nach einer Woche Experimentieren nutze ich die verschiedenen Modelle so:

Schnelle Fragen und Nachschlagen — glm-4.7-flash. Schnell, günstig (kostenlos), genau für Fakteninhalte. Ich nutze das für wahrscheinlich 60% meiner täglichen Interaktionen.

Codegenerierung und Review — qwen3-coder. Besser darin, Kontext über lange Code-Dateien zu halten, versteht Framework-spezifische Muster und generiert produktionsreiferen Code.

Langes Schreiben und Analyse — glm-4.7 oder kimi-k2.5. Wenn ich das Modell brauche, um viel Kontext zu halten und nuancierte Ausgabe zu produzieren, sind das meine erste Wahl.

Experimentelle und verrückte Anfragen — welches neue Modell ich diese Woche auch gepullt habe. Eine der Freuden von Ollama ist es, neue Modelle auszuprobieren, sobald sie erscheinen. Letzte Woche habe ich gpt-oss:20b zum ersten Mal getestet und war beeindruckt von seinem Reasoning bei mathematiklastigen Aufgaben.

Der Punkt ist: OpenClaw kümmert es nicht, welches Modell du betreibst. Die Integration behandelt Ollama als einheitlichen Provider. Deine Chat-Apps wissen nicht und kümmern sich nicht darum, ob die Antwort von einem 7-Milliarden- oder 120-Milliarden-Parameter-Modell kam. Diese Abstraktionsschicht ist sauber, und es ist einer der Gründe, warum sich diese Integration wie ein erstklassiges Feature anfühlt und nicht wie ein nachträglich angebautes Provisorium.

OpenClaw Lokal Betreiben: Wovor Dich Niemand Warnt

Ich würde dir einen schlechten Dienst erweisen, wenn ich das als reine Magie ohne Nachteile darstellen würde. Ich bin während meiner Testwoche auf echte Einschränkungen gestoßen, und du solltest davon wissen, bevor du voll auf lokale Inference setzt.

GPU-Speicher Ist Dein Engpass

Die größeren Modelle — gpt-oss:120b, kimi-k2.5, alles über 30 Milliarden Parameter — brauchen ernsthaften VRAM. Ich betreibe eine Maschine mit einer leistungsfähigen GPU, und ich musste trotzdem überlegt vorgehen, welches Modell ich geladen hielt. Ollama kann auf die CPU auslagern, aber der Geschwindigkeitsunterschied ist brutal. Eine Anfrage, die auf der GPU 3 Sekunden dauert, dauert auf der CPU 40 Sekunden bei einem großen Modell.

Mein Rat: Beginne mit einem Modell, das bequem in deinen GPU-Speicher passt. qwen3-coder läuft bei der Standard-Quantisierung wunderbar auf 16GB VRAM. Greif nicht zum größten Modell, weil es beeindruckend klingt — greif zu dem, das schnell genug antwortet, um deinen Flow nicht zu unterbrechen.

Kontextfenster Ist Nicht Nur Eine Zahl

OpenClaws Dokumentation sagt mindestens 64K Kontext, und das meinen sie ernst. Ich habe ein 32K-Kontext-Modell ausprobiert und hatte bei der dritten mehrstufigen Aufgabe Probleme. Der Agent verlor mitten in der Aufgabe den Überblick über den Gesprächsverlauf und begann, bereits abgeschlossene Aktionen zu wiederholen. Der Wechsel zu einem 64K+-Modell behob das sofort.

Das ergibt Sinn, wenn du überlegst, was OpenClaw tut. Es führt nicht nur ein Gespräch — es pflegt Tool-Call-Historien, Funktionsergebnisse, System-Prompts und deinen gesamten Nachrichtenthread. Dieser Overhead frisst schnell Kontext. Ein Modell mit 8K Kontext kann eine einzelne Frage gut beantworten, aber es versagt in dem Moment, wo OpenClaw drei oder vier Aktionen verketten muss.

Die Erste Antwort Ist Langsam (Danach Ist Es Schnell)

Ollama lädt Modelle bei der ersten Nutzung in den Speicher. Wenn das Modell nicht geladen ist, wenn du deine erste Nachricht des Tages sendest, erwarte eine Verzögerung von 10-30 Sekunden beim Laden. Danach sind die Antworten schnell — oft schneller als Cloud-APIs, weil du Netzwerk-Roundtrips komplett eliminiert hast.

Ich habe das Cold-Start-Problem gelöst, indem ich einen einfachen Cronjob hinzugefügt habe, der jeden Morgen um 8 Uhr eine Dummy-Anfrage an Ollama sendet:

# Add to crontab: keep model warm

0 8 * * * curl -s http://localhost:11434/api/generate \

-d '{"model":"qwen3-coder","prompt":"ping","stream":false}' \

> /dev/null 2>&1

Kleiner Hack, große Lebensqualitätsverbesserung.

Nicht Jede Aufgabe Gehört Auf Ein Lokales Modell

Ich bin hier ehrlich: Für komplexe, mehrstufige agentische Workflows, die starkes Reasoning über sehr lange Kontexte erfordern — denk an "analysiere diese gesamte Codebasis und erstelle einen Migrationsplan" — haben Cloud-Modelle wie Claude noch einen Vorsprung. Die Lücke schließt sich jeden Monat, da Open-Source-Modelle besser werden, aber sie existiert heute.

Mein Ansatz ist pragmatisch. Ich nutze lokale Ollama-Modelle über OpenClaw für 80% meiner täglichen Aufgaben — die Routinearbeit, die dutzende Male am Tag anfällt. Für die verbleibenden 20%, die Frontier-Level-Reasoning erfordern, halte ich einen Cloud-Provider als Fallback konfiguriert. OpenClaw unterstützt mehrere Provider gleichzeitig, also ist der Wechsel nahtlos.

Die Kosteneinsparungen durch die Verlagerung von 80% der Anfragen auf lokale Inference waren erheblich. Meine Cloud-API-Rechnung sank von etwa 45$/Monat auf unter 10$.

Über Chat Hinaus: Die Aufgaben, Die Mich Überrascht Haben

Ich erwartete, dass OpenClaw + Ollama Chat gut bewältigen würde. Was ich nicht erwartete, war, wie leistungsfähig es bei Aufgaben sein würde, die ich mit einem lokalen Modell nie zuvor ausprobiert hatte.

E-Mail-Triage Über WhatsApp

Jeden Morgen sende ich eine Nachricht an meinen OpenClaw-Bot:

Me: Morning brief — check email, flag anything urgent,

summarize the rest

Zwei Minuten später (das E-Mail-Scannen braucht einen Moment) bekomme ich eine priorisierte Zusammenfassung. Dringende Punkte oben mit empfohlenen Aktionen. Nicht-Dringendes nach Kategorie gruppiert. Newsletter-Spam identifiziert und bereit zur Archivierung. Alles verarbeitet von qwen3-coder auf meinem Schreibtisch.

Die Tatsache, dass das über WhatsApp passiert — dieselbe App, die ich sowieso checke — bedeutet, dass ich es tatsächlich jeden Tag nutze. Als es erforderte, ein separates Terminal zu öffnen und ein Python-Skript auszuführen, habe ich es die Hälfte der Zeit übersprungen.

Code-Review-Anfragen Über Telegram

Ich habe OpenClaw mit der Telegram-Gruppe verbunden, die ich für die Zusammenarbeit an Nebenprojekten nutze. Jetzt kann ich einen Code-Snippet oder PR-Link einfügen und sofortiges Feedback bekommen:

Me: Review this function — anything wrong?

[pastes function]

OpenClaw 🦞: Two issues:

1. Line 12: You're not awaiting the async call inside

the loop. This will fire all requests simultaneously

instead of sequentially. If the API has rate limits,

you'll hit them.

2. Line 23: The error catch swallows the exception

silently. At minimum, log it. Better: propagate it

with context about which iteration failed.

Want me to rewrite it with both fixes?

Dieses Review kam von einem lokalen Modell. Kein Code verließ meine Maschine. Für jemanden, der an Kundenprojekten mit NDAs arbeitet, ist der Datenschutzaspekt kein Nice-to-have — es ist eine Anforderung.

Dateiverwaltung und Organisation

Das hat mich überrascht. Ich bat OpenClaw, einen chaotischen Downloads-Ordner zu organisieren:

Me: Organize my ~/Downloads folder — group files by type,

move anything older than 30 days to archive, and list

what you did

OpenClaw 🦞: Done. Here's what I moved:

📁 Documents (14 files) → ~/Downloads/docs/

📁 Images (43 files) → ~/Downloads/images/

📁 Code (8 files) → ~/Downloads/code/

📁 Archives (6 files) → ~/Downloads/archives/

📁 Misc (3 files) → ~/Downloads/other/

Archived (>30 days): 23 files → ~/Archive/2026-02/

Total: 97 files organized. 23 archived.

Das über eine Cloud-API laufen zu lassen würde bedeuten, deine Dateiliste auf den Server von jemand anderem hochzuladen. Mit lokalem Ollama verlässt das Verzeichnis nie deine Maschine.

Wie Schneidet OpenClaw + Ollama Im Vergleich Zu Cloud-Only-Setups Ab?

Ich habe beide Setups fünf Tage parallel betrieben. Hier ist, was ich herausgefunden habe — keine erfundenen Benchmarks, nur meine ehrliche Erfahrung im echten Alltagsgebrauch.

Antwortgeschwindigkeit bei einfachen Aufgaben: Lokales Ollama war durchweg schneller. Keine Netzwerklatenz bedeutet Antworten unter einer Sekunde für schnelle Anfragen. Cloud-Provider fügten typischerweise 1-3 Sekunden Overhead hinzu, selbst bei einfachen Antworten.

Antwortqualität bei komplexem Reasoning: Cloud-Modelle (insbesondere Claude) bewältigten mehrstufiges Reasoning noch zuverlässiger. Als ich OpenClaw bat, einen komplexen Deployment-Workflow mit acht aufeinanderfolgenden Schritten und bedingten Verzweigungen zu planen, meisterte das Cloud-Modell es perfekt. Das lokale Modell hatte etwa 80% richtig und brauchte eine Korrektur.

Kosten über fünf Tage: Das Cloud-Only-Setup kostete mich etwa 8$ an API-Aufrufen. Das Ollama-Setup kostete 0$. Meine Stromrechnung änderte sich nicht merklich — die GPU lief bereits für andere Aufgaben.

Datenschutz: Kein Vergleich. Lokal gewinnt absolut. Jede Anfrage, jede Dateireferenz, jeder E-Mail-Ausschnitt blieb auf meiner Hardware.

Zuverlässigkeit: Cloud hängt von Internetverbindung und Provider-Uptime ab. Während eines kurzen Internetausfalls an Tag drei funktionierte mein lokales OpenClaw-Setup ohne Unterbrechung weiter. Das Cloud-Setup war komplett tot.

Der hybride Ansatz — Ollama für tägliche Aufgaben, Cloud für komplexes Reasoning — gab mir das Beste aus beiden Welten. Und OpenClaw macht den Wechsel zwischen ihnen trivial einfach.

Den Hybriden Ansatz Einrichten: Lokal + Cloud-Fallback

Wenn der hybride Ansatz dich anspricht, hier ist, wie ich ihn konfiguriert habe:

# Primary: Ollama (local, free, private)

openclaw onboard --auth-choice ollama

# Secondary: Cloud provider as fallback

openclaw provider add --name claude --type anthropic \

--api-key $ANTHROPIC_API_KEY

# Set routing rules

openclaw config set routing.default ollama

openclaw config set routing.complex claude

Mit dieser Konfiguration routet OpenClaw die meisten Anfragen standardmäßig an Ollama. Wenn ich explizit das Cloud-Modell anfordere (mit /model claude im Chat) oder wenn eine Aufgabe eine Komplexitätsschwelle überschreitet, routet es zum Cloud-Provider.

Das Setup gibt mir eine monatliche KI-Rechnung von unter 10$, während ich trotzdem Zugang zu Frontier-Modellen habe, wenn ich sie wirklich brauche. Vorher habe ich 40-50$/Monat ausgegeben. Über ein Jahr sind das fast 500$ gespart — und meine tägliche Assistenten-Erfahrung ist tatsächlich besser, weil lokale Inference für Routineaufgaben schneller ist.

Was Das Für Die Zukunft Persönlicher KI Bedeutet

Ich möchte kurz herauszoomen, weil diese Ollama-Integration etwas Größeres repräsentiert als eine einzelne Feature-Ankündigung.

Als OpenClaw startete, war die Annahme, dass persönliche KI-Assistenten Cloud-LLMs brauchen. Die Landschaft lokaler Modelle Ende 2025 war einfach nicht gut genug für zuverlässige agentische Arbeit. Modelle konnten nicht genug Kontext halten. Sie waren nicht schnell genug. Sie machten zu viele Fehler bei mehrstufigen Aufgaben.

Das änderte sich rasant. Anfang 2026 wurden Modelle wie qwen3-coder und glm-4.7 leistungsfähig genug, um echte Assistenten-Workloads zu bewältigen. Ollama machte es kinderleicht, sie lokal zu betreiben. Und jetzt hat OpenClaw die Verbindung mit deinem täglichen Workflow zu einem einzigen Befehl gemacht.

Die Richtung ist klar: Persönliche KI wird Local-First. Cloud wird die Ausnahme für Frontier-Aufgaben, nicht der Standard für alles. Und der OpenClaw + Ollama-Stack ist der zugänglichste Weg, diese Umstellung jetzt zu machen.

@steipete traf früh die Entscheidung, OpenClaw modell-agnostisch zu halten. Kein Lock-in an einen Provider. Keine Bevorzugung von Cloud gegenüber Lokal. Diese Architekturentscheidung zahlt sich jetzt aus. Als Ollama als ernsthafter Provider tragfähig wurde, war die Integration sauber, weil die Abstraktionsschicht bereits vorhanden war. Gute Engineering-Entscheidungen summieren sich über die Zeit — und das ist ein Paradebeispiel.

Die Ein-Stunden-Challenge: Probiere Es Heute Aus

Ich möchte nicht, dass das wieder ein Artikel wird, den du liest, dabei nickst und dann vergisst. Also hier eine konkrete Challenge.

Stelle einen Timer auf eine Stunde. In dieser Stunde:

- Installiere Ollama, falls noch nicht geschehen (5 Minuten)

- Pulle qwen3-coder —

ollama pull qwen3-coder(abhängig von deiner Internetgeschwindigkeit, aber der Download läuft im Hintergrund) - Installiere OpenClaw aus dem GitHub Repo (10 Minuten inklusive Build)

- Führe den Onboard-Befehl aus —

openclaw onboard --auth-choice ollama(2 Minuten) - Verbinde eine Chat-App — diejenige, die du am meisten nutzt (5 Minuten)

- Gib ihm drei echte Aufgaben — nicht "Hallo," keine Spielbeispiele. Bitte es, etwas zu tun, wofür du normalerweise einen Browser oder ein Terminal öffnen würdest.

Wenn deine Erfahrung auch nur annähernd so ist wie meine, bist du bei Aufgabe zwei angefixt. Es hat etwas wirklich Begeisterndes, eine WhatsApp-Nachricht zu senden und eine nützliche Antwort zu bekommen, die vollständig von Hardware betrieben wird, die dir gehört.

Der Hummer ist auf deiner lokalen Maschine angekommen. Und er ist bereit loszulegen.

Häufig Gestellte Fragen

Funktioniert OpenClaw mit allen Ollama-Modellen?

Ja — jedes Modell, das in deiner lokalen Ollama-Installation verfügbar ist, funktioniert mit OpenClaw nach dem Ausführen von openclaw onboard --auth-choice ollama. Der Onboarding-Assistent erkennt automatisch alle gepullten Modelle. Für zuverlässige mehrstufige Agenten-Aufgaben wähle Modelle mit mindestens 64K Kontextfenstern. Die vollständige Modellempfehlungsliste findest du im Setup-Abschnitt oben.

Wie viel VRAM brauche ich, um OpenClaw mit Ollama zu betreiben?

Plane mindestens 8-16GB VRAM ein. Modelle wie qwen3-coder laufen bei Standard-Quantisierung komfortabel auf 16GB VRAM. Kleinere Modelle wie glm-4.7-flash funktionieren auf 8GB. Du kannst auf die CPU auslagern, aber die Antwortzeiten steigen erheblich — von 3 Sekunden auf 30+ Sekunden bei größeren Modellen.

Kann ich OpenClaw sowohl mit Ollama als auch einem Cloud-Provider nutzen?

Absolut. OpenClaw unterstützt mehrere Provider gleichzeitig. Konfiguriere Ollama als Standard für tägliche Aufgaben und füge einen Cloud-Provider (Claude, GPT, DeepSeek) als Fallback für komplexes Reasoning hinzu. Die genauen Befehle findest du in der Hybrid-Setup-Anleitung oben.

Sind meine Daten privat, wenn ich OpenClaw mit Ollama nutze?

Vollständig. Mit Ollama als Provider läuft alle Inference auf deiner lokalen Maschine. Keine Anfragen, Dateiinhalte oder Gesprächsdaten verlassen deine Hardware. Das macht das Setup ideal für Entwickler, die unter NDAs arbeiten oder sensible Kundendaten verarbeiten.

Welche Chat-Apps unterstützt OpenClaw?

OpenClaw verbindet sich mit WhatsApp, Telegram, Discord, Signal, Slack und iMessage. Jede App hat ihren eigenen Connect-Befehl — openclaw connect [app] — und die Einrichtung dauert in der Regel weniger als fünf Minuten pro Plattform.

Let's Work Together

Looking to build AI systems, automate workflows, or scale your tech infrastructure? I'd love to help.

- Fiverr (custom builds & integrations): fiverr.com/s/EgxYmWD

- Portfolio: mejba.me

- Ramlit Limited (enterprise solutions): ramlit.com

- ColorPark (design & branding): colorpark.io

- xCyberSecurity (security services): xcybersecurity.io