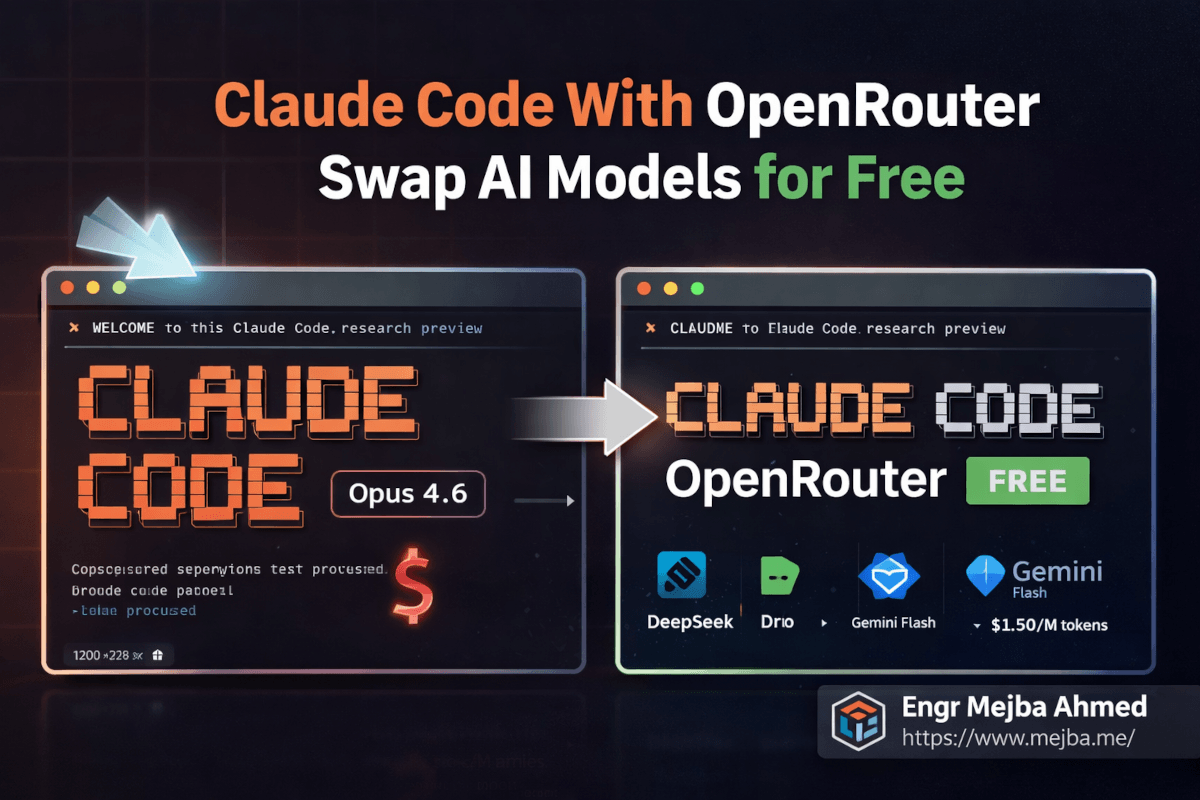

Claude Code mit OpenRouter: KI-Modelle kostenlos wechseln

Mein Claude Max-Abonnement kostet mich $200 pro Monat. Für Kundenarbeit, Enterprise-Projekte und alles, wo Zuverlässigkeit nicht verhandelbar ist — jeden Cent wert. Ich denke keine Sekunde darüber nach.

Aber letzten Dienstag um 1 Uhr nachts arbeitete ich am Prototyp eines Nebenprojekts. Ein persönliches Automatisierungstool. Nichts Kritisches. Und mein Abonnement erreichte mitten im Gespräch seine Nutzungsgrenze. Claude Code fror ein. Der Agent stoppte mitten in einer Dateibearbeitung, und ich starrte auf ein Terminal, das mir sagte, ich solle warten oder upgraden.

Ich wollte nicht warten. Und ich wollte definitiv kein zusätzliches Geld für ein Hobbyprojekt um ein Uhr nachts ausgeben. Also tat ich etwas, das ich seit Wochen testen wollte: Ich verwies Claude Code auf OpenRouter, tauschte das zugrunde liegende KI-Modell gegen ein komplett kostenloses aus und arbeitete einfach weiter.

Der Agent machte genau dort weiter, wo er aufgehört hatte. Dieselben Dateibearbeitungen. Dieselben Terminalbefehle. Derselbe mehrstufige agentische Workflow. Anderes Gehirn — aber die Hände blieben dieselben.

Diese Nacht hat meine gesamte Sichtweise auf Claude Code verändert. Und sie wird wahrscheinlich auch verändern, wie du es nutzt, sobald du den Trick verstehst.

Die Formel-1-Analogie, die alles verständlich macht

Hier ist das Denkmodell, das dieses Konzept für mich endlich intuitiv gemacht hat.

Claude Code ist ein Formel-1-Wagen. Das Chassis, die Aerodynamik, die Lenkung, das Telemetriesystem, das Boxencrew-Team — das ist das agentische Framework. Dateien lesen, Code bearbeiten, Terminalausführung, Git-Verwaltung, Sub-Agents, Skill-Systeme. Die gesamte Ingenieursleistung steckt im Auto selbst.

Das KI-Modell? Das ist einfach der Motor.

Anthropic liefert Claude Code mit ihrem eigenen Motor aus — Opus 4.6, Sonnet, was auch immer deine Abonnementstufe bietet. Und es ist ein phänomenaler Motor. Best in Class für viele Aufgaben. Aber hier ist, was die meisten Leute nicht realisieren: Du kannst diesen Motor ausbauen und einen komplett anderen einsetzen. Einen Google-Motor. Einen DeepSeek-Motor. Einen kostenlosen Open-Source-Motor. Das Auto fährt weiterhin. Die Lenkung funktioniert weiterhin. Die Boxencrew macht weiterhin ihren Job.

Und anders als bei einem echten Formel-1-Wagen brauchst du keine leistungsstarke lokale Maschine, um das alles zu betreiben. Claude Code läuft in der Cloud. Dein Laptop ist nur die Fernbedienung. Ob du es auf einem MacBook Pro für $3.000 oder einem Chromebook für $300 laufen lässt — die rechenintensive Arbeit findet auf Remote-Servern statt. Du sendest Anweisungen und empfängst Ergebnisse — die Model-Inferenz läuft ganz woanders.

Das ist der Punkt, an dem viele Leute ins Stolpern geraten. Sie nehmen an, dass das Ausführen von Claude Code mit verschiedenen Modellen ein leistungsstarkes lokales Setup erfordert. Das stimmt nicht. Du brauchst ein Terminal, eine Internetverbindung und etwa zehn Minuten für die Konfiguration.

Die eigentliche Frage ist nicht, ob du den Motor wechseln kannst. Sondern welchen Motor du wählen solltest und wann es sinnvoll ist, den Standardmotor zu verwenden. Hier wird es interessant — und hier habe ich eine solide Woche mit Tests verbracht, damit du das nicht musst.

Die vier Kompromisse, die du tatsächlich eingehst

Bevor ich dich durch die Einrichtung führe, musst du verstehen, was du eintauschst. Der Wechsel von Anthropics Premium-Modellen zu Alternativen ist kein Gratismittagessen — selbst wenn das Modell selbst kostenlos ist. Es gibt genau vier Dimensionen, in denen sich der Kompromiss zeigt.

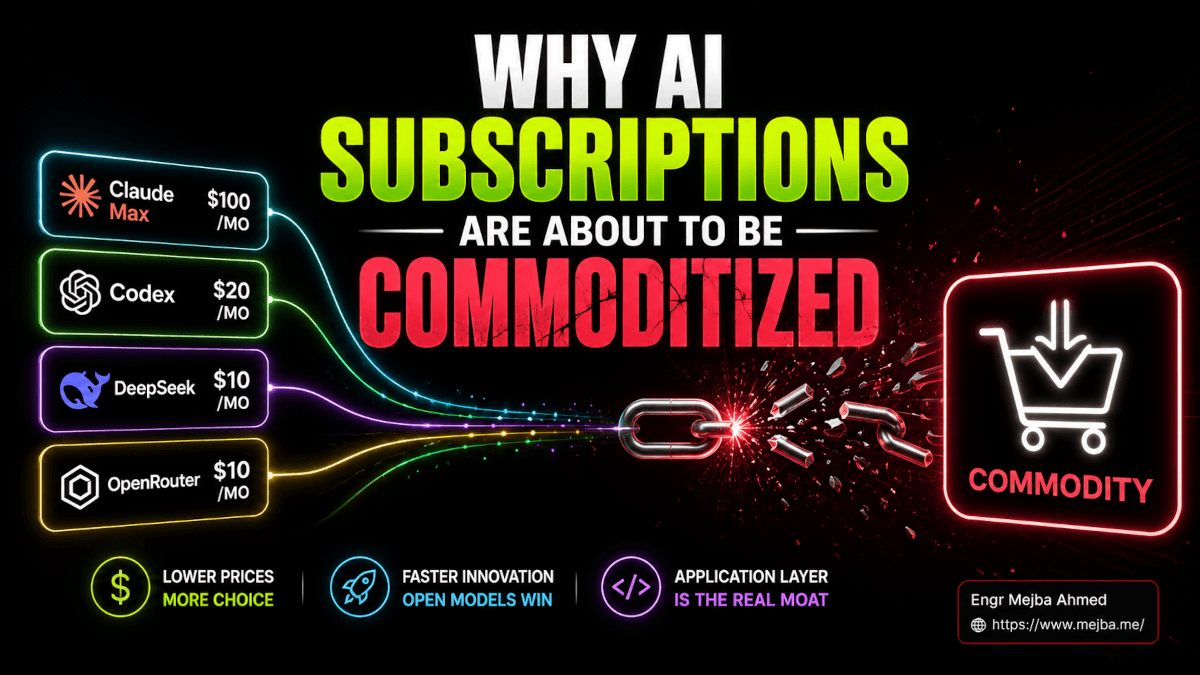

Kosten: Von $200/Monat auf buchstäblich null

Der offensichtlichste Punkt. Anthropics Claude Max-Abonnement kostet $200/Monat für Vielnutzer. Die Pro-Stufe liegt bei $20/Monat. API-Credits werden bei komplexen agentischen Workflows, die durch Context Windows brennen, schnell teuer.

Über OpenRouter kannst du auf Modelle zugreifen, die zwischen $15 pro Million Tokens und absolut nichts kosten. Ich habe komplette Programmiersitzungen durchgeführt — Refactors über mehrere Dateien, Testgenerierung, Dokumentation — auf Modellen, die mich weniger als einen Cent gekostet haben. Manche Sitzungen haben mich null gekostet.

Für Experimente, Lernen, Nebenprojekte und Prototyping? Dieser Kostenunterschied ist das Entscheidende.

Geschwindigkeit: Die versteckte Variable, vor der dich niemand warnt

Günstige und kostenlose Modelle sind oft langsamer. Manchmal dramatisch langsamer. Eine Antwort, die auf Opus 4.6 2 Sekunden dauert, kann auf einem kostenlosen Modell während der Stoßzeiten 8-12 Sekunden dauern. Wenn du einen agentischen Workflow mit Dutzenden von Hin-und-Her-Austauschen laufen lässt, summieren sich diese zusätzlichen Sekunden zu Minuten.

Ich habe es gemessen. Eine Refactoring-Aufgabe, die auf Opus 4.6 (Sonic) 4 Minuten dauerte, brauchte auf DeepSeek V3s kostenloser Stufe an einem geschäftigen Nachmittag fast 14 Minuten. Dieselbe Aufgabe, derselbe Prompt, dieselbe Ergebnisqualität — nur schmerzhaft langsamer.

Außerhalb der Stoßzeiten? Der Abstand schrumpft. Spätabends und frühmorgens laufen kostenlose Modelle deutlich schneller, weil weniger Nutzer die Server belasten.

Leistung: Wo die 85%-Regel greift

Nicht alle Modelle denken gleich gut. Premium-Claude-Modelle — insbesondere Opus 4.6 — bewältigen komplexe mehrstufige Programmieraufgaben mit einer Genauigkeit, die günstigere Modelle ehrlich gesagt nicht erreichen können. Randfälle, subtile Bugs, Architekturentscheidungen, die das Verständnis des gesamten Kontexts einer Codebasis erfordern — hier verdienen die teuren Modelle ihren Preis.

Aber hier ist, was ich nach einer Woche Testen entdeckt habe: Bei etwa 70-80% der gängigen Entwicklungsaufgaben — Boilerplate schreiben, Tests generieren, Dokumentation erstellen, einfache Refactors, Dateimanipulation — leisten Mittelklasse-Modelle nahezu identisch wie Premium-Modelle. Der Unterschied zeigt sich erst bei den schwierigen Aufgaben.

Ich betrachte es als die 85%-Regel. Ein Modell wie Gemini Flash liefert dir ungefähr 85% von Opus 4.6s Programmierleistung bei etwa 10% der Kosten. Für viele Workflows macht diese Rechnung die Entscheidung offensichtlich.

Sicherheit: Der Elefant im Terminal

Dieser Punkt ist wichtig und wird oft übersehen. Wenn du Claude Code über OpenRouter routest, passieren dein Code und deine Prompts die Infrastruktur von OpenRouter, bevor sie den Modellanbieter erreichen. Das ist ein zusätzlicher Zwischenschritt. Ein zusätzliches Unternehmen, das deine Daten sieht.

Für persönliche Projekte, Open-Source-Arbeit und nicht-sensiblen Code? Vermutlich in Ordnung. OpenRouter hat angemessene Datenschutzrichtlinien und trainiert standardmäßig nicht auf deinen Daten.

Für Kundenprojekte, proprietären Code, Enterprise-Arbeit oder alles, das mit Zugangsdaten und Geheimnissen zu tun hat? Bleib auf Anthropics direkter Infrastruktur mit deinem bezahlten Abonnement. Ohne Frage. Der Sicherheitskompromiss ist es nicht wert, ein paar Euro zu sparen, wenn du mit dem geistigen Eigentum anderer arbeitest.

Ich halte diese Grenze strikt ein. Kundenarbeit läuft über das Max-Abonnement direkt bei Anthropic. Persönliche Projekte und Experimente laufen über OpenRouter. Keine Ausnahmen, keine Grauzonen.

Jetzt, da du verstehst, wofür du optimierst — hier ist der Teil, in dem wir es tatsächlich einrichten.

OpenRouter: Das AI-Model-Gateway, das alles verändert

OpenRouter ist, in den einfachsten Worten, ein universeller Adapter für KI-Modelle. Ein API-Key, ein Endpoint, Hunderte von Modellen von Dutzenden von Anbietern. Du machst einen einzigen API-Aufruf, gibst an, welches Modell du willst, und OpenRouter leitet deine Anfrage an den richtigen Anbieter weiter, handhabt die Authentifizierung und sendet die Antwort in einem standardisierten Format zurück.

Stell es dir wie Stripe für KI-Modelle vor. Du integrierst nicht mit jedem Zahlungsdienstleister einzeln — du gehst über Stripe und es übernimmt das Routing. OpenRouter macht dasselbe für Sprachmodelle. Googles Gemini, DeepSeek, Metas Llama-Varianten, Mistral, Anthropics eigene Modelle und Hunderte mehr — alle über eine einzige API zugänglich.

Warum ist das für Claude Code speziell wichtig? Weil Claude Codes agentisches Framework mit dem KI-Modell über eine Standard-API-Schnittstelle kommuniziert. Wenn du ihm einen Endpoint geben kannst, der dasselbe Protokoll spricht, ist es ihm egal, wer antwortet. Es sendet Prompts. Es empfängt Completions. Es führt Tools aus. Das Framework ist modell-agnostisch by Design — auch wenn Anthropic natürlich bevorzugt, dass du ihre Modelle verwendest.

Hier sind die fünf Modelle, die ich am ausführlichsten über OpenRouter mit Claude Code getestet habe, geordnet nach meiner Erfahrung bei realer Entwicklungsarbeit.

Opus 4.6 Sonic — Die Premium-Benchmark ($15/M Tokens)

Das ist Anthropics eigenes Flaggschiff, über OpenRouter statt über ein direktes Abonnement zugegriffen. Leistung? Eine perfekte 10 von 10 in meinen Tests. Es ist das schnellste verfügbare Premium-Modell, das zuverlässigste für komplexe agentische Ketten und behandelt Randfälle mit einer Präzision, die mich nach Monaten täglicher Nutzung immer noch beeindruckt.

Warum würdest du es über OpenRouter statt über ein direktes Abonnement nutzen? Flexibilität. Bei OpenRouter zahlst du pro Token — keine monatliche Verpflichtung. Wenn du eine Woche hast, in der du kaum programmierst, zahlst du kaum. Wenn du eine Sprint-Woche hast, in der du durch Tokens brennst, zahlst du mehr. Für Entwickler mit unregelmäßigen Nutzungsmustern kann das tatsächlich günstiger sein als das $200/Monat Max-Abonnement.

Der Haken: Bei $15 pro Million Tokens wird intensive Nutzung schnell teuer. Eine komplexe agentische Sitzung kann leicht 100K-500K Tokens verbrennen, sodass ein arbeitsreicher Tag $1,50-$7,50 kosten kann. Die Rechnung geht nur zu deinen Gunsten auf, wenn du signifikante Pausen zwischen Sprints hast.

Gemini Flash — Der Sweet Spot ($1,50/M Tokens)

Das ist mein tägliches Arbeitspferd für nicht-kritische Arbeit, und ehrlich gesagt hat es mich überrascht. Googles Gemini Flash über OpenRouter kostet ungefähr ein Zehntel dessen, was Opus pro Token berechnet. Leistungsmäßig würde ich es mit 8,5 von 10 für Programmieraufgaben bewerten.

Wo es glänzt: Boilerplate-Generierung, Tests schreiben, Dokumentation, unkomplizierte Refactors, Dateien erstellen und jede Aufgabe, bei der die Anweisungen klar sind und die Argumentationskette nicht zu tief geht. Bei diesen alltäglichen Entwicklungsaufgaben kann ich ehrlich gesagt keinen Unterschied zwischen Gemini Flash-Output und Opus-Output erkennen. Der Code ist sauber. Die Bearbeitungen sind präzise. Der Agenten-Workflow läuft reibungslos.

Wo es stolpert: Komplexe Multi-Datei-Refactors, die das Verständnis subtiler architektonischer Abhängigkeiten erfordern. Aufgaben, bei denen das Modell einen großen Kontext halten und über Interaktionen zwischen entfernten Teilen einer Codebasis nachdenken muss. Randfälle bei der Testgenerierung, bei denen die Fehlermodi nicht offensichtlich sind.

Mein Workflow: Gemini Flash verarbeitet mittlerweile wahrscheinlich 60% meiner täglichen Claude Code-Nutzung. Die restlichen 40% — alles Komplexe, alles für Kunden, alles, wo ein Fehler mich mehr kostet als die Token-Ersparnis — geht an Opus.

Dro Small — Budgetoption mit kostenlosen Stufen

Dro Small fällt in die Budgetkategorie mit kostenlosen Optionen außerhalb der Stoßzeiten. Die Leistung ist spürbar niedriger — etwa 6,5-7 von 10 für Programmieraufgaben. Klare Spezifikationen und einfache Funktionen? In Ordnung. Subtiles Debugging oder komplexe Refactors? Du verbringst mehr Zeit mit der Korrektur des Outputs als du an Tokens gespart hast.

Die Geschwindigkeit schwankt auf der kostenlosen Stufe enorm — 3 Sekunden bei manchen Anfragen, 20+ Sekunden bei anderen. Geteilte Kapazität bedeutet unvorhersehbare Antwortzeiten.

Ich verwende es für genau einen Zweck: massenhafte repetitive Aufgaben mit vorlagenbasierten Prompts und stark strukturiertem Output. Boilerplate über mehrere Dateien generieren, standardisierte Docstrings, Test-Stubs. Dafür ist es überraschend ausreichend und effektiv kostenlos.

DeepSeek V3 — Kostenlos, schnell und frustrierend

DeepSeek V3 ist das interessanteste Modell auf dieser Liste, weil es gleichzeitig beeindruckend und ärgerlich ist.

Das Modell selbst ist wirklich leistungsfähig. Für reine Programmierleistung würde ich es mit 7,5-8 von 10 bewerten — überraschend nah an Gemini Flash bei vielen Aufgaben, und es ist kostenlos. Der generierte Code ist sauber, die Argumentation ist solide, und bei unkomplizierter Entwicklungsarbeit wäre es schwer, es von Modellen zu unterscheiden, die zehnmal so viel kosten.

Das Problem ist die Zuverlässigkeit. DeepSeek V3s kostenlose Stufe auf OpenRouter ist anfällig für Rate Limiting — besonders während der asiatischen und europäischen Geschäftszeiten, wenn die Nutzung ansteigt. Ich hatte Sitzungen, in denen der Agent drei Tool-Aufrufe erfolgreich durchführte und dann beim vierten ein Rate Limit erreichte, sodass ich mit einer halb fertigen Dateibearbeitung und einem kaputten Workflow dastand.

Es gibt wenig, das so frustrierend ist wie eine agentische Programmiersitzung, die mitten im Refactor stoppt, weil der Modellanbieter deine Anfragen gedrosselt hat. Du kannst nicht einfach von einem halb fertigen Zustand aus weitermachen. Du wartest und versuchst es erneut, oder du wechselst zu einem anderen Modell und hoffst, dass es den Kontext korrekt aufgreift.

Mein Urteil über DeepSeek V3: Brillant zum Lernen, Experimentieren und für Sitzungen, bei denen du Geduld und Zeit hast. Nichts, worauf ich mich bei Arbeit mit Deadline verlassen würde. Das Rate Limiting allein disqualifiziert es für ernsthafte Nutzung.

Die übrigen Hunderte

OpenRouter gibt dir Zugang zu Hunderten weiteren — Metas Llama-Varianten, Mistral, Coheres Command-Serie, Community Fine-Tunes. Das Ökosystem ist riesig und wächst wöchentlich.

Faire Warnung: Nicht jedes Modell spielt reibungslos mit Claude Codes agentischem Framework zusammen. Modelle, die bei Chat-Benchmarks glänzen, versagen manchmal bei Tool-Calling-Protokollen — sie liefern fehlerhaftes JSON, ignorieren Funktionssignaturen oder halluzinieren Tool-Namen. Das ist mir mehr als einmal passiert. Wenn du über meine getestete Liste hinaus experimentierst, beginne mit einer einfachen Aufgabe, die eine überprüfbare Antwort hat, und bestätige, dass das Modell Tool-Aufrufe zuverlässig verarbeitet, bevor du ihm etwas Komplexes anvertraust.

Jetzt richten wir das ein.

Schritt für Schritt: OpenRouter mit Claude Code einrichten

Der gesamte Prozess dauert etwa zehn Minuten. Ich führe dich genau so durch, wie ich es selbst gemacht habe, einschließlich der kleinen Stolperfallen, die mich beim ersten Mal erwischt haben.

Schritt 1: Erstelle dein OpenRouter-Konto und deinen API-Key

Gehe zu openrouter.ai und erstelle ein Konto. Die Anmeldung ist unkompliziert — E-Mail, Passwort, fertig. Keine Kreditkarte erforderlich, um zu starten.

Sobald du drin bist, navigiere zu Keys in deinem Dashboard. Klicke auf Create Key. Gib ihm einen beschreibenden Namen — ich benenne meine nach Anwendungszweck, wie "claude-code-personal" und "claude-code-experiments" — damit ich die Nutzung später separat nachverfolgen kann.

Kopiere den API-Key sofort. OpenRouter zeigt ihn nur einmal an. Wenn du ihn verlierst, musst du einen neuen generieren.

Pro-Tipp: Lade dein Konto sofort mit etwa $10 auf, selbst wenn du vorhast, kostenlose Modelle zu verwenden. Hier ist der Grund — OpenRouter behandelt Konten ohne Guthaben anders. Kostenlose Modelle haben strengere Rate Limits für Konten ohne Guthaben. Schon ein kleines Guthaben signalisiert OpenRouter, dass du ein echter Nutzer bist, und du wirst spürbar weniger Drosselung erleben. Ich lernte das nach drei frustrierenden Sitzungen, in denen DeepSeek V3 ständig abbrach, und das Hinzufügen von $5 Guthaben machte alles wie durch Zauberhand geschmeidiger. Du gibst diese $5 nicht für kostenlose Modelle aus — sie bleiben einfach als Vertrauenssignal stehen.

Schritt 2: Konfiguriere die Anti-Gravity Desktop-App

Wenn du Claude Code über die Anti-Gravity Desktop-App ausführst — was bei mir für die meiste Arbeit der Fall ist — befindet sich die Konfiguration im Einstellungspanel der App.

Öffne Anti-Gravity. Navigiere zu Settings > Model Provider (der genaue Pfad kann je nach Version leicht variieren). Du siehst Felder für:

- API Endpoint / Base URL: Setze dies auf

https://openrouter.ai/api/v1 - API Key: Füge hier deinen OpenRouter API-Key ein

- Model identifier: Das ist der String, der OpenRouter mitteilt, welches Modell es verwenden soll

Der Model-Identifier folgt einem bestimmten Format. Zum Beispiel:

- Opus 4.6 Sonic:

anthropic/claude-opus-4.6:sonic - Gemini Flash:

google/gemini-flash-1.5 - DeepSeek V3:

deepseek/deepseek-chat

Du findest den genauen Model-Identifier für jedes Modell auf OpenRouters Model-Directory-Seite. Jedes Modell hat eine "copy ID"-Schaltfläche, die dir den benötigten String liefert.

Schritt 3: Zwischen Modellen wechseln

Hier wird der Workflow praktisch. Du musst nicht jedes Mal alles neu konfigurieren, wenn du das Modell wechseln willst. Der Prozess ist:

- Kopiere den Model-Identifier-String für das gewünschte Modell

- Füge ihn in das Modellkonfigurationsfeld in Anti-Gravity ein

- Starte deine Terminal-Sitzung neu (oder öffne ein neues Terminal-Panel)

Dieser Neustart ist wichtig. Claude Code lädt die Modellkonfiguration beim Sitzungsstart. Eine Änderung der Konfiguration während einer laufenden Sitzung wird erst wirksam, wenn du eine neue Sitzung startest. Ich bewahre eine Textdatei auf meinem Desktop mit all meinen häufig genutzten Model-Identifiern auf — eine pro Zeile — sodass der Wechsel buchstäblich eine Kopieren-Einfügen-Neustart-Operation ist.

# My OpenRouter Model Quick-Switch List

# Premium (client work)

anthropic/claude-opus-4.6:sonic

# Daily driver (personal projects)

google/gemini-flash-1.5

# Free experimentation

deepseek/deepseek-chat

# Budget bulk tasks

dro/dro-small-free

Schritt 4: Überprüfe deine Modellverbindung

Nach dem Neustart mit einem neuen Modell überprüfe die Verbindung, bevor du mit echter Arbeit beginnst. Frage Claude Code "What model are you running on?" — die meisten Modelle berichten ihre Identität korrekt. Wenn du eine kohärente Antwort bekommst, ist die Verbindung aktiv.

Für einen gründlicheren Test bitte es, eine einfache agentische Aktion auszuführen: "Read the current directory and list all files." Das testet die gesamte Tool-Calling-Pipeline, nicht nur die Textgenerierung. Wenn es eine Dateisystemoperation erfolgreich ausführt, funktioniert das agentische Framework mit deinem neuen Modell.

Ich mache das jedes Mal, wenn ich wechsle. Fünf Sekunden Überprüfung haben mich vor Dutzenden frustrierender Debugging-Sitzungen bewahrt, bei denen das eigentliche Problem ein falsch konfigurierter Model-String war.

Wenn du möchtest, dass jemand ein maßgeschneidertes KI-Agenten-Setup wie dieses für dich baut — zugeschnitten auf deinen Workflow mit der richtigen Modellmischung von Anfang an konfiguriert — übernehme ich genau solche Projekte. Schau dir an, was ich gebaut habe auf fiverr.com/s/EgxYmWD.

Schritt 5: Mehrere Modelle gleichzeitig verwalten

Das ist ein Workflow-Trick, der meine Produktivität erheblich gesteigert hat. Du musst dich nicht für ein Modell pro Sitzung entscheiden. Du kannst mehrere Terminal-Panels betreiben, jedes mit einem anderen Modell konfiguriert.

Mein typisches Setup:

- Terminal-Panel 1: Opus 4.6 Sonic — für die komplexe Architekturaufgabe, auf die ich mich gerade konzentriere

- Terminal-Panel 2: Gemini Flash — für schnelle Hilfsaufgaben, Dokumentation und Testgenerierung, die parallel laufen

- Terminal-Panel 3: DeepSeek V3 oder ein kostenloses Modell — für experimentelle Branches, bei denen ich spekulative Ansätze ausprobiere, die ich möglicherweise verwerfe

Drei Panels, drei Modelle, drei verschiedene Kostenprofile, alle gleichzeitig in derselben IDE laufend. Die komplexe Denkarbeit passiert auf dem Premium-Modell. Die Routinearbeit läuft auf dem günstigen Modell. Das Experimentelle läuft kostenlos.

Wenn du so darüber nachdenkst, wählst du nicht zwischen kostenlosen und bezahlten Modellen. Du baust ein Team von KI-Assistenten auf verschiedenen Preisstufen auf, jeder der Arbeit zugewiesen, die seinem Fähigkeitsniveau entspricht. Das ist keine Kostensenkung — das ist Ressourcenallokation.

Skills funktionieren unabhängig davon, welchen Motor du laufen lässt

Etwas, das ich früh in meinen Tests bestätigen musste — und das ist eine Frage, die ich von mehreren Leuten bekommen habe — ist, ob Claude Codes Skill-System noch funktioniert, wenn du das Modell wechselst.

Kurze Antwort: Ja. Vollständig.

Skills in Claude Code sind modell-agnostisch by Design. Ein Skill ist im Wesentlichen eine definierte Fähigkeit — ein Satz von Anweisungen, API-Integrationen und Tool-Use-Mustern, denen der Agent folgt. Dem Skill selbst ist es egal, welches Modell die Argumentation antreibt. Es ist Infrastruktur, nicht Intelligenz.

Zum Beispiel habe ich einen Bitly URL-Verkürzungs-Skill in meinem Claude Code-Setup konfiguriert. Wenn ich sage "shorten this URL," handhabt der Skill den Bitly-API-Aufruf, verarbeitet die Antwort und gibt den verkürzten Link zurück. Ob das zugrunde liegende Modell Opus 4.6, Gemini Flash oder DeepSeek V3 ist — der Skill führt identisch aus. Das Modell liefert die Argumentation, um meine Anfrage zu verstehen und den Skill aufzurufen. Der Skill erledigt die eigentliche Arbeit.

Ich habe das mit allen fünf Modellen getestet, die ich zuvor erwähnt habe. Jedes einzelne triggerte Skills korrekt, übergab Parameter präzise und verarbeitete Skill-Antworten ohne Probleme. Die Modellqualität beeinflusst, wie gut das Modell nuancierte Skill-Aufrufe versteht — ein kostenloses Modell benötigt möglicherweise explizitere Anweisungen als Opus — aber die Skill-Infrastruktur selbst ist felsenfest, unabhängig vom Modell.

Das ist wichtig, weil es bedeutet, dass deine Investition in die Konfiguration von Skills, das Einrichten von Integrationen und das Erstellen benutzerdefinierter Workflows perfekt übertragbar ist, wenn du das Modell wechselst. Nichts geht kaputt. Nichts muss neu konfiguriert werden. Du tauschst den Motor, das Auto fährt weiter, und alle individuellen Modifikationen, die du am Chassis vorgenommen hast, bleiben genau dort, wo sie sind.

Wenn du dein Claude Code-Setup rund um Skills aufgebaut hast (und falls nicht, schau dir meinen agent skills guide für die vollständige Anleitung an), dann ist diese Portabilität ein bedeutender Vorteil des OpenRouter-Ansatzes. Deine Investition in Skills zahlt sich aus, unabhängig davon, welches Modell du diese Woche laufen lässt.

Die Falle der falschen Ersparnis — Wenn kostenlose Modelle dich mehr kosten

Hier kommt der ehrliche Teil. Der Teil, den die meisten „Nutze KI kostenlos!"-Artikel geflissentlich überspringen.

Ich habe einen Nachmittag damit verbracht, eine mäßig komplexe Next.js-Komponente mit DeepSeek V3 auf der kostenlosen Stufe zu bauen. Die Komponente umfasste dynamische Formulargenerierung mit Validierung, konditionaler Feldsichtbarkeit und Echtzeit-Vorschau. Nicht trivial, aber auch keine Raketenwissenschaft — etwas, das Opus in einem Anlauf erledigen würde.

DeepSeek V3 brauchte vier Anläufe. Der erste Output hatte einen subtilen State-Management-Bug. Der zweite behob diesen Bug, führte aber ein Rendering-Problem ein. Der dritte funktionierte, produzierte aber Code, der... nennen wir es „kreativ" auf eine Weise, die kein Code Review überleben würde. Der vierte Anlauf lieferte endlich etwas Auslieferbares, aber erst nachdem ich manuell zwei Randfälle korrigiert hatte, die das Modell übersehen hatte.

Gesamtzeit mit DeepSeek V3: etwa 45 Minuten. Gesamtkosten: $0.

Als ich am nächsten Tag dieselbe Aufgabe auf Opus 4.6 zum Vergleich laufen ließ: ein Anlauf, sauberer Code, 6 Minuten. Kosten: ungefähr $0,30 an Tokens.

Hier ist die Rechnung, die zählt. Wenn meine Zeit etwas wert ist — und deine auch — dann ist 45 Minuten aufzuwenden, um $0,30 zu sparen, ein miserabler Deal. Das ist ein effektiver Stundensatz von $0,40. Selbst wenn du deine Zeit zum Mindestlohn bewertest, hast du beim „kostenlosen" Modell Geld verloren.

Das nenne ich die Falle der falschen Ersparnis. Das Modell ist kostenlos. Deine Zeit ist es nicht. Wenn du 30 zusätzliche Minuten damit verbringst, die Fehler eines günstigen Modells zu korrigieren, hast du kein Geld gespart. Du hast mit der teuersten Ressource bezahlt, die du hast.

Wann ist kostenlos also wirklich kostenlos? Wenn die Aufgabe einfach genug ist, dass das günstige Modell sie beim ersten Versuch richtig macht. Wenn du experimentierst und die Ausgabequalität keine Rolle spielt. Wenn du lernst und der Debugging-Prozess selbst lehrreich ist. Wenn du Massenaufgaben laufen lässt, bei denen du den Prompt so eng gestalten kannst, dass selbst ein mittelmäßiges Modell es nicht vermasseln kann.

Für alles andere? Bezahle für das gute Modell. Die Zeitersparnis allein rechtfertigt die Kosten.

Wann bezahlen und wann spielen: Mein Entscheidungsframework

Nach ein paar Wochen mit diesem hybriden Setup habe ich ein einfaches Framework entwickelt, um zu entscheiden, welches Modell welche Aufgabe bekommt. Es ist nicht kompliziert, aber es bewahrt mich davor, die falsche Wahl zu treffen.

Verwende immer Premium-Claude (Max-Abonnement oder Opus über OpenRouter):

- Kundenarbeit. Punkt. Keine Ausnahmen.

- Jeglicher Code, der Produktionssysteme berührt

- Komplexe Architekturentscheidungen oder Refactors über mehrere Dateien

- Sicherheitskritischer Code (Authentifizierung, Autorisierung, Verschlüsselung)

- Debugging subtiler Bugs, bei denen der Fehlermodus nicht offensichtlich ist

- Jede Aufgabe, bei der ein Fehler mehr kostet zu beheben als die Tokens kosten, um ihn zu verhindern

Verwende Mittelklasse-Modelle (Gemini Flash):

- Persönliche Projekte, bei denen Qualität zählt, aber Dringlichkeit nicht

- Testgenerierung für gut definierte Funktionen

- Dokumentation und READMEs erstellen

- Boilerplate-Scaffolding (neue Komponenten, Standard-CRUD-Endpoints)

- Code-Formatierung und Stil-Refactoring

- Alles mit klarer Spezifikation und überprüfbarem Output

Verwende kostenlose Modelle (DeepSeek V3, Dro Small):

- Reines Experimentieren und Lernen

- Wegwerf-Prototypen, die du sowieso neu schreiben willst

- Massenhafte repetitive Operationen mit vorlagenbasierten Prompts

- Leerlauf füllen, wenn dein bezahltes Abonnement ein Rate Limit erreicht hat

- Testen, ob Claude Codes agentisches Framework einen bestimmten Workflow bewältigt, bevor du Premium-Tokens dafür einsetzt

Hier ist der Perspektivwechsel, der dieses Framework für mich zum Klicken brachte: Behandle dein KI-Abonnement wie einen kleinen digitalen Mitarbeiter.

Ein Senior Developer kostet $8.000-$15.000 pro Monat. Ein Junior Developer kostet $3.000-$6.000. Dein Claude Max-Abonnement mit $200/Monat ist, selbst auf dem teuersten Level, weniger als 3% dessen, was ein Junior Developer kostet. Und es arbeitet um 2 Uhr nachts ohne sich zu beschweren.

Wenn du es so betrachtest, ist die Frage nicht „Wie vermeide ich es, für KI zu bezahlen?" Die Frage ist „Wie verteile ich mein KI-Budget auf verschiedene Fähigkeitsstufen, genauso wie ein Unternehmen Arbeit auf Senior und Junior Developer verteilt?"

Du weist keinem Senior Developer zu, Boilerplate zu schreiben. Du weist keinem Junior Developer zu, dein verteiltes System zu architekturieren. Dieselbe Logik gilt für KI-Modelle. Stimme die Modellstufe auf die Aufgabenkomplexität ab, und du gibst weniger aus, während du mehr erledigt bekommst.

Die wahre Stärke: Flexibilität als Workflow-Strategie

Die größte Erkenntnis aus diesem gesamten Experiment ist kein individueller Modellvergleich. Es ist die Flexibilität selbst.

Vor OpenRouter war ich an einen einzigen Anbieter gebunden. Anthropic-Ausfall? Mein Workflow stoppte. Abonnementlimit erreicht? Feierabend für den Tag. Neugierig, wie ein anderes Modell eine bestimmte Aufgabe bewältigt? Komplett separate Toolchain erforderlich.

Jetzt? Anthropic geht down, ich wechsle in dreißig Sekunden zu Gemini Flash. Rate Limit bei einem Modell, ich schwenke auf ein anderes um. Neugierig, ob DeepSeek ein bestimmtes Programmiermuster besser handhabt als Claude? Vergleich nebeneinander in parallelen Terminal-Panels, keine Workflow-Änderungen nötig.

Diese Flexibilität kumuliert sich. Ich habe Aufgaben entdeckt, bei denen Gemini Flash tatsächlich besser abschneidet als Claude — besonders bei Datentransformationsarbeit, wo Flashs Mustererkennung einen überraschenden Vorteil hat. Das hätte ich ohne die einfache Wechsel-und-Vergleichs-Möglichkeit nicht entdeckt.

Auch der Resilienz-Aspekt zählt. Ein einziger KI-Anbieter gleicht einem Single Point of Failure. OpenRouter als Fallback bedeutet, dass dein agentischer Workflow den schlechten Tag jedes einzelnen Anbieters übersteht.

Wie meine typische Woche jetzt aussieht

Mein $200 Max-Abonnement deckt Kundenarbeit von Montag bis Mittwoch — Opus 4.6 Sonic, direkte Anthropic-Infrastruktur, keine Kompromisse bei der Sicherheit. Donnerstag und Freitag wechsle ich zu OpenRouter: Gemini Flash für persönliche Projekte und Dokumentation, gelegentlich DeepSeek V3, wenn mich interessiert, wie es bestimmte Muster verarbeitet. Wochenenden sind reines Experimentieren mit kostenlosen Modellen.

Monatliche Gesamtkosten: das Max-Abonnement plus ungefähr $15-$25 an OpenRouter-Credits für alles andere. Vor diesem Workflow bezahlte ich entweder $200 und stieß an Limits, oder verbrannte API-Credits zu unvorhersehbaren Raten. Der hybride Ansatz ist sowohl günstiger als auch produktiver.

Wenn du verstehen willst, wie Claude Codes Skill-System unabhängig davon funktioniert, welches Modell es antreibt, erklärt mein agent skills guide die gesamte Architektur. Und wenn du neu bei der Anti-Gravity IDE bist, in der der Großteil dieser Konfiguration stattfindet, habe ich das komplette Setup in meinem Anti-Gravity IDE deep dive behandelt.

Die Frage, die du eigentlich stellen solltest

Die meisten Leute nähern sich diesem Thema mit der Frage „Wie nutze ich Claude Code kostenlos?" Das ist die falsche Frage. Kostenlos ist ein Werkzeug, kein Ziel.

Die richtige Frage ist: „Wie bekomme ich den maximalen Output aus meinem KI-unterstützten Entwicklungsworkflow, während ich nur das ausgebe, was jede Aufgabe wert ist?"

Manche Aufgaben sind $15 pro Million Tokens wert. Manche Aufgaben sind $1,50 wert. Manche sind null wert. Die Entwickler, die in den nächsten Jahren am produktivsten sein werden, sind nicht diejenigen, die das günstigste Modell gefunden haben — es sind diejenigen, die gelernt haben, das richtige Modell der richtigen Aufgabe zuzuordnen, nahtlos, ohne Reibung.

OpenRouter und Claude Code zusammen geben dir diese Zuordnungsfähigkeit. Du bekommst Anthropics erstklassiges agentisches Framework — die Dateibearbeitung, die Terminalausführung, das Skill-System, die mehrstufige Argumentation — mit der Freiheit, die Intelligenzschicht darunter basierend auf dem zu wechseln, was du gerade baust.

Das hat nichts mit Geiz zu tun. Das ist strategisches Denken. Und Strategie, nach meiner Erfahrung, schlägt rohe Gewalt jedes einzelne Mal.

Also hier ist dein Schritt für heute Abend: Geh und erstelle das OpenRouter-Konto, lade es mit $10 auf, konfiguriere ein kostenloses Modell neben deinem bestehenden Claude-Setup und führe dieselbe Aufgabe auf beiden aus. Sieh den Unterschied selbst. Sobald du gespürt hast, wie es ist, mehrere KI-Engines auf Abruf verfügbar zu haben — jede der Arbeit zugeordnet, die am besten zu ihr passt — gehst du nicht mehr zurück zu einem Ein-Modell-Setup.

Der Formel-1-Wagen war immer in der Lage, mit verschiedenen Motoren zu fahren. Jetzt weißt du, wie man sie tauscht.

Häufig gestellte Fragen

Funktioniert Claude Code mit jedem Modell auf OpenRouter?

Claude Codes agentisches Framework funktioniert mit den meisten Modellen auf OpenRouter, aber die Qualität variiert erheblich. Modelle müssen Tool-Calling und strukturierten Output zuverlässig unterstützen. Halte dich an bekannte Modelle wie Gemini Flash, DeepSeek V3 oder Anthropics eigene Reihe für konsistente Ergebnisse. Siehe den Schritt-für-Schritt-Abschnitt oben für vollständige Einrichtungsdetails.

Ist es sicher, kostenlose KI-Modelle zum Programmieren zu verwenden?

Kostenlose Modelle sind sicher für persönliche Projekte und Experimente. Dein Code passiert die Server von OpenRouter und die Infrastruktur des Modellanbieters, also vermeide es, proprietären Kundencode, Zugangsdaten oder sensible Geschäftslogik über kostenlose Stufen zu senden. Halte Kundenarbeit auf Anthropics direkter Infrastruktur mit einem bezahlten Abonnement.

Warum stoppt mein kostenloses Modell ständig mitten in der Aufgabe?

Rate Limiting ist die häufigste Ursache. Kostenlose Modelle auf OpenRouter drosseln Anfragen während Spitzennutzungszeiten. Das Hinzufügen von $5-$10 an OpenRouter-Credits reduziert die Drosselung selbst bei kostenlosen Modellen, weil Konten mit Guthaben Vorrang erhalten. Nebenzeiten (spätabends, frühmorgens in deiner Zeitzone) haben ebenfalls weniger Einschränkungen.

Kann ich Claude Code-Skills mit Nicht-Anthropic-Modellen verwenden?

Ja — Skills sind vollständig modell-agnostisch. Skills definieren Tool-Integrationen und Workflows, die unabhängig davon laufen, welches KI-Modell die Argumentation liefert. Ich habe Bitly URL-Verkürzung, Dateioperationen und benutzerdefinierte API-Skills auf fünf verschiedenen Modellen getestet, ohne Neukonfiguration. Siehe den Abschnitt über Skills oben für Details.

Was ist das beste kostenlose Modell für Claude Code im Moment?

Stand März 2026 bietet DeepSeek V3 die stärkste kostenlose Programmierleistung auf OpenRouter — ungefähr 7,5-8 von 10 in meinen Tests. Der Kompromiss ist häufiges Rate Limiting während der Geschäftszeiten. Für eine kostengünstige Alternative mit besserer Zuverlässigkeit ist Gemini Flash bei $1,50 pro Million Tokens das stärkste Preis-Leistungs-Verhältnis im aktuellen Angebot.

Lass uns zusammenarbeiten

Du möchtest KI-Systeme bauen, Workflows automatisieren oder deine technische Infrastruktur skalieren? Ich helfe dir gerne.

- Fiverr (Custom Builds & Integrationen): fiverr.com/s/EgxYmWD

- Portfolio: mejba.me

- Ramlit Limited (Enterprise-Lösungen): ramlit.com

- ColorPark (Design & Branding): colorpark.io

- xCyberSecurity (Sicherheitsdienste): xcybersecurity.io