Notícias de IA Março 2026: A Semana em que Tudo Mudou

Tentei tirar um fim de semana de folga das notícias de IA. Dois dias. Era tudo o que eu queria. Voltei na segunda-feira de manhã com 47 notificações não lidas, três novos lançamentos de modelos, uma palestra da Nvidia que eu tinha perdido completamente, e um protótipo vazado do Google que tinha metade do Twitter discutindo se as ferramentas de design estavam prestes a se tornar obsoletas.

Isso foi uma semana. Sete dias em março de 2026. E quando terminei de processar tudo o que aconteceu, percebi algo: esse não foi um ciclo normal de notícias. Foi uma daquelas semanas raras em que o chão se move debaixo de toda a indústria — onde a direção muda e você consegue sentir.

O que tornou esta semana diferente não foi nenhum anúncio em particular. Foi o padrão. Modelos de código aberto que realmente competem com os proprietários. Janelas de contexto atingindo a marca de um milhão de tokens e performando bem nessa escala. Arquiteturas multi-agente saindo de demos de pesquisa para produtos em produção. Sistemas de IA locais que você pode rodar em um Mac Mini. Um novo mecanismo de atenção que pode mudar fundamentalmente como os modelos lidam com memória.

Vou guiá-lo pelos doze principais desenvolvimentos, mas mais importante, vou dizer quais realmente importam para pessoas que constroem coisas — e quais são demos impressionantes que não vão mudar seu fluxo de trabalho por meses. Porque depois de testar vários deles pessoalmente, a distância entre "anúncio empolgante" e "útil agora" é maior do que você imagina.

Exceto em dois casos. Onde não há distância alguma.

Por que Esta Semana Foi Diferente de um Ciclo Normal de Notícias

A maioria das semanas em IA segue um ritmo previsível. Uma empresa lança algo. O Twitter reage. Alguns benchmarks são citados. Todo mundo segue em frente. Os avanços são reais mas isolados — você pode avaliá-los um de cada vez, decidir se importam para você e se ajustar conforme necessário.

Esta semana quebrou esse padrão. Os anúncios não foram isolados. Eles estão interconectados de maneiras que amplificam a importância de cada um. A Nvidia lançar um modelo de raciocínio de código aberto importa mais porque a Mistral lançou simultaneamente um modelo de mistura de especialistas de código aberto com licença Apache 2.0. O Claude atingir 1M de tokens importa mais porque frameworks multi-agente estão se tornando a forma padrão de usar esses modelos — e agentes precisam de contexto massivo para se coordenar efetivamente.

Quando olhei para o quadro completo, três temas emergiram que acredito definirem para onde o desenvolvimento de IA está indo no restante de 2026:

Fluxos de trabalho multi-agente não são mais experimentais. Estão se tornando a forma esperada de interagir com IA para tarefas complexas. OpenAI, Anthropic e várias startups impulsionaram infraestrutura de agentes esta semana.

Modelos de código aberto cruzaram um limiar de capacidade. Três lançamentos separados de código aberto esta semana podem competir genuinamente com modelos proprietários em tarefas reais — não apenas em benchmarks.

A corrida pelo contexto está acelerando. 1M de tokens da Anthropic. 256K da Mistral. Uma nova arquitetura de atenção da Moonshot que pode tornar contextos ainda maiores computacionalmente viáveis. Os modelos estão aprendendo a lembrar.

Esse terceiro tema é o que acredito que as pessoas estão subestimando. Vou explicar por que quando chegarmos à arquitetura Attention Residual da Moonshot — é a coisa tecnicamente mais interessante que aconteceu esta semana, e quase ninguém está falando sobre isso.

Mas primeiro, o anúncio que mais impactou meu fluxo de trabalho diário.

Sub Agents da OpenAI para Codex: Cérebros Paralelos para seu CLI

Tenho usado o CLI do Codex da OpenAI desde seu lançamento — escrevi sobre minhas primeiras impressões do app Codex quando ele saiu, e o mantive na minha rotação junto com o Claude Code para tarefas onde o estilo de raciocínio do GPT se encaixa melhor.

O novo recurso Sub Agents muda o modelo fundamental de interação. Em vez de um agente trabalhando na sua tarefa sequencialmente, o Codex agora pode criar sub-agentes especializados que trabalham em paralelo em diferentes aspectos do mesmo problema.

Veja como isso funciona na prática. Digamos que você peça ao Codex para refatorar um módulo, atualizar seus testes e modificar a documentação do API. Antes, ele faria isso sequencialmente — refatorar, depois testes, depois documentação. Com sub-agentes, ele gera três workers paralelos: um focado na refatoração, um escrevendo testes contra a nova interface esperada, e um atualizando a documentação. Eles se coordenam por meio de um contexto compartilhado, mas executam simultaneamente.

A melhoria de velocidade é óbvia. Mas a melhoria de qualidade me surpreendeu mais. Cada sub-agente opera com um foco mais restrito, o que significa menos poluição de contexto. O agente de testes não se distrai com questões de documentação. O agente de documentação não tenta também raciocinar sobre casos extremos de testes. A especialização funciona para IA da mesma forma que funciona para equipes humanas.

Se você leu meu artigo sobre equipes de agentes do Claude Code, vai reconhecer esse padrão. A coordenação multi-agente está convergindo na mesma arquitetura tanto na OpenAI quanto na Anthropic: workers especializados, execução paralela, contexto compartilhado. As implementações diferem, mas a filosofia é idêntica.

O porém? Sub-agentes consomem tokens rápido. Três agentes paralelos significam aproximadamente 3x o uso de tokens para a mesma tarefa. Para trabalhos complexos de refatoração, você pode esgotar sua cota do Codex rapidamente. Vale saber disso antes de ativar para tudo.

Minimax M2.7: O Modelo de Código Aberto que Construiu um App para Mac

Esse me pegou desprevenido. Minimax — uma empresa que admito não estar acompanhando de perto — lançou o M2.7, um modelo de código aberto com capacidades de agente que são genuinamente impressionantes para sua categoria.

A demo que chamou atenção foi o modelo criando uma aplicação funcional para macOS a partir de uma descrição em linguagem natural. Não um mockup. Não um wireframe. Um app para Mac funcional com elementos reais de UI, tratamento de eventos e convenções adequadas de design macOS.

Testei com uma tarefa semelhante — pedindo para criar um utilitário de barra de menu para monitorar contêineres Docker. O resultado não estava pronto para produção, mas estava significativamente mais avançado do que eu esperaria de um modelo de código aberto. O código SwiftUI era válido. A estrutura do app fazia sentido. A UI parecia algo que um desenvolvedor júnior entregaria como primeiro rascunho, não como lixo gerado por IA.

O que torna o M2.7 interessante não é a capacidade bruta — ele ainda fica atrás do Opus 4.6 ou GPT-5.4 em tarefas complexas de raciocínio. O que é interessante é o design orientado a agentes. O modelo foi construído do zero para funcionar em fluxos de trabalho de chamada de ferramentas, execução de funções e múltiplas etapas. Esse é um alvo de otimização diferente de "pontuar bem no MMLU", e se nota.

Para desenvolvedores que querem hospedar um modelo com capacidade de agente por conta própria — especialmente para ferramentas internas onde enviar código para um API externo não é aceitável — o M2.7 é agora a opção de código aberto mais forte. Essa é uma mudança significativa.

O Modo Agente do VS Code Ganha Navegação Agêntica — E É Impressionante

A equipe do VS Code da Microsoft lançou algo esta semana que borra a linha entre IDE e agente autônomo de uma forma que eu não esperava ver por mais um ano.

O modo agente no VS Code agora pode interagir com páginas web ao vivo. Não apenas buscar conteúdo. Realmente interagir — clicando em elementos, preenchendo formulários, navegando entre páginas, lendo a saída renderizada. Seu agente de programação agora pode abrir um navegador, testar sua aplicação web, observar o que acontece e alimentar essa informação de volta ao seu processo de depuração.

Imagine isso: você está construindo um componente React que renderiza uma tabela de dados com colunas ordenáveis. Em vez de descrever o bug para seu assistente de IA ("a ordem de classificação inverte incorretamente quando você clica no cabeçalho duas vezes"), o agente pode literalmente abrir seu servidor de desenvolvimento, clicar no cabeçalho da coluna duas vezes, observar o comportamento incorreto, inspecionar o DOM e então propor uma correção baseada no que realmente viu.

Passei uma tarde testando isso com um projeto Next.js que tinha um erro persistente de incompatibilidade de hidratação que eu não conseguia localizar. O agente abriu a página, identificou a incompatibilidade entre renderização do servidor e do cliente, rastreou até um formato de data dependente de fuso horário e sugeriu uma correção. O processo todo levou cerca de noventa segundos. Eu estava olhando para aquele bug há duas horas.

As implicações vão além da depuração. Agentes que podem navegar significam agentes que podem verificar seu próprio trabalho contra a saída real renderizada. Isso é um ciclo de feedback que melhora dramaticamente a qualidade do código — o agente não precisa confiar que suas alterações funcionam, ele pode verificar.

Há uma dimensão de privacidade e segurança que vale destacar. Um agente navegando páginas web ao vivo significa que sua extensão de IDE está potencialmente enviando conteúdo de página — incluindo quaisquer dados visíveis na tela — por meio de um API de IA. Para dashboards internos com dados sensíveis, pense bem antes de apontar a navegação agêntica para seu ambiente de staging.

Mas é aí que as coisas ficam realmente interessantes — porque o VS Code não é o único aproximando a IA do desktop esta semana.

Nvidia GTC 2026: Raciocínio de Código Aberto, DLSS5 e Todo um Sistema Operacional de IA

A palestra do GTC da Nvidia trouxe anúncios suficientes para preencher três artigos separados. Vou focar nos três que mais importam para desenvolvedores de IA.

Neotron Ultra é o modelo de raciocínio de código aberto da Nvidia, e está posicionado diretamente contra modelos proprietários como Opus e GPT-5.x para raciocínio complexo de múltiplas etapas. Código aberto. Da Nvidia. Uma empresa que poderia facilmente manter isso proprietário e cobrar por acesso ao API. O fato de estarem lançando abertamente sinaliza algo: a jogada da Nvidia não é vender modelos. É vender o hardware onde esses modelos rodam. Tornar modelos poderosos gratuitos e abertos aumenta a demanda por H200s e o que vier depois. Estratégia inteligente.

Não tive tempo suficiente para fazer benchmarks adequados do Neotron Ultra contra minha suíte de testes padrão, mas resultados iniciais da comunidade sugerem que ele é competitivo com o Opus 4.5 em tarefas de raciocínio e fica atrás do Opus 4.6 por uma margem menor do que o esperado. Para implantações on-premise onde você não pode usar APIs externos, esta é uma opção séria.

Nemoclaw é a resposta da Nvidia para a pergunta "como você realmente orquestra sistemas de IA". É um stack completo de AIOS (Sistema Operacional de IA) — pense nele como a camada de infraestrutura entre seu hardware e seus agentes de IA. Roteamento de modelos, gerenciamento de memória, orquestração de ferramentas, tudo tratado em nível de sistema em vez de montado com scripts Python e esperança.

Para empresas rodando múltiplos modelos em múltiplas tarefas, o Nemoclaw resolve problemas reais de coordenação. Para desenvolvedores individuais, provavelmente é exagero por enquanto. Mas o fato da Nvidia estar construindo nessa camada diz para onde eles acham que a complexidade está indo.

DLSS5 é o anúncio de jogos/gráficos, e embora seja menos relevante para fluxos de trabalho de desenvolvimento de IA, vale mencionar porque demonstra a tese mais ampla da Nvidia: inferência de IA deveria estar em todo lugar, rodando tudo, o tempo todo. O DLSS5 usa IA para escalonar, gerar frames e reconstruir cenas em tempo real. A mesma infraestrutura de inferência que alimenta o DLSS vai alimentar agentes de IA no seu desktop. A Nvidia está construindo o ecossistema de hardware para um mundo onde a IA roda localmente, constantemente, para tudo.

Esse mundo está mais perto do que a maioria das pessoas pensa. O que me leva ao modelo de código aberto que pode acelerá-lo mais rápido.

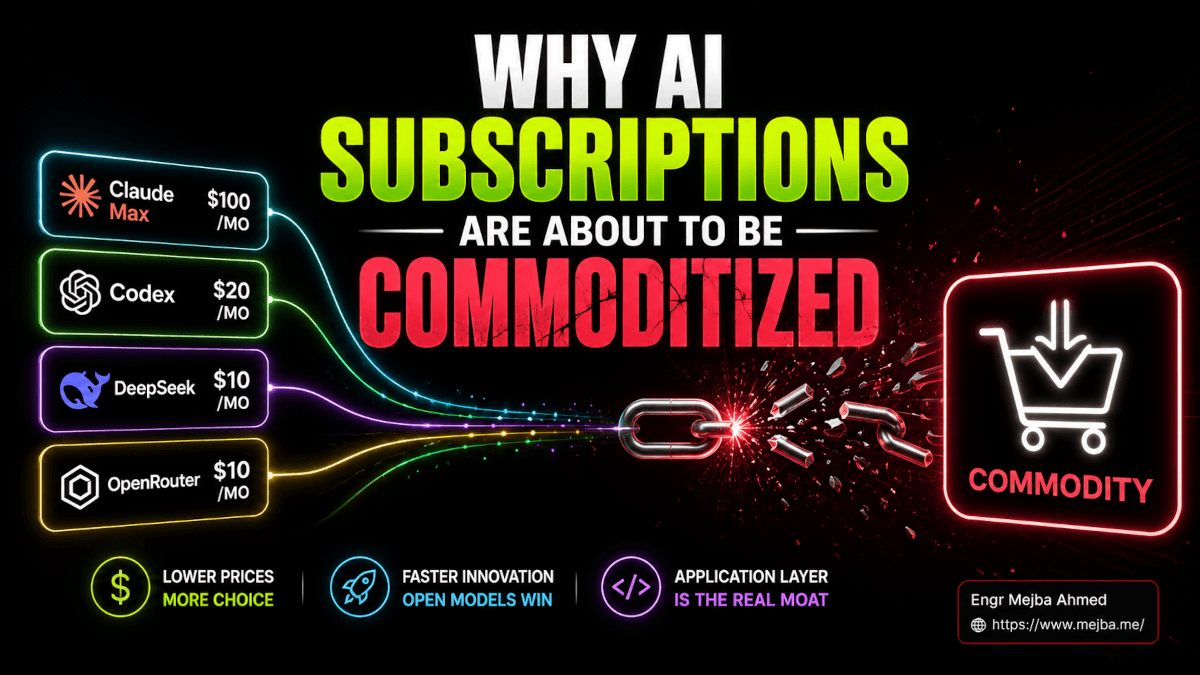

Mistral Small 2: 128 Especialistas, Apache 2.0 e uma Janela de Contexto de 256K

A Mistral vem construindo silenciosamente o que acredito ser a família de modelos mais interessante em IA de código aberto. O Small 2 é o mais recente, e a ficha técnica parece uma lista de desejos.

Os números: 119 bilhões de parâmetros. 128 especialistas na arquitetura de mistura de especialistas (o que significa que apenas uma fração desses parâmetros é ativada para cada token, mantendo os custos de inferência razoáveis). Janela de contexto de 256K tokens. Lançado sob Apache 2.0 — o que significa que você pode usá-lo comercialmente, modificá-lo, implantá-lo como quiser, sem restrições.

E a Mistral anunciou uma parceria com a Nvidia para otimizar o Small 2 para o stack de inferência da Nvidia. Modelo aberto mais hardware otimizado mais licença Apache é uma combinação que deveria preocupar toda empresa que cobra por token de API.

O que chamou minha atenção durante os testes: as capacidades de agente do Small 2 são fortes o suficiente para fluxos de trabalho de produção com chamada de ferramentas. Submeti-o a uma avaliação padrão onde o modelo precisa planejar uma tarefa de múltiplas etapas, chamar ferramentas apropriadas em sequência, lidar com erros e se recuperar. O Small 2 completou o fluxo de trabalho na primeira tentativa — algo em que até alguns modelos proprietários tropeçam.

A janela de contexto de 256K se posiciona de forma interessante. Não são os 1M que o Claude agora oferece, mas é mais que suficiente para a maioria das tarefas reais de agentes. E como você está rodando no seu próprio hardware, não está pagando por token por esse contexto. Para equipes processando grandes bases de código ou conjuntos de documentos repetidamente, a economia de hospedar o Mistral Small 2 por conta própria versus pagar taxas de API por modelos com contexto maior é um cálculo que vale a pena fazer.

A licença Apache 2.0 merece ênfase. A maioria dos modelos "abertos" vem com restrições — cláusulas não comerciais, limitações de uso ou licenças customizadas com exceções. Apache 2.0 é genuinamente permissiva. Você pode fazer fine-tuning do Small 2 com seus dados proprietários, implantá-lo internamente, vender produtos construídos sobre ele, e a Mistral não pode mudar retroativamente os termos. Para equipes jurídicas empresariais, isso remove a ambiguidade que torna arriscado adotar outros modelos "abertos".

IA de código aberto ficou muito mais difícil de ignorar. E aparentemente o Google percebeu — porque o que vazou esta semana sugere que eles estão preparando uma resposta que ninguém esperava.

A Ferramenta de Design Agêntico Vazada do Google: Voz, Canvas e uma Nova Direção

Alguém vazou imagens do que parece ser a ferramenta de design de próxima geração do Google. Quero ser cuidadoso aqui — este é material vazado, não um anúncio oficial, e o produto final pode diferir significativamente do que foi mostrado. Essa ressalva importa.

O que o vazamento mostra: um aplicativo desktop (não baseado em navegador — só isso já é surpreendente vindo do Google) com um canvas de design amplo e rolável. A interface suporta comandos de voz para operações de design. Aparentemente você pode falar instruções como "faça o cabeçalho maior" ou "alinhe esses elementos a uma grade" e ver as mudanças acontecerem em tempo real no canvas.

A parte agêntica é o que torna isso diferente de um simples Figma controlado por voz. A ferramenta parece entender a intenção de design, não apenas instruções literais. "Faça isso parecer mais profissional" supostamente aciona um conjunto coerente de mudanças — ajustes de tipografia, modificações de espaçamento, mudanças de temperatura de cor — em vez de uma única ação mecânica.

Se isso for lançado remotamente parecido com o que vazou, poderia pressionar Figma, Canva e toda ferramenta de design que não integrou IA agêntica profundamente no processo de criação. Só a interface de voz mudaria como os designers trabalham — sem mais troca de contexto entre pensar no design e manipular ferramentas para executá-lo.

Sou cético em relação a duas coisas. Primeiro, o Google tem um histórico de demos impressionantes que não sobrevivem ao contato com usuários reais. Segundo, design controlado por voz funciona brilhantemente para ajustes amplos mas tem dificuldade com precisão no nível de pixel. Designers profissionais precisam de ambos. Veremos se o Google resolveu essa tensão ou simplesmente contornou na demo.

O que estou observando: se essa ferramenta se conecta à infraestrutura de modelos do Google (Gemini) ou roda em um stack separado. Essa decisão de arquitetura vai determinar se desenvolvedores terceiros podem construir em cima dela.

Falando em decisões de arquitetura que importam mais do que parecem — o próximo anúncio é aquele que eu estava esperando para falar.

Claude Chega a 1M de Tokens: O que Mudou na Prática

Escrevi uma análise detalhada da janela de contexto de um milhão de tokens do Opus 4.6 no dia em que foi lançado, então não vou repetir a análise completa aqui. Mas merece um lugar de destaque no resumo desta semana porque o impacto prático tem sido maior do que eu inicialmente esperava.

A manchete: Opus 4.6 e Sonnet 4.6 agora suportam janelas de contexto de 1 milhão de tokens. A Anthropic também dobrou os limites de uso, o que importa tanto quanto a expansão de contexto para usuários avançados que constantemente atingiam os limites.

O número que importa mais que "1M" é 78,3%. Essa é a pontuação MRCR v2 — um benchmark que mede quão precisamente o modelo recupera informações específicas espalhadas por todo o contexto. Para comparação, a maioria dos modelos se degrada significativamente após 100K tokens. O Opus 4.6 mantém 78,3% de precisão ao longo de toda a janela de um milhão de tokens. O modelo não apenas aceita mais contexto — ele realmente o usa.

O que mudou no meu fluxo de trabalho desde o lançamento: parei de fragmentar grandes bases de código em janelas de contexto separadas. Uma aplicação Laravel completa — models, controllers, migrations, configuração, testes — pode estar em um único contexto agora. O modelo vê tudo simultaneamente. Sugestões de refatoração consideram efeitos em cascata em toda a base de código em vez de apenas nos arquivos que incluí manualmente.

A diferença prática entre 200K e 1M de tokens não é 5x mais entrada. É a eliminação do gerenciamento de contexto como tarefa. Eu costumava gastar esforço cognitivo real decidindo quais arquivos incluir e quais deixar de fora. Essa sobrecarga de tomada de decisão desapareceu. Incluo tudo e deixo o modelo descobrir o que é relevante.

Se você quer o detalhamento completo dos benchmarks e meus resultados de testes do mundo real, a análise completa está aqui. Para este resumo, a conclusão chave é simples: 1M de tokens com 78,3% de precisão MRCR significa que o gerenciamento de contexto não é mais o gargalo. O gargalo se moveu para outro lugar completamente.

E duas empresas esta semana apostam que o novo gargalo é a agência — a capacidade da IA de agir autonomamente em seu nome. Aqui é onde fica pessoal.

Okra AI CMO e o PC Sempre Ligado da Perplexity: A IA Ganha uma Mesa Permanente

Dois anúncios esta semana compartilham uma filosofia que acho tanto empolgante quanto levemente inquietante: a IA não deveria ser uma ferramenta que você abre quando precisa. Deveria ser um colega que está sempre trabalhando.

Okra se posiciona como um Diretor de Marketing de IA. Não um chatbot que responde perguntas de marketing. Um sistema que executa autonomamente experimentos de crescimento, analisa resultados, ajusta campanhas e reporta descobertas — com mínima intervenção humana. Monitora suas métricas, identifica oportunidades, testa hipóteses e itera. O equivalente em marketing de um agente autônomo que se especializa em aquisição de clientes.

Não testei o Okra extensivamente ainda, mas a arquitetura é interessante: ele se conecta às suas análises, plataformas de anúncios e CMS, e então opera em um ciclo contínuo de observação, hipótese, ação, medição. Pense nele como a versão de marketing do que CI/CD fez pela implantação — a máquina roda o ciclo de feedback mais rápido do que humanos conseguem.

O Sistema de Computador Pessoal com IA da Perplexity leva o conceito de "sempre ligado" ainda mais literalmente. É um sistema local baseado em Mac Mini que roda a IA da Perplexity 24/7 na sua mesa. Sempre ouvindo, sempre processando, sempre pronto. Sua IA pessoal que não vive em uma aba do navegador — vive na sua rede, acumulando contexto sobre seu trabalho, suas preferências, seus padrões.

As implicações de privacidade são significativas — e digo isso em ambas as direções. Ter sua IA rodando localmente significa que seus dados nunca saem da sua rede. Essa é uma vantagem enorme para qualquer pessoa que trabalhe com informações sensíveis. Mas "sempre ligado" também significa "sempre monitorando", e a linha entre assistente útil e sistema de vigilância depende inteiramente dos detalhes de implementação que a Perplexity não divulgou completamente.

O que esses dois anúncios compartilham é uma aposta de que o próximo formato da IA não é uma janela de chat. É uma presença persistente. Uma inteligência sempre disponível que trabalha ao seu lado — ou em seu nome — sem que você precise iniciar cada interação.

Se você preferir que alguém construa sistemas de automação com IA como esses integrados aos fluxos de trabalho do seu negócio, eu aceito exatamente esse tipo de projeto de integração. Você pode ver o que já construí em fiverr.com/s/EgxYmWD.

Ainda estou decidindo como me sinto sobre essa direção. O potencial de produtividade é real. O risco de dependência também é real. Terceirizar sua estratégia de marketing para uma IA significa que você precisa confiar profundamente tanto no julgamento da IA quanto na sua capacidade de auditar suas decisões. A maioria das empresas não está pronta para esse nível de confiança ainda.

Mas as ferramentas para construir essa confiança estão melhorando rápido. O que nos leva a dois lançamentos focados em dar aos desenvolvedores mais controle sobre suas ferramentas de IA.

Stitch TypeScript SDK e Manis Desktop Agent: A Camada de Controle para Desenvolvedores

Dois lançamentos focados em desenvolvedores esta semana merecem atenção, embora tenham recebido menos destaque nas redes sociais do que os anúncios maiores.

Stitch TypeScript SDK é o SDK oficial de TypeScript para fluxos de trabalho de design para desenvolvimento. Se você usou a plataforma da Stitch, o SDK dá acesso programático às mesmas capacidades de tradução de design — obter tokens de design, gerar código de componentes, sincronizar mudanças de design com sua base de código, tudo a partir do TypeScript.

Por que isso importa: a lacuna entre ferramentas de design e código tem sido fonte de atrito desde que ambos existem. Designers criam no Figma. Desenvolvedores traduzem para CSS. Discrepâncias se multiplicam. O SDK da Stitch automatiza a camada de tradução. Para equipes rodando pipelines contínuos de design para código, isso remove uma etapa manual que introduz erros toda vez.

Manis Desktop AI Agent se posiciona como uma alternativa local e privada a sistemas de agentes baseados em nuvem como o OpenClaw. Roda inteiramente no seu desktop — sem chamadas de API, sem dados saindo da sua máquina. A contrapartida é óbvia: você precisa de hardware potente o suficiente para rodar o modelo subjacente localmente, e o modelo que você pode rodar localmente será menor do que o disponível via APIs na nuvem.

Mas para desenvolvedores trabalhando com código proprietário, ferramentas internas ou qualquer coisa coberta por políticas rígidas de governança de dados, o Manis resolve um problema real. Seu assistente de IA vê seu código, planeja modificações e executa mudanças — tudo sem nenhum dado tocar um servidor externo. Essa é uma garantia de conformidade que nenhuma IA na nuvem consegue igualar.

O padrão que conecta Stitch e Manis: ferramentas de desenvolvimento estão se movendo em direção a dar aos construtores mais controle sobre onde sua IA roda, como ela se conecta ao fluxo de trabalho e a quais dados pode acessar. A era de "enviar tudo para um API e torcer pelo melhor" está acabando. Desenvolvedores querem IA que respeite os limites de sua infraestrutura.

Mais um lançamento desta semana reforça esse tema — e pode ser o mais tecnicamente significativo de tudo o que cobrimos.

Attention Residual da Moonshot: A Arquitetura da qual Ninguém Está Falando

Guarde este nome: Attention Residual. É um novo mecanismo de atenção da Moonshot AI, e acredito que é o anúncio tecnicamente mais importante da semana — mesmo tendo recebido uma fração da atenção que os lançamentos mais chamativos receberam.

O problema que ele resolve. A atenção padrão de transformadores trata cada token anterior com importância computacional aproximadamente igual. O modelo atende a tudo em seu contexto — tokens úteis, tokens irrelevantes, ruído. À medida que as janelas de contexto crescem (olá, 1M de tokens), isso se torna cada vez mais desperdiçado. Você está gastando computação atendendo a contexto que não importa para a etapa atual de geração.

Attention Residual introduz seletividade. O mecanismo aprende a identificar qual contexto anterior é realmente útil para a predição atual e aloca computação de acordo. Pense nisso como o modelo aprendendo a fazer uma leitura dinâmica — não lendo cada palavra com a mesma intensidade, mas focando profundamente nas partes que importam e passando rapidamente pelo resto.

Os resultados no modelo de 48B parâmetros da Moonshot: 1,25x de eficiência computacional. Isso significa que você obtém a mesma qualidade de saída por 80% do custo computacional. Ou — e esta é a interpretação que acho mais empolgante — você obtém melhor qualidade de saída pelo mesmo orçamento computacional, porque o modelo gasta sua computação em contexto relevante em vez de distribuí-la uniformemente por tudo.

Por que isso importa além de um único modelo: se Attention Residual (ou arquiteturas inspiradas nele) for adotado amplamente, muda a economia das janelas de contexto grandes. Agora, contextos de 1M de tokens são caros de servir. Um ganho de eficiência de 1,25x na camada de atenção se propaga por todo o pipeline de inferência. Torna contextos grandes mais baratos, o que os torna mais acessíveis, o que significa que mais desenvolvedores podem construir sistemas que os utilizem.

As implicações para sistemas multi-agente são particularmente interessantes. Agentes se coordenando por meio de janelas de contexto compartilhadas são limitados por quão caro é manter esse contexto compartilhado. Atenção mais eficiente significa coordenação mais acessível, o que significa que fluxos de trabalho multi-agente mais complexos se tornam economicamente viáveis.

Vou ser honesto — não tive tempo de testar Attention Residual diretamente. O artigo foi publicado no meio da semana e a implementação não está disponível publicamente ainda. Estou trabalhando a partir dos resultados publicados e da descrição da arquitetura. Mas a base teórica é sólida, e os ganhos de eficiência reportados se alinham com o que você esperaria de um mecanismo que substitui atenção uniforme por atenção seletiva.

Este é o tipo de melhoria de infraestrutura que não gera manchetes mas molda os próximos dois anos do que é possível. Os lançamentos chamativos conseguem os tweets. As inovações arquitetônicas conseguem o impacto.

O que Esta Semana Realmente Significa para Construtores

Aqui está minha leitura honesta da semana, sem hype.

Se você constrói com IA diariamente: A janela de contexto de 1M do Claude e os sub-agentes do Codex são imediatamente úteis. Atualize seus fluxos de trabalho. Pare de fragmentar contexto manualmente. Comece a experimentar com execução paralela de agentes. Estas não são promessas futuras — são funcionalidades que você pode usar hoje.

Se você está avaliando modelos auto-hospedados: Mistral Small 2 e Neotron Ultra da Nvidia acabaram de mudar a equação. A lacuna de desempenho entre código aberto e proprietário diminuiu significativamente esta semana. Rode seus próprios benchmarks nos seus casos de uso específicos, mas não assuma que modelos proprietários são automaticamente melhores. Para muitas cargas de trabalho em produção, não são.

Se você é um líder técnico tomando decisões de arquitetura: O padrão multi-agente está convergindo em todos os principais provedores. Se sua arquitetura de IA atual é "um modelo, um prompt, uma resposta", você já está atrás da curva. Comece a prototipar fluxos de trabalho baseados em agentes. As ferramentas estão prontas. Os modelos são capazes. O único gargalo é a disposição organizacional de repensar como a IA se encaixa nos seus sistemas.

Se você está de olho no longo prazo: Preste atenção ao Attention Residual e inovações arquitetônicas similares. A geração atual de modelos fundacionais é limitada por computação. Melhorias arquitetônicas que tornam a inferência mais eficiente vão determinar quais tamanhos de contexto, complexidades de agentes e tamanhos de modelos se tornam economicamente viáveis em escala. A empresa que resolver atenção eficiente em 10M+ tokens vence a próxima rodada.

Uma coisa em que errei mês passado: previ que a lacuna entre código aberto e proprietário levaria até o final de 2026 para fechar em modelos com capacidade de agente. Esta semana provou que eu estava errado por cerca de seis meses. Minimax M2.7, Mistral Small 2 e Neotron Ultra coletivamente anteciparam essa linha do tempo de maneiras que eu não previ.

O ritmo não está desacelerando. Se algo, os ciclos de feedback entre melhorias de hardware, inovações arquitetônicas e capacidades dos modelos estão acelerando. Cada avanço facilita o próximo.

O Padrão em que Não Consigo Parar de Pensar

Doze anúncios em sete dias. Essa é a observação superficial. O padrão mais profundo é o que continua me puxando.

Cada grande anúncio desta semana apontava na mesma direção: a IA está se tornando ambiente. Não uma ferramenta que você abre. Não uma janela de chat onde você digita. Uma inteligência tecida no seu IDE, suas ferramentas de design, seu stack de marketing, seu desktop — rodando continuamente, agindo autonomamente, se coordenando com outros sistemas de IA para lidar com complexidade que nenhum agente sozinho conseguiria gerenciar.

Há um ano, a pergunta era "quão boa é a IA?" Agora a pergunta é "quanto do meu fluxo de trabalho a IA já está gerenciando sem eu perceber?" A mudança de capacidade para integração aconteceu mais rápido do que eu esperava. Esta semana acelerou ainda mais.

Comecei este resumo tentando classificar esses doze desenvolvimentos por importância. Não consigo. Não são doze histórias separadas. São doze facetas da mesma história: o desenvolvimento de IA em 2026 é menos sobre qualquer modelo ou produto individual e mais sobre o ecossistema de agentes, arquiteturas e infraestrutura que torna o trabalho autônomo de IA realmente útil.

Se você tirou algo desta análise, aqui está meu pedido: escolha um anúncio desta lista que seja relevante para seu trabalho. Não os doze. Um. Vá testá-lo esta semana. Construa algo pequeno com ele. A diferença entre ler sobre desenvolvimentos em IA e experimentá-los em primeira mão é a diferença entre ver alguém nadar e entrar na água.

A água está morna agora. E está ficando mais funda rápido.

Perguntas Frequentes

Qual é o maior desenvolvimento de IA em março de 2026?

O Opus 4.6 e Sonnet 4.6 do Claude atingindo janelas de contexto de 1 milhão de tokens com 78,3% de precisão MRCR v2 é o desenvolvimento mais imediatamente impactante para desenvolvedores em atividade. Elimina o gerenciamento de contexto como gargalo pela primeira vez. Para o detalhamento completo dos benchmarks, veja minha análise detalhada.

O Mistral Small 2 é melhor que o GPT-5.4 ou o Claude Opus 4.6?

O Mistral Small 2 fica atrás de ambos em benchmarks de raciocínio geral, mas compete efetivamente em tarefas de agentes e chamada de ferramentas. Sua verdadeira vantagem é a licença Apache 2.0 e a capacidade de auto-hospedagem — você é dono da implantação por completo. Para equipes com requisitos de governança de dados, pode ser a melhor escolha prática apesar de capacidade de pico inferior.

O que é Attention Residual e por que importa?

Attention Residual é um novo mecanismo de atenção de transformadores da Moonshot AI que atende seletivamente ao contexto relevante em vez de processar todos os tokens igualmente. Alcança 1,25x de eficiência computacional no seu modelo de 48B parâmetros, o que poderia tornar janelas de contexto grandes significativamente mais baratas de servir se a abordagem for adotada amplamente.

Posso rodar agentes de IA localmente sem APIs na nuvem em 2026?

Sim — várias ferramentas agora suportam fluxos de trabalho de agentes de IA totalmente locais. O Manis Desktop AI Agent roda inteiramente na sua máquina sem chamadas a APIs externos. Combinado com modelos de código aberto como Mistral Small 2 ou Minimax M2.7, você pode construir sistemas de agentes capazes que nunca enviam dados para fora do seu hardware.

Como os Sub Agents da OpenAI para Codex se comparam com as Equipes de Agentes do Claude?

Ambos implementam o mesmo padrão central: sub-agentes especializados trabalhando em paralelo em diferentes aspectos de uma tarefa, se coordenando por meio de contexto compartilhado. A implementação da OpenAI foca em fluxos de trabalho de desenvolvimento baseados em CLI enquanto as equipes de agentes do Claude operam em tipos de tarefas mais amplos. O consumo de tokens é maior com ambos — aproximadamente proporcional ao número de agentes paralelos.

Let's Work Together

Looking to build AI systems, automate workflows, or scale your tech infrastructure? I'd love to help.

- Fiverr (custom builds & integrations): fiverr.com/s/EgxYmWD

- Portfolio: mejba.me

- Ramlit Limited (enterprise solutions): ramlit.com

- ColorPark (design & branding): colorpark.io

- xCyberSecurity (security services): xcybersecurity.io