Hoe Coder IDE Quest Mode Mijn Manier van Apps Bouwen Veranderde

De cursor hield op met knipperen.

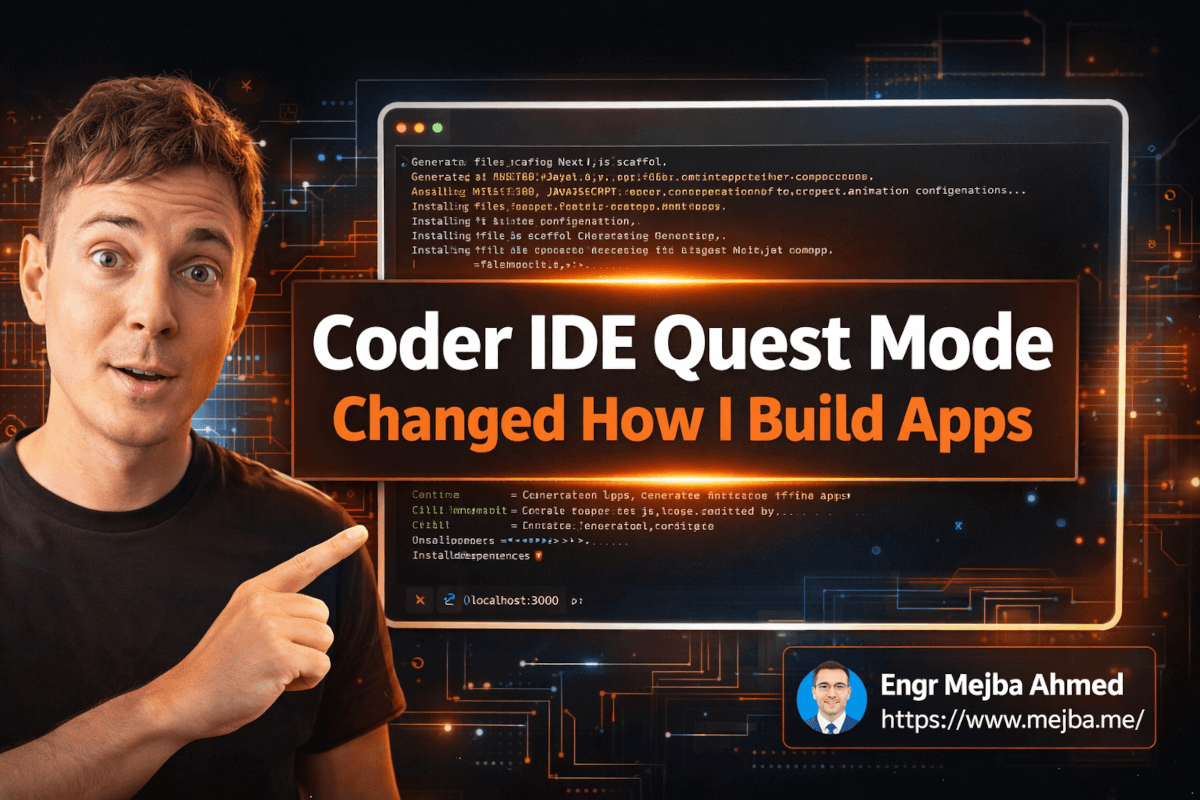

Ik had een prompt van vier regels getypt, op enter gedrukt en was koffie gaan halen. Toen ik terugkwam — misschien drie minuten later — was de terminal tot leven gekomen met logs van bestandsaanmaak. Niet een paar bestanden. Een complete projectstructuur: componenten, een aangepaste JavaScript-interpreter, animatieconfiguraties, een Next.js-scaffold, een package.json met al geïnstalleerde afhankelijkheden, en een localhost:3000-URL die daar gewoon klaarstond om geopend te worden.

Ik had geen enkele regel code geschreven.

Dat was mijn zevende dag van testen met Coder IDE, en het was het moment waarop ik besefte dat dit hulpmiddel vanuit een andere aanname werkt dan alles wat ik eerder heb gebruikt. GitHub Copilot gaat ervan uit dat jij de baas bent. Cursor gaat ervan uit dat jij de navigatiegids bent. Coder gaat ervan uit dat je bereid bent het stuur volledig over te geven — en het is klaar om de auto ergens naartoe te rijden waar het de moeite waard is.

Wat ik maar niet van me af kon zetten: de code was écht goed. Niet "acceptabele AI-output die drie rondes opruimen nodig heeft." Oprecht goed. Modulair, leesbaar, met componenten die architectureel zinvol waren. Dat is niet iets wat ik gemakkelijk zeg. Ik heb genoeg AI-gegenereerde code beoordeeld om te weten wanneer iets er goed uitziet maar uit elkaar valt zodra je het richting productie duwt.

Dit hield stand.

De vraag die ik zeven tot tien dagen lang had achtervolgd: kan een AI IDE de steiger- en opzetfase van echte ontwikkeling daadwerkelijk vervangen zonder rommel te produceren die ik twee keer zo lang bezig zou zijn met repareren? Het antwoord is niet eenvoudig. Maar het is optimistischer dan ik had verwacht — en ik ga je precies laten zien waarom, inclusief de onderdelen die me ongemakkelijk maakten.

Waarom Ik Überhaupt Op Zoek Was Naar Iets Nieuws

Dit is de eerlijke versie van waarom ik überhaupt nieuwe IDE's aan het testen was.

Ik bouw meer dingen dan ooit. Klantprojecten, persoonlijke automatiseringstools, zijdelingse experimenten, content-infrastructuur. De eigenlijke technische uitdagingen zijn interessant. De opzet niet. Elk nieuw project begint met dezelfde vijfenveertig minuten mappen aanmaken, framework-boilerplate, basis componentbedrading, configuratiebestanden aanpassen, afhankelijkheden installeren. Dat werk is niet moeilijk. Het is gewoon langzaam — en het trekt de focus weg van de onderdelen van software-engineering die ik werkelijk interessant vind.

De meeste AI-codeertools beweren dit op te lossen. De meeste doen het niet — niet echt. Wat ze eigenlijk doen, is automatisch aanvullen versnellen en vloeiender chatten. Je schrijft nog steeds de opzetcode. Je neemt nog steeds elke structurele beslissing. De AI is een slimmere tekstexpander met een verrassend goed geheugen voor Stack Overflow-antwoorden.

Ik heb Cursor de afgelopen maanden intensief gebruikt. Het is uitstekend voor wat het doet: codebase-bewuste suggesties, snelle aanvullingen, een goede multi-bestand composer. Maar Cursor gaat er nog steeds van uit dat ik het stuur in handen heb. Als ik een nieuw project start, helpt Cursor me boilerplate sneller te schrijven. Het schrijft de boilerplate niet voor mij, installeert de afhankelijkheden niet, start de dev-server niet op, en geeft me geen draaiende applicatie.

Dat gat is waar Coder zijn vlag plant.

Quest Mode is geen AI-assistentie. Het is AI-delegatie. Je beschrijft wat je wilt, de AI plant het, jij keurt goed of stuurt bij, en vervolgens bouwt het daadwerkelijk — niet alleen code schrijven om ergens te plakken, maar bestanden openen, commando's uitvoeren, pakketten installeren, servers starten en terugkomen om verslag uit te brengen. Ik had over dit soort autonoom agentgedrag gelezen in onderzoekscontexten. Zien hoe het in minder dan tien minuten een werkende applicatie produceerde op een echte taak, was anders dan erover lezen.

Maar voordat we bij de demo komen — en de resultaten — moet je het model begrijpen dat dit alles aandrijft. Want daar begint het kwaliteitsverschil, en de meeste reviews slaan dit gewoon over.

Qwen Coder 1.0 — Het Model Achter Alles

Coder IDE maakt gebruik van een eigen AI-model genaamd Qwen Coder 1.0, ontwikkeld door Alibaba specifiek voor deze IDE en zijn autonome codeerworkflows.

Toen ik dat voor het eerst las, was mijn eerlijke reactie scepsis. Eigen modellen die zijn gebouwd voor specifieke tools betekenen doorgaans: "We hebben GPT-3.5 op wat codedata verfijnd en het een merknaam gegeven." Dat is het standaardpatroon. Ik heb er genoeg van gezien om een gezonde wantrouwen te ontwikkelen tegenover de "aangepast model"-pitch.

Dit model is anders.

De kwaliteit van de output komt overeen met wat ik zou verwachten van de topklasse frontier-modellen op codeertaken. Maar meer dan alleen outputkwaliteit — die nagebootst kan worden met voldoende prompt-engineering — toont het redeneren in Qwen Coder 1.0 iets meer doordachts. Toen het Next.js koos voor het JavaScript-visualiseringsproject, legde het uit dat de routing-vereisten en de geplande componentscheiding Next.js een betere keuze maakten dan een gewone React-setup. Dat redeneren was correct. Het klopte precies met hoe ik dezelfde beslissing had genomen.

Toen het Motion koos voor animaties, noemde het overwegingen over bundelgrootte en het type op fysica gebaseerde overgangen die de visualiser nodig zou hebben. Toen het koos voor een JavaScript-interpreter-aanpak boven WebAssembly — een minder voor de hand liggende beslissing — merkte het op dat de interpreter nauwkeurigere uitvoeringsmonitoring zou geven zonder de compilatieoverhead die WebAssembly op deze schaal zou introduceren.

Dit zijn niet de uitleg van een model dat patroonovereenkomst maakt met de meest voorkomende bibliotheek in zijn trainingsdata. Er is iets wat specifiek is gebouwd voor architecturale besluitvorming aan de hand.

Op dit moment is Qwen Coder 1.0 gratis voor proefgebruikers. Dat zal niet blijven — ik wil hier transparant over zijn. De prijsstelling van Coder is nog niet volledig aangekondigd, en de huidige proeftoegang is vrijwel zeker een voorproefje van hoe de betaalde tier eruit zal zien. Ik zou het huidige venster beschouwen als je kans om het hulpmiddel op zijn maximum te evalueren, niet als een permanente regeling.

Dat maximum is oprecht hoog.

Editor Mode vs Quest Mode — Twee Verschillende Tools in Één IDE

Coder wordt geleverd met twee afzonderlijke bedieningsmodi, en het onderscheid is belangrijk omdat ze fundamenteel verschillende workflows bedienen. Ze als hetzelfde hulpmiddel behandelen zou zijn als een accuboormachine en een kolomboormachine door elkaar halen omdat ze allebei draaien.

Editor Mode is bekend terrein. Denk aan VS Code met een AI-laag die direct in de interface is ingebouwd — niet als extensie erop geplakt, maar geweven in de kernworkflow. Je krijgt intelligente codevoorspellingen, een geïntegreerd agent-chatpaneel, realtime debugging-hulp en de mogelijkheid om externe repositories te verkennen zonder ze lokaal te klonen. De UI is onmiddellijk vertrouwd als je enige tijd in VS Code hebt doorgebracht. Het spiergeheugen is er al.

Editor Mode verwerkt de dingen die je van een moderne AI IDE zou verwachten: vragen beantwoorden over je bestaande code, helpen debuggen van een specifieke functie, een component genereren wanneer je er precieze vereisten aan geeft, uitleggen waarom iets niet werkt. Het is solide in al deze. Maar als dat alles was wat Coder bood, zou het een zeer drukke ruimte betreden tegenover tools met jaren voorsprong en enorme gebruikersbases.

Quest Mode is waar Coder zijn identiteit op inzet.

Activeer Quest Mode en het paradigma verschuift volledig. Je bent niet langer een ontwikkelaar die AI-hulp gebruikt — je bent meer een projectmanager die delegeert aan een AI-ontwikkelaar. Je geeft een doel op in gewone taal, zo specifiek of zo open als je wilt. De AI begint niet onmiddellijk met code schrijven. Het stelt eerst verduidelijkende vragen. Het stelt een architecturaal plan voor. Het vertelt je welke frameworks en bibliotheken het van plan is te gebruiken en waarom. Jij keurt goed, stuurt bij of geeft tegendruk.

Dan voert het uit.

En "uitvoeren" betekent hier iets letterlijks. Coder genereert geen codeblok en plakt het in een chatvenster voor jou om elders te kopiëren. Het opent echte bestanden. Maakt mappen aan. Schrijft code over meerdere componenten tegelijkertijd. Voert npm install uit. Start een dev-server. Controleert of de applicatie laadt. Rapporteert over fouten en lost ze op zonder aansporing. De gehele ontwikkelingspipeline, autonoom afgehandeld.

Dit verschilt categorisch van chat-gebaseerde codegeneratie, en het verschil is niet subtiel.

De JavaScript-Visualiser Bouwen — Wat Er Werkelijk Gebeurde

Dit is de demonstratie die me ervan overtuigde dat Quest Mode serieuze aandacht verdient. Ik ga er precies doorheen lopen omdat het proces is waar de waarde concreet wordt.

Het doel: Bouw een interactieve JavaScript-visualiser. Iets dat een codefragment stap voor stap kan uitvoeren en laat zien wat er in elke fase gebeurt — de globale uitvoeringscontext die wordt aangemaakt, hoe de call stack groeit en krimpt, hoe de event loop async-bewerkingen afhandelt, en hoe setTimeout-callbacks en microtaken worden in de wachtrij geplaatst en in de juiste volgorde worden opgelost.

Dit is een oprecht complexe UI-engineeringuitdaging. Je hebt een werkende JavaScript-interpreter of parser nodig. Een visualisatielaag die geneste stackframes in realtime kan tonen. Vloeiende animatie om de uitvoering intuïtief te laten aanvoelen in plaats van schokkerig. Een lay-out die vier gelijktijdige visualisaties leesbaar houdt zonder visuele chaos. En het moet nauwkeurig zijn — als de event loop-volgorde verkeerd is, leert het hulpmiddel onjuiste mentale modellen.

Ik gaf Quest Mode vier zinnen.

Zoiets als: "Bouw een JavaScript-codevisualiser die uitvoering regel voor regel toont met animatie. Ik wil de globale uitvoeringscontext, de call stack, de event loop en async-gedrag zien met taken en microtaken. Dark mode. Gebruik een JS-interpreter in plaats van WebAssembly."

Toen begon Coder verduidelijkende vragen te stellen.

Eerste: welk frontend-framework? Ik zei React. Tweede: welke JavaScript-functies moet de visualiser aankunnen — promises, async/await, generator functions? Ik specificeerde promises en async/await als prioriteit. Derde: uitvoeringsbenadering — echte interpreter of gesimuleerde uitvoering met een vooraf getraceerde AST? Ik zei interpreter als stabiel, gesimuleerd als de interpreter op deze schaal instabiliteit zou introduceren.

Drie verduidelijkende vragen. Dat was het volledige gesprek voordat de AI het overnam.

Quest Mode produceerde een planningssamenvatting: Next.js als framework (een goede keuze vanwege de routing en componentscheiding die het nodig zou hebben), Motion voor animaties, een aangepaste uitvoeringsmotor met Acorn voor AST-parsing om betrouwbare doorloop te geven zonder de risico's van live eval(), en een componentindeling die de visualiser opdeelde in vier afzonderlijke React-componenten met een gedeelde uitvoeringstoestand die via context stroomt.

Ik keurde het plan goed.

De volgende acht tot negen minuten keek ik toe hoe logs van bestandsaanmaak voorbijscrolden zonder iets aan te raken. /app/page.tsx, /components/CallStack.tsx, /components/EventLoop.tsx, /components/ExecutionContext.tsx, /components/CodeEditor.tsx met syntaxismarkering, /lib/interpreter.ts met de uitvoeringsmotor en AST-doorlooplogica, animatieconfiguraties met de veerphysica van Motion, CSS-modules voor het dark mode-thema, TypeScript-interfaces, gedeelde constanten. Pakketinstallatie liep automatisch. De dev-server startte.

Ik opende localhost:3000.

De visualiser was er. Draaiend. Ik gooide er een eenvoudige async-functie in — een mix van setTimeout-callbacks en een Promise.resolve().then()-keten ontworpen om te testen of de uitvoeringsvolgorde correct was — en klikte op Play. De code-editor markeerde de actieve regel terwijl de uitvoering erdoorheen bewoog. Het uitvoeringscontextpaneel toonde variabeledeclaraties die in de juiste volgorde werden aangemaakt. De call stack animeerde toevoegingen en verwijderingen met vloeiende veerbewegingen. De event loop-wachtrij toonde de setTimeout-callback die wachtte in de macrotaak-wachtrij terwijl de promise-callback als eerste uit de microtaak-wachtrij verdween — de correcte prioriteitsvolgorde.

De uitvoeringsvolgorde klopte. De animaties waren vloeiend. De dark mode UI was strak en doordacht, niet "dark mode als een nagedachte toegepast met grijze #333-achtergronden overal."

Ik zat er even gewoon naar te kijken.

Het Gedeelte Waar Niemand Je Voor Waarschuwt

Dat is het indrukwekkende verhaal. Hier is de echte talk — en ik denk dat dit gedeelte meer belang heeft dan de demo.

Quest Mode is krachtig. Het is geen magie.

De kwaliteit van je output volgt direct de kwaliteit van je prompt. Mijn specificatie van vier zinnen voor de JavaScript-visualiser was eigenlijk vrij precies — ik had nagedacht over wat ik nodig had voordat ik begon te typen. Toen ik Quest Mode testte met vagere prompts ("bouw me een projectvolgingsdashboard"), was de output functioneel maar generiek. De AI maakte redelijke gissingen over wat "projectvolging" betekende, en die gissingen waren prima maar niet interessant. Het verschil tussen een geweldige Quest Mode-output en een middelmatige zit bijna geheel in de specificiteit van de invoer.

Rommel erin, middelmatigheid eruit geldt nog steeds. De verpakking verandert. De wet niet.

De autonome uitvoering stuit ook op echte wrijving in de praktijk. Bij één project tijdens mijn testperiode installeerde Coder een specifieke versie van een afhankelijkheid met een breaking change in zijn configuratie-API ten opzichte van de vorige grote versie, en genereerde vervolgens code die was geschreven tegen de oude API. De applicatie faalde stil op manieren die niet voor de hand lagen uit de foutuitvoer. Een ontwikkelaar die die bibliotheek goed kende, zou de npm-versiewaarschuwing onmiddellijk hebben opgemerkt. De AI had extra iteraties nodig om het te identificeren en te corrigeren. Dit werd opgelost — maar het is een echte categorie problemen die autonome uitvoering niet elimineert.

Coder eerlijk vergelijken met Cursor: Cursor heeft meer verfijning in Editor Mode. De automatische aanvulling is sneller, de suggesties voelen contextueel bewuster aan van wat je van plan was te typen, en de codebase-indexering van Cursor is uitzonderlijk voor bestaande projecten — het kan vragen beantwoorden over de structuur van je project en wijzigingen voorstellen die rekening houden met patronen die al in de code zijn gevestigd.

Quest Mode is waar Coder op dit moment geen echte concurrent heeft in Cursor. De mogelijkheid om een volledige taak over te dragen — van beschrijving tot draaiende applicatie, autonoom — verschilt categorisch van de Composer-functie van Cursor, die nog steeds meer handmatige sturing vereist en de code niet zelf uitvoert. Deze tools concurreren niet om hetzelfde moment in je workflow. Als je de meeste tijd code schrijft in een bestaande codebase, is Cursor waarschijnlijk de juiste keuze. Als je regelmatig nieuwe dingen start en de steiger wilt laten afhandelen zodat je je kunt concentreren op de domeinspecifieke onderdelen, verandert Coder's Quest Mode de berekening aanzienlijk.

Nog één eerlijk ding: het autonome uitvoeringsmodel betekent dat je aandacht moet besteden aan wat de AI aan het bouwen is terwijl het bouwt. Dit is niet "vuur en vergeet." De architecturale beslissingen die Quest Mode neemt, zijn beslissingen waarmee je daarna leeft. Het installeert afhankelijkheden die jij gaat onderhouden. Het maakt componentstructuurkeuzes die draagmuren worden naarmate het project groeit. De planningsgoedkeuringsstap is geen formaliteit — het is het moment waarop jouw oordeel het meest belangrijk is. Lees de specificatie zorgvuldig voordat je akkoord gaat.

RPO Wiki — De Functie Die Me Het Meest Verraste

Ik verwachtte dat Quest Mode de kop zou zijn. De RPO Wiki verraste me.

RPO staat voor Repository Project Overview. Je activeert het op elk project, en Coder analyseert de gehele codebase om gestructureerde documentatie te genereren. Niet zomaar opsommingstekenpunten met bestandssamenvattingen. Volledige architecturale documentatie: een projectintroductie, kernmotorarchitectuur uitgelegd in gewone taal, Mermaid-diagrammen die component- en modulstructuur illustreren, sequentiediagrammen die tonen hoe de frontend en backend voor specifieke bewerkingen met elkaar communiceren, stroomdiagrammen voor sleutelprocessen, en geschreven beschrijvingen van elk hoofdcomponent met directe bestandsreferenties en regelnummers.

Ik testte het onmiddellijk op het JavaScript-visualiseringsproject nadat Quest Mode het had gebouwd — ik las dus AI-gegenereerde documentatie voor een AI-gegenereerde codebase. Meta, maar nuttig. De Mermaid-diagrammen weerspiegelden nauwkeurig de componentrelaties die ik kon verifiëren in de werkelijke code. De sequentiediagrammen toonden de correcte gegevensstroom tussen de code-editor, de interpreter-engine en de vier visualisatiepanelen. De geschreven beschrijvingen waren niet alleen een herformulering van wat de code deed — ze beschreven architecturale intentie, wat het moeilijkste deel van documentatie is om te schrijven omdat het gewoonlijk alleen in het hoofd van de oorspronkelijke ontwikkelaar zit.

Voor kennisoverdracht is deze functie oprecht waardevol. Als je ooit een ontwikkelaar op snelheid heeft moeten brengen op een complexe bestaande codebase en realiseerde dat de beschikbare documentatie onvolledig, verouderd of geschreven was door iemand die was vergeten welke onderdelen verwarrend waren voor nieuwkomers — dan begrijp je het probleem dat RPO aanpakt. De documentatie die er zou moeten zijn, de documentatie die uitlegt waarom dingen zijn gestructureerd zoals ze zijn, is gewoonlijk nergens te vinden.

RPO genereert die documentatie. En het synchroniseert — je kunt het opnieuw genereren naarmate code verandert, wat de plek is waar de meeste documentatiestrategieën volledig instorten. Handmatige documenten lopen op dag twee al achter. RPO houdt bij.

De eerlijke beperking: bij zeer grote repositories met duizenden bestanden worden de architecturale beschrijvingen oppervlakkiger. De functie werkt het beste op projecten met duidelijke scheiding van zorgen en minder dan een paar honderd bestanden. Voor persoonlijke projecten, startup-schaal codebases en kleine teamprojecten is dat geen betekenisvolle beperking. Voor een 500.000-regel enterprise-monoliet met vijftien jaar geaccumuleerde schuld — ik zou het zorgvuldig testen voordat ik me er aan vastleg.

Hoe de Resultaten Er Werkelijk Uitzagen

Laat me specifiek zijn over uitkomsten in plaats van indrukken.

De JavaScript-visualiser kostte me ongeveer vijftien minuten actieve betrokkenheid over de gehele bouw: vier minuten voor het schrijven en verfijnen van de initiële prompt, drie minuten voor het beantwoorden van verduidelijkende vragen en het doornemen van de voorgestelde architectuur, acht minuten voor het bekijken van de bouw en het uitvoeren van de eerste functionele test. De applicatie werkte correct bij de eerste uitvoering. Ik bracht daarna nog twintig minuten door met het toevoegen van een "stap terug"-knop voor de visualiser — een functie die ik wilde die de AI niet had opgenomen — wat zo lang duurde omdat ik werkte in animatiecoördinatielogica die nieuw voor me was.

Totale ontwikkelaarstijd voor een productieklare interactieve tool: onder de veertig minuten. Mijn realistische schatting voor het bouwen van hetzelfde ding van nul af, handmatig, inclusief framework-opzet, Acorn AST-integratie, Motion animatiecoördinatie en de componentarchitectuurbeslissingen: minimaal twee tot drie dagen, waarschijnlijk langer gezien ik de Acorn API goed had moeten bestuderen.

De codekwaliteit hield stand bij beoordeling. Componentscheiding was logisch. De interpreter-engine had commentaar dat intentie beschreef in plaats van alleen te herhalen wat de code deed. Animatievariabelen waren benoemd en gecentraliseerd in plaats van verspreid als magische getallen. Ik had me niet geschaamd dit aan een senior ontwikkelaar te laten zien — wat, in een betekenisvolle zin, het deels was.

Waar Quest Mode me geen tijd bespaarde: projecten met diepgaande domeinspecifieke technische vereisten waarbij correctheid subtiel is en niet kan worden geverifieerd door de code uit te voeren. Toen ik experimenteerde met het gebruiken ervan voor een beveiligingstoolproject met specifieke netwerkpakketanalysepatronen, was de gegenereerde code structureel solide maar technisch onjuist op manieren die stille fouten in productie zouden hebben veroorzaakt. Dat is een categorie problemen die domeinexpertise vereist die de AI niet heeft en niet uit een prompt kan synthetiseren. Dat gaat nergens heen.

De formulering die ik zou gebruiken: Quest Mode is uitzonderlijk voor projecten waarbij de uitdaging integratie, UI-architectuur en het correct laten samenwerken van componenten is. Het is zwakker voor projecten waarbij de uitdaging domeinspecifieke correctheid is die alleen een specialist als onjuist zou herkennen.

Waar Dit Daadwerkelijk Naartoe Gaat

Ik doe dit lang genoeg om veel "de toekomst van codering"-aankondigingen te hebben gezien die uitbleken op marginaal betere automatische aanvulling met een groter marketingbudget. Coder voelt niet zo.

Het autonome uitvoeringsmodel — waarbij de AI niet alleen code schrijft maar het uitvoert, fouten tegenkomt, zich aanpast en doorgaat — verandert de ontwikkelfeedbacklus op een fundamentele manier. Op dit moment is die mogelijkheid goed genoeg om oprecht nuttig te zijn op echte projecten. Als het Qwen Coder-team het onderliggende model blijft verbeteren op het tempo dat ze beschrijven, gaat het ervaringsverschil tussen AI-autonoom ontwikkelen en traditioneel van nul beginnen sneller slinken dan de meeste ontwikkelaars op zijn voorbereid.

Dat roept een vraag op die het waard is serieus bij stil te staan: als een AI op betrouwbare wijze de steigerbouw, boilerplate en standaard integratiewerk kan afhandelen, waar moeten engineers dan hun tijd aan besteden?

Mijn huidige antwoord — en ik heb hier de betere helft van deze tien dagen over nagedacht — zijn de beslissingen die echte context uit de praktijk vereisen, ethisch oordeel, domeinexpertise die niet in een prompt kan worden gecodeerd, en het vermogen om te vragen "maar moeten we dit überhaupt bouwen?" Quest Mode staat nergens in de buurt van het vervangen van die oordeelsvellen. Het probeert dat ook niet. Wat het wél vervangt, zijn de vijfenveertig minuten die ik besteed aan het aanmaken van een mapstructuur die ik vijfenveertig keer eerder heb aangemaakt.

De ontwikkelaars die over vijf jaar nog onmisbaar zullen zijn, zijn niet degenen die deze tools uit principe vermijden. Het zijn degenen die nieuwsgierig blijven naar de systemen onder de abstracties — die Quest Mode gebruiken als versneller voor kennis die ze al hebben, in plaats van als vervanging voor het in de eerste plaats opbouwen van die kennis.

Dit is de uitdaging die ik je meegeef: neem één taak die je hebt uitgesteld omdat de opzetoverhead te hoog leek. Een kleine tool. Een visualiser. Een intern hulpprogramma. Iets met duidelijke genoeg vereisten dat je het in vier zinnen kunt beschrijven. Geef het aan Quest Mode met een bewuste, specifieke prompt, lees de planningssamenvatting zorgvuldig voordat je goedkeurt, en kijk wat er terugkomt.

Ga dan begrijpen wat het heeft gebouwd.

Misschien merk je dat je koffie gaat halen en terugkomt bij iets wat je niet had verwacht.

🤝 Laten We Samenwerken

Wil je AI-systemen bouwen, workflows automatiseren of je tech-infrastructuur schalen? Ik help je graag.

- 🔗 Fiverr (maatwerk builds & integraties): fiverr.com/s/EgxYmWD

- 🌐 Portfolio: mejba.me

- 🏢 Ramlit Limited (bedrijfsoplossingen): ramlit.com

- 🎨 ColorPark (design & branding): colorpark.io

- 🛡 xCyberSecurity (beveiligingsdiensten): xcybersecurity.io