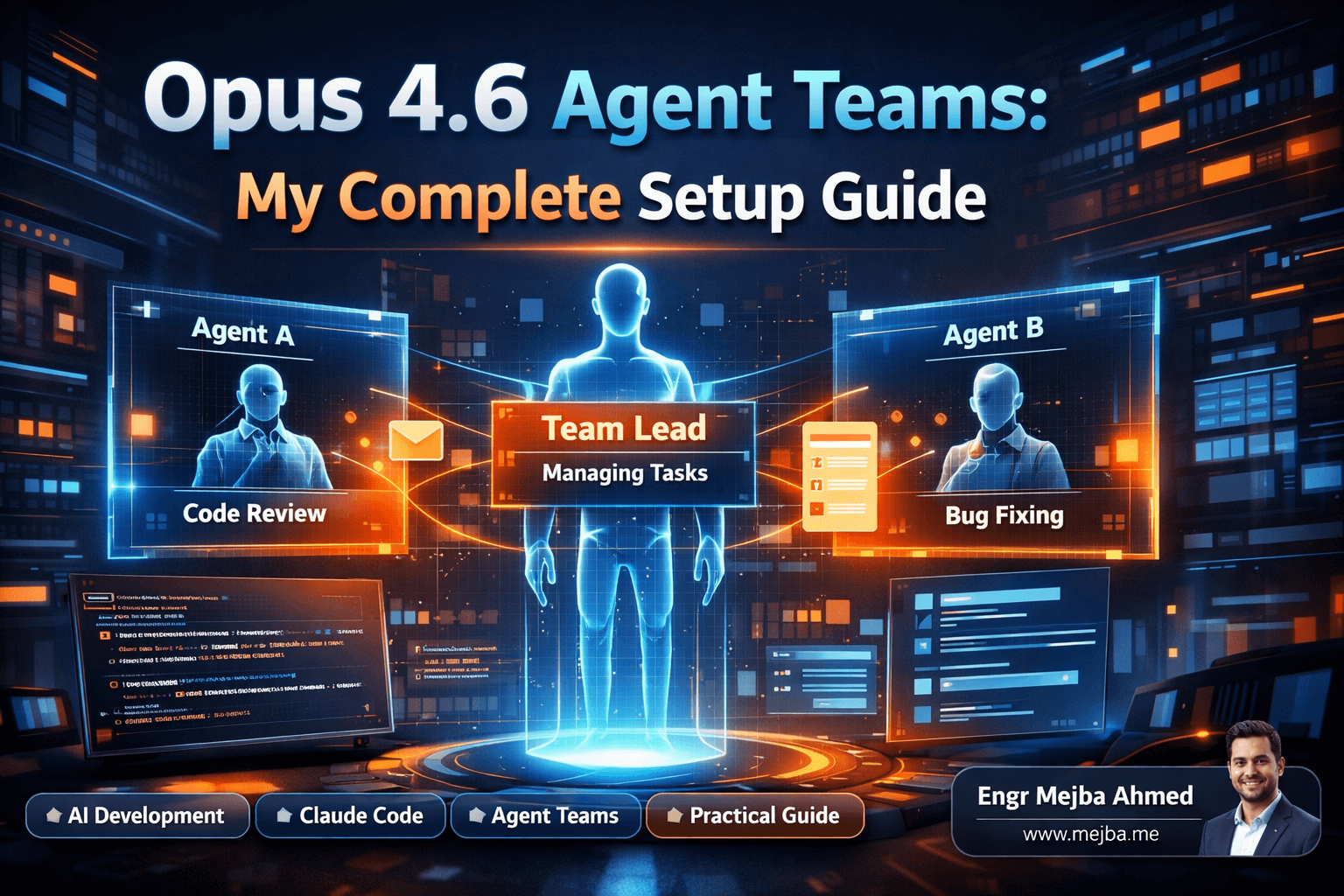

Opus 4.6 Agenten-Teams: Mein vollständiger Einrichtungsleitfaden

Ich verbrachte letzten Donnerstagnachmittag damit, sechs KI-Agenten bei einer Diskussion über ein State-Management-Muster für eine React-Komponente zuzusehen. Ein Agent dachte, useReducer wäre die richtige Wahl. Ein anderer bestand auf Zustand. Ein dritter hatte bereits mit useState angefangen und kümmerte sich nicht um die Meinung der anderen. Der Teamleiter — ebenfalls ein KI-Agent — musste eingreifen, eine Entscheidung treffen und alle auf Kurs bringen.

Das war keine Simulation. Das waren sechs unabhängige Claude Code-Instanzen, die in separaten Terminalsitzungen auf meinem Rechner liefen, über ein gemeinsames Postfach kommunizierten und an einem echten Anwendungsbau zusammenarbeiteten. Willkommen bei Agenten-Teams — dem Feature in Opus 4.6, das stillschweigend alles daran verändert hat, wie ich mit KI arbeite.

Was Sub-Agenten richtig machten (und wo sie an ihre Grenzen stießen)

Bevor Agenten-Teams existierten, verließ ich mich stark auf Sub-Agenten für alles, was parallele Arbeit erforderte. Das mentale Modell war klar: eine Mini-Sitzung starten, ihr eine abgegrenzte Aufgabe geben, ein Ergebnis zurückbekommen. Saubere Delegation.

Das Problem tauchte auf, sobald Aufgaben nicht vollständig unabhängig waren.

Stell dir vor: Ich baue eine API mit Authentifizierungs-Middleware. Sub-Agent #1 generiert die Route-Handler. Sub-Agent #2 baut die Auth-Middleware. Beide Aufgaben scheinen unabhängig. Aber die Middleware muss wissen, welches Antwortformat die Route-Handler verwenden, und die Route-Handler müssen wissen, was die Middleware in das Request-Objekt injiziert. Keiner der Agenten weiß, was der andere tut.

Meine Lösung war hässlich. Ich führte Agent #1 aus, nahm seine Ausgabe, kopierte relevante Details manuell in das Prompt für Agent #2, und ging dann zurück und aktualisierte die Arbeit von Agent #1 basierend auf dem, was Agent #2 produziert hatte. Der "Orchestrator" in diesem Workflow war ich — Kopieren und Einfügen zwischen Terminalfenstern wie eine Art menschlicher Nachrichtenbroker.

Das ist die Lücke, die Agenten-Teams füllen. Und der Unterschied ist nicht inkrementell — er ist strukturell.

Die Architektur hinter Agenten-Teams

Wenn du ein Agenten-Team startest, wird eine Instanz zum Team-Lead. Denk daran als deinen Projektmanager. Er schreibt keinen Code direkt (obwohl er es könnte). Seine Hauptaufgabe ist es, Teammitglieder zu spawnen, Aufgaben zuzuweisen, den Fortschritt zu überwachen und Ergebnisse zusammenzuführen.

Die verbleibenden Agenten sind Teammitglieder. Jeder bekommt eine vollständig unabhängige Terminalsitzung mit seinem eigenen Kontextfenster. Hier ist der Unterschied zu Sub-Agenten: Teammitglieder haben Zugang zu zwei gemeinsamen Ressourcen.

Erstens gibt es das gemeinsame Postfach. Jeder Agent im Team kann direkt eine Nachricht an jeden anderen Agenten senden. Wenn Agent #3 eine Inkonsistenz im Datenbankschema entdeckt, sendet er sofort eine Nachricht an Agent #1.

Zweitens gibt es die gemeinsame Aufgabenliste. Der Team-Lead erstellt Aufgaben, weist sie Teammitgliedern zu und verfolgt den Abschlussstatus. Teammitglieder können Aufgaben als blockiert, abgeschlossen oder in Bearbeitung markieren und auch Abhängigkeiten kennzeichnen.

Ich möchte ehrlich über etwas sein: Das ist ein experimentelles Feature. Anthropic lässt es standardmäßig deaktiviert, und du musst es manuell mit einem Umgebungs-Flag aktivieren.

Agenten-Teams aktivieren (der Teil, den niemand gut erklärt)

Die Umgebungsvariable ist:

export CLAUDE_CODE_EXPERIMENTAL_AGENT_TEAMS=1

Füge das zu deinem Shell-Profil (.zshrc, .bashrc) hinzu, wenn du es dauerhaft haben möchtest. Starte dann dein Terminal neu.

Um ein Team zu starten, öffnest du eine normale Claude Code-Sitzung und sagst ihr, als Team zu arbeiten:

Erstelle ein Agenten-Team mit 3 Teammitgliedern, um ein Aufgabenverwaltungs-Dashboard zu bauen

Pro-Tipp: Explizit über die Arbeitsaufteilung in deinem initialen Prompt zu sein, erzeugt dramatisch bessere Ergebnisse:

Erstelle ein Agenten-Team zum Bauen eines Aufgabenverwaltungs-Dashboards.

Teammitglied 1: Baue das Backend-API mit Express und PostgreSQL

Teammitglied 2: Baue die React-Frontend-Komponenten und das State Management

Teammitglied 3: Verwalte Authentifizierung, Middleware und Datenbankmigrationen

Diese eine Änderung — explizite Scope-Definition — reduzierte meine "Agenten überschreiben sich gegenseitig"-Vorfälle um etwa 80%.

Praxistest #1: Parallele Code-Review und Fehlerbehebung

Mein erster echter Test war bewusst einfach. Ich hatte ein Node.js-Projekt mit etwa fünfzehn TypeScript-Dateien, das einen Review-Durchgang und Fehlerbehebungen brauchte.

Ich richtete zwei Teammitglieder ein:

- Agent A: Überprüfe jede Datei, identifiziere Bugs, Typfehler und Sicherheitsprobleme. Sende jeden Fund über das Postfach an Agent B, sobald du ihn entdeckst.

- Agent B: Warte auf Ergebnisse von Agent A. Behebe jedes Problem, sobald es eintrifft. Falls eine Behebung Kontext erfordert, sende eine Nachricht an Agent A.

Was passierte, war wirklich faszinierend. Agent A begann die Codebase zu lesen und sendete innerhalb von dreißig Sekunden seinen ersten Fund an Agent B: eine fehlende Null-Prüfung. Agent B empfing die Nachricht und begann mit der Behebung, während Agent A weiter die nächste Datei überprüfte.

Der gesamte Review-und-Fix-Zyklus, der mich normalerweise zwanzig Minuten kostet, war in etwa acht Minuten fertig.

Praxistest #2: Bug-Untersuchung aus mehreren Blickwinkeln

Eine React-Anwendung, die ich gebaut hatte, hatte einen intermittierenden State-Bug. Meine Einrichtung: drei Teammitglieder, jedes untersuchte aus einem anderen Blickwinkel.

- Agent A: Analysiere das State Management der Formularkomponente, insbesondere die

useEffect-Hooks. - Agent B: Verfolge den Datenfluss von der Formulareinreichung über den API-Aufruf zurück zum State-Update.

- Agent C: Überprüfe auf Race Conditions in den asynchronen Operationen.

Innerhalb von zwei Minuten — und ich möchte das betonen, zwei Minuten — konvergierten alle drei Agenten auf dieselbe Grundursache. Ein stale Closure in einem useEffect-Hook.

Praxistest #3: Eine vollständige App aus einem einzigen Prompt bauen

Die Anforderung beschrieb ein Projektverwaltungstool mit vier Seiten: ein Dashboard, eine Projektlistenansicht, eine detaillierte Projektseite mit Aufgabenboards und eine Einstellungsseite. Tech-Stack: Next.js 14 mit App Router, Tailwind CSS und einer SQLite-Datenbank via Drizzle ORM.

Der Team-Lead analysierte das Prompt und traf eine Entscheidung, die ich nicht erwartet hatte — er spawnte sechs Teammitglieder statt der vier, die ich erstellt hätte. Der gesamte Prozess verbrauchte etwa 170.000 Tokens. Das ist signifikant — ungefähr 8-12 Dollar je nach Preisstufe. Die endgültige Ausgabe war nicht perfekt, aber die App lief. Alle vier Seiten funktionierten.

Best Practices, die wirklich wichtig sind

Agenten-Scope explizit definieren

Das ist die wichtigste Praxis. Spezifiziere Dateien oder funktionale Grenzen für jeden Agenten. "Agent 1 besitzt alles in /src/api/. Agent 2 besitzt alles in /src/components/." Wenn Agenten ihr Territorium kennen, sinken Konflikte auf nahezu null.

Wirklich unabhängige Aufgaben zuweisen

Der Sweet Spot sind Aufgaben, die größtenteils unabhängig sind, aber von gelegentlicher Kommunikation profitieren.

Die Geduld des Team-Leads managen

Der Team-Lead wird manchmal ungeduldig. Wenn ein Teammitglied mehr als ein oder zwei Minuten an einer Aufgabe arbeitet, entscheidet der Team-Lead manchmal, "zu helfen" indem er die Arbeit selbst erledigt. Meine Lösung: ich sage dem Team-Lead explizit, auf die Teammitglieder zu warten und keine Aufgaben selbst zu implementieren.

Aufgaben für den Sweet Spot dimensionieren

Meine Faustregel: Jede Aufgabe eines Teammitglieds sollte zwischen zwei und acht Minuten fokussierter Arbeit kosten.

Überwachen und bereit sein einzugreifen

Agenten-Teams sind experimentell. Halte dein Terminal sichtbar. Wenn ein Agent drei bis vier Minuten keine Ausgabe produziert hat und keine Nachrichten gesendet hat, steckt er wahrscheinlich fest.

Die Zahlen, die wirklich wichtig sind

Bug-Untersuchungszeit: Von durchschnittlich fünf bis zehn Minuten auf zwei bis drei Minuten gesunken.

Code-Review-Zyklen: Ein Review-und-Fix-Durchgang an einer mittelgroßen Codebase ging von etwa fünfundzwanzig Minuten auf ungefähr zehn Minuten.

Token-Verbrauch: Deutlich höher. Eine Einzelagenten-Sitzung für eine Aufgabe mittlerer Komplexität könnte 30.000-50.000 Tokens verbrauchen. Mit einem Agenten-Team typischerweise 80.000-170.000.

Das, worauf ich immer wieder zurückkomme

Als ich dieses Donnerstagexperiment startete — das, bei dem sechs Agenten über State Management diskutierten — erwartete ich, einen Beitrag über ein cooles neues Feature zu schreiben. Stattdessen überarbeitete ich meinen gesamten Entwicklungs-Workflow.

Die State-Management-Diskussion löste sich übrigens auf. Der Team-Lead überprüfte die Argumentation jedes Agenten, wählte Zustand aus, da es den einfachsten Integrationspfad für die Anforderungen des Projekts hatte, und benachrichtigte alle. Agent #3 refaktorierte in etwa fünfundvierzig Sekunden. Kein Ego. Kein versunkener Kosten-Irrtum. Nur ein Team, das kommunizierte, entschied und vorwärtsging.

Setze das Umgebungs-Flag. Starte zwei Teammitglieder. Sieh zu, wie sie miteinander reden. Das ist der Moment, in dem es Klick macht.

Lass uns zusammenarbeiten

Du möchtest KI-Systeme bauen, Workflows automatisieren oder deine Tech-Infrastruktur skalieren? Ich helfe dir gerne.

- Fiverr (individuelle Builds & Integrationen): fiverr.com/s/EgxYmWD

- Portfolio: mejba.me

- Ramlit Limited (Enterprise-Lösungen): ramlit.com

- ColorPark (Design & Branding): colorpark.io

- xCyberSecurity (Sicherheitsdienstleistungen): xcybersecurity.io